三层BP神经网络的python实现

这是一个非常漂亮的三层反向传播神经网络的python实现,下一步我准备试着将其修改为多层BP神经网络。

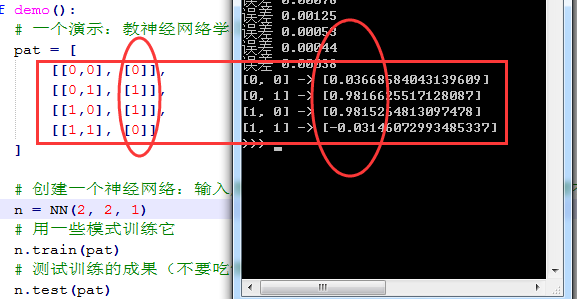

下面是运行演示函数的截图,你会发现预测的结果很惊人!

提示:运行演示函数的时候,可以尝试改变隐藏层的节点数,看节点数增加了,预测的精度会否提升

1 import math

2 import random

3 import string

4

5 random.seed(0)

6

7 # 生成区间[a, b)内的随机数

8 def rand(a, b):

9 return (b-a)*random.random() + a

10

11 # 生成大小 I*J 的矩阵,默认零矩阵 (当然,亦可用 NumPy 提速)

12 def makeMatrix(I, J, fill=0.0):

13 m = []

14 for i in range(I):

15 m.append([fill]*J)

16 return m

17

18 # 函数 sigmoid,这里采用 tanh,因为看起来要比标准的 1/(1+e^-x) 漂亮些

19 def sigmoid(x):

20 return math.tanh(x)

21

22 # 函数 sigmoid 的派生函数, 为了得到输出 (即:y)

23 def dsigmoid(y):

24 return 1.0 - y**2

25

26 class NN:

27 ''' 三层反向传播神经网络 '''

28 def __init__(self, ni, nh, no):

29 # 输入层、隐藏层、输出层的节点(数)

30 self.ni = ni + 1 # 增加一个偏差节点

31 self.nh = nh

32 self.no = no

33

34 # 激活神经网络的所有节点(向量)

35 self.ai = [1.0]*self.ni

36 self.ah = [1.0]*self.nh

37 self.ao = [1.0]*self.no

38

39 # 建立权重(矩阵)

40 self.wi = makeMatrix(self.ni, self.nh)

41 self.wo = makeMatrix(self.nh, self.no)

42 # 设为随机值

43 for i in range(self.ni):

44 for j in range(self.nh):

45 self.wi[i][j] = rand(-0.2, 0.2)

46 for j in range(self.nh):

47 for k in range(self.no):

48 self.wo[j][k] = rand(-2.0, 2.0)

49

50 # 最后建立动量因子(矩阵)

51 self.ci = makeMatrix(self.ni, self.nh)

52 self.co = makeMatrix(self.nh, self.no)

53

54 def update(self, inputs):

55 if len(inputs) != self.ni-1:

56 raise ValueError('与输入层节点数不符!')

57

58 # 激活输入层

59 for i in range(self.ni-1):

60 #self.ai[i] = sigmoid(inputs[i])

61 self.ai[i] = inputs[i]

62

63 # 激活隐藏层

64 for j in range(self.nh):

65 sum = 0.0

66 for i in range(self.ni):

67 sum = sum + self.ai[i] * self.wi[i][j]

68 self.ah[j] = sigmoid(sum)

69

70 # 激活输出层

71 for k in range(self.no):

72 sum = 0.0

73 for j in range(self.nh):

74 sum = sum + self.ah[j] * self.wo[j][k]

75 self.ao[k] = sigmoid(sum)

76

77 return self.ao[:]

78

79 def backPropagate(self, targets, N, M):

80 ''' 反向传播 '''

81 if len(targets) != self.no:

82 raise ValueError('与输出层节点数不符!')

83

84 # 计算输出层的误差

85 output_deltas = [0.0] * self.no

86 for k in range(self.no):

87 error = targets[k]-self.ao[k]

88 output_deltas[k] = dsigmoid(self.ao[k]) * error

89

90 # 计算隐藏层的误差

91 hidden_deltas = [0.0] * self.nh

92 for j in range(self.nh):

93 error = 0.0

94 for k in range(self.no):

95 error = error + output_deltas[k]*self.wo[j][k]

96 hidden_deltas[j] = dsigmoid(self.ah[j]) * error

97

98 # 更新输出层权重

99 for j in range(self.nh):

100 for k in range(self.no):

101 change = output_deltas[k]*self.ah[j]

102 self.wo[j][k] = self.wo[j][k] + N*change + M*self.co[j][k]

103 self.co[j][k] = change

104 #print(N*change, M*self.co[j][k])

105

106 # 更新输入层权重

107 for i in range(self.ni):

108 for j in range(self.nh):

109 change = hidden_deltas[j]*self.ai[i]

110 self.wi[i][j] = self.wi[i][j] + N*change + M*self.ci[i][j]

111 self.ci[i][j] = change

112

113 # 计算误差

114 error = 0.0

115 for k in range(len(targets)):

116 error = error + 0.5*(targets[k]-self.ao[k])**2

117 return error

118

119 def test(self, patterns):

120 for p in patterns:

121 print(p[0], '->', self.update(p[0]))

122

123 def weights(self):

124 print('输入层权重:')

125 for i in range(self.ni):

126 print(self.wi[i])

127 print()

128 print('输出层权重:')

129 for j in range(self.nh):

130 print(self.wo[j])

131

132 def train(self, patterns, iterations=1000, N=0.5, M=0.1):

133 # N: 学习速率(learning rate)

134 # M: 动量因子(momentum factor)

135 for i in range(iterations):

136 error = 0.0

137 for p in patterns:

138 inputs = p[0]

139 targets = p[1]

140 self.update(inputs)

141 error = error + self.backPropagate(targets, N, M)

142 if i % 100 == 0:

143 print('误差 %-.5f' % error)

144

145

146 def demo():

147 # 一个演示:教神经网络学习逻辑异或(XOR)------------可以换成你自己的数据试试

148 pat = [

149 [[0,0], [0]],

150 [[0,1], [1]],

151 [[1,0], [1]],

152 [[1,1], [0]]

153 ]

154

155 # 创建一个神经网络:输入层有两个节点、隐藏层有两个节点、输出层有一个节点

156 n = NN(2, 2, 1)

157 # 用一些模式训练它

158 n.train(pat)

159 # 测试训练的成果(不要吃惊哦)

160 n.test(pat)

161 # 看看训练好的权重(当然可以考虑把训练好的权重持久化)

162 #n.weights()

163

164

165 if __name__ == '__main__':

166 demo()三层BP神经网络的python实现相关推荐

- Python实现三层BP神经网络

题外话 看论文,仿真实现,最基本的能力!研一的时候定要多看看论文,提升自己的代码能力! 引言 本篇博客默认读者有一定的BP神经网络的基础,BP神经网络的基本知识就不阐述了! BP神经网络结构 本文内容 ...

- BP神经网络以及python实现

神经网络学习(3)----BP神经网络以及python实现 import numpy as np import math import random import string import matp ...

- 基于三层BP神经网络的人脸识别

实验四.基于三层BP神经网络的人脸识别 一. 实验要求 采用三层前馈BP神经网络实现标准人脸YALE数据库的识别,编程语言为C系列语言. 二.BP神经网络的结构和学习算法 实验中建议采用如下最简单的三 ...

- 模式识别八--三层BP神经网络的设计与实现

文章转自:http://www.kancloud.cn/digest/prandmethod/102850 本文的目的是学习和掌握BP神经网络的原理及其学习算法.在MATLAB平台上编程构造一个3-3 ...

- 模式识别:三层BP神经网络的设计与实现

本文的目的是学习和掌握BP神经网络的原理及其学习算法.在MATLAB平台上编程构造一个3-3-1型的singmoid人工神经网络,并使用随机反向传播算法和成批反向传播算法来训练这个网络,这里设置不同的 ...

- bp神经网络预测模型python,r语言bp神经网络预测

如何建立bp神经网络预测 模型 . 建立BP神经网络预测模型,可按下列步骤进行:1.提供原始数据2.训练数据预测数据提取及归一化3.BP网络训练4.BP网络预测5.结果分析现用一个实际的例子,来预测2 ...

- 三层BP神经网络公式推导及C语言实现

公式推导 三层BP神经网络如上图所示.其中, x i x_i xi表示第 i i i个输入层节点的输入值,也是其输出值, z j z_j zj表示第 j j j个隐藏层节点的输出值, y k ...

- 基于sympy的python实现三层BP神经网络算法

#!/usr/bin/python # -*- coding: utf-8 -*- """ 写一个三层的BP神经网络(3,2,1),3是输入数据的维度,隐层设置节点数为2 ...

- 神经网络学习(3)————BP神经网络以及python实现

一.BP神经网络结构模型 BP算法的基本思想是,学习过程由信号的正向传播和误差的反向传播俩个过程组成,输入从输入层输入,经隐层处理以后,传向输出层.如果输出层的实际输出和期望输出不符合,就进入误差的反 ...

最新文章

- 计算机专业今后的发展方向

- JAVA IF判断语句

- 【Android 安装包优化】资源混淆 ( resources.arsc 资源映射表混淆 | resources.arsc 资源映射表二进制格式分析 | 混淆全局字符串池和资源名称字符串池 )

- PHP环境服务器搭建

- gbdt如何处理多分类问题(multiclass,cart)

- python实现日历功能_Python实现的简单万年历例子分享

- cmd 无法切换目录

- html行级元素和块级元素以及css转换

- go语言和python-新学语言,选GO还是Python

- linux sed命令_Linux sed命令用法与示例

- IO中的阻塞、非阻塞、同步、异步概念分析详解(通俗易懂)

- 对象用[]来获取属性的注意点

- [转]以绝招应对损招 查***

- js实现身份证号查询相关信息

- 现代密码学(七)对称密钥管理和公钥革命

- 成功解决Initialization failed for ‘https://start.spring.io‘ Please check URL, network and proxy settings

- 计算机考研作息时间表,2016考研人:牛人的考研作息时间表

- 简单几步去掉百度热搜

- 范围求和 II-c语言解决

- win32反汇编初步探索及Onllydbg的使用