YOLOv5与Faster RCNN相比。 谁赢?

介绍 (Introduction)

The deep learning community is abuzz with YOLO v5. This blog recently introduced YOLOv5 as — State-of-the-Art Object Detection at 140 FPS. This immediately generated significant discussions across Hacker News, Reddit and even Github but not for its inference speed. Two prominent issues were — Should the model be called YOLO and are the speed benchmarking results accurate and reproducible. If you are interested in Roboflow’s response then you can find it here.

深度学习社区对YOLO v5充满热情。 该博客最近介绍了YOLOv5,它是140 FPS的最新对象检测。 这立即引起了Hacker News,Reddit甚至Github的广泛讨论,但并不是因为其推理速度。 两个突出的问题是-该模型是否应称为YOLO,并且速度基准测试结果准确且可重复。 如果您对Roboflow的回复感兴趣,可以在此处找到。

All the controversy aside, YOLOv5 looked like a promising model. So I have compared it to one of the best two stage detectors — Faster RCNN. To do this comparison, I have taken 3 videos from with different contexts and run the 2 models side by side. My assessment includes observations on the quality of results and inference speed. So lets get started!

除了所有争议之外,YOLOv5看起来是一个很有前途的模型。 因此,我将其与最好的两级检测器之一-Faster RCNN进行了比较。 为了进行比较,我从不同的背景拍摄了3个视频,并排运行2个模型。 我的评估包括对结果质量和推理速度的观察。 因此,让我们开始吧!

YOLOv5模型 (YOLOv5 model)

The YOLOv5 implementation has been done in Pytorch in contrast with the previous developments that used the DarkNet framework. This makes it easier to understand, train with it and deploy this model. There is no paper released with YOLO-v5. My understanding is that architecturally it is quite similar to YOLO-v4. One different may be the use of Cross Stage Partial Network (CSP) to reduce computation cost. It is still not clear if YOLO-v5 runs faster than YOLO-v4 but I prefer Pytorch implementations and I am amazed with how easy it is to train with this model. My personal experience of running inference through it was also seamless.

与以前使用DarkNet框架的开发相反,YOLOv5实现是在Pytorch中完成的。 这使得它更易于理解,培训和部署此模型。 YOLO-v5没有发布任何文件。 我的理解是,它在架构上与YOLO-v4非常相似。 一种不同可能是使用跨阶段局部网络(CSP)来减少计算成本。 尚不清楚YOLO-v5是否比YOLO-v4运行得更快,但我更喜欢Pytorch的实现方式,并且对使用此模型进行训练如此容易感到惊讶。 我个人通过推理进行推理的经验也是无缝的。

The release of YOLOv5 includes five different models sizes: YOLOv5s (smallest), YOLOv5m, YOLOv5l, YOLOv5x (largest). The inference speed and mean average precision (mAP) for these models is shared below:

YOLOv5的发布包括五种不同的模型尺寸:YOLOv5s(最小),YOLOv5m,YOLOv5l,YOLOv5x(最大)。 这些模型的推理速度和平均平均精度(mAP)在下面共享:

使用YOLO-v5进行推理 (Inference using YOLO-v5)

The first step would be to clone the repo for YOLO-v5. Install all the requirments. I use Pytorch 1.5 and the code works without any problems.

第一步是克隆YOLO-v5的仓库 。 安装所有要求。 我使用Pytorch 1.5,代码可以正常工作。

You can download all the weights for different pretrained COCO models using:

您可以使用以下方法下载不同的预训练COCO模型的所有权重:

bash weights/download_weights.shTo run inference on a video, you have to pass the path to the video and the weights of the model you want to use. If the weights argument is not set, then by default code runs on the YOLO small model. Sample arguments I used are shared below:

要对视频进行推理,您必须将路径传递给视频以及要使用的模型的权重。 如果未设置weights参数,则默认情况下,代码将在YOLO小型模型上运行。 我使用的示例参数在下面共享:

python detect.py --source video/MOT20-01-raw-cut1.mp4 --output video_out/ --weights weights/yolov5s.pt --conf-thres 0.4The output video will be saved in the output folder

输出的视频将保存在输出文件夹中

使用YOLO-v5进行培训 (Training using YOLO-v5)

I haven’t personally tried training using YOLO-v5 on a custom data set but a good step by step tutorial is shared by Roboflow on Youtube here.

我还没有亲自尝试使用培训上的自定义数据集YOLO-V5但一个好的教程一步一步被Roboflow共享Youtube上的点击这里 。

更快的RCNN模型 (Faster RCNN Model)

For the Faster RCNN model, I used the pretrained model from Tensorflow Object Detection. Tensorflow Object Detection shares COCO pretrained Faster RCNN for various backbones. For this blog I have used the Fatser RCNN ResNet 50 backbone. This repo has shared a nice tutorial on how to do inference using their pretrained model here.

对于Faster RCNN模型,我使用了Tensorflow Object Detection中的预训练模型。 Tensorflow对象检测针对各种骨干共享COCO预训练的Faster RCNN。 对于此博客,我使用了Fatser RCNN ResNet 50主干。 这个仓库在这里分享了一个很好的教程,关于如何使用他们的预训练模型进行推理。

YOLOv5模型与Faster RCNN的比较 (Comparison of YOLOv5 model with Faster RCNN)

The first scene I chose was a street driving scene considering the importance to self driving car industry. The results from both these models is shared below:

考虑到对自动驾驶汽车行业的重要性,我选择的第一个场景是街头驾驶场景。 这两个模型的结果共享如下:

YOLO model seems much better at detecting smaller objects — traffic lights in this case and also is able to pick up the car when it is farther away i.e smaller.

YOLO模型似乎可以更好地检测较小的物体-在这种情况下,它是交通信号灯,并且即使距离较远(即较小),也能够将其提起。

Run Speed of YOLO v5 small(end to end including reading video, running model and saving results to file) — 52.8 FPS!

YOLO v5的运行速度很小(端到端包括读取视频,运行模型并将结果保存到文件)— 52.8 FPS!

Run Speed of Faster RCNN ResNet 50(end to end including reading video, running model and saving results to file) —21.7 FPS

更快的RCNN ResNet 50的运行速度(端到端包括读取视频,运行模型并将结果保存到文件)—21.7 FPS

These results are evaluated on NVIDIA 1080 Ti.

这些结果在NVIDIA 1080 Ti上进行了评估。

So far YOLO v5 seems better than Faster RCNN

到目前为止,YOLO v5似乎比Faster RCNN更好

The next video is a basketball match video from youtube. The results of both models are shared below:

下一个视频是来自youtube的篮球比赛视频。 两种模型的结果共享如下:

The Faster RCNN model is run at a threshold of 60% and one could argue it is picking up the crowd with a single person label but I prefer YOLO here for the cleanliness of results. Both models have false positive on the abc logo.

Faster RCNN模型在60%的阈值下运行,有人可能会说它是用单人标签来吸引人群,但我更喜欢YOLO来保持结果的整洁。 两种型号的abc徽标均为假阳性。

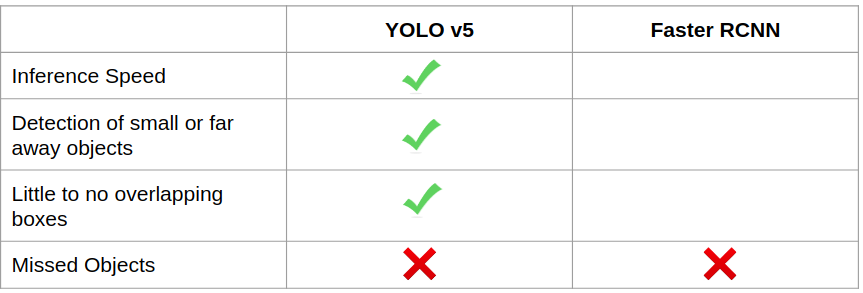

I was also disappointed on how both failed to detect the basketball ball even though sports ball is a category in COCO. Their tally is now:

即使运动球是COCO中的一个类别,我也对两个人都未能检测到篮球球感到失望。 他们的理货现在是:

For the final video, I chose an indoor crowded scene from MOT data set. This is a challenging video with low lighting, distant and dense crowds. The results from both the models are shown below.

对于最后的视频,我从MOT数据集中选择了一个室内拥挤的场景。 这是一个具有挑战性的视频,光线不足,人群遥远且人群密集。 这两个模型的结果如下所示。

This is interesting. I would say both these models struggle to detect people in the distance as they walk into the corridor. This could be attributed to low light and smaller objects. When the crowd gets closer to the camera, both are able to pick up overlapping people.

这是有趣的。 我要说的是,这两种模型都很难在人们走进走廊时检测到远处的人。 这可能归因于光线不足和物体较小。 当人群靠近摄像机时,两个人都可以接起重叠的人。

结论 (Conclusion)

The final comparison b/w the two models shows that YOLO v5 has a clear advantage in terms of run speed. The small YOLO v5 model runs about 2.5 times faster while managing better performance in detecting smaller objects. The results are also cleaner with little to no overlapping boxes. Ultralytics have done a fabulous job on their YOLO v5 open sourcing a model that is easy to train and run inference on.

两种型号的最终对比,表明YOLO v5在运行速度方面具有明显优势。 小型YOLO v5模型的运行速度提高了约2.5倍,同时在检测较小物体方面具有更好的性能。 结果也更干净,几乎没有重叠的框。 Ultralytics在其YOLO v5开源模型上做得非常出色,该模型易于训练和推论。

This blog also shows an emerging trend with computer vision object detection towards moving to models that are both faster and accurate.

该博客还显示了计算机视觉对象检测朝着转向更快,更准确的模型的新兴趋势。

If you have tried YOLOv5 please share your experience in the comments below.

如果您尝试过YOLOv5,请在下面的评论中分享您的经验。

At Deep Learning Analytics, we are extremely passionate about using Machine Learning to solve real-world problems. We have helped many businesses deploy innovative AI-based solutions. Contact us through our website here if you see an opportunity to collaborate.

在深度学习分析中 ,我们非常热衷于使用机器学习解决现实世界中的问题。 我们已经帮助许多企业部署了基于AI的创新解决方案。 如果您发现合作的机会,请通过此处的网站与我们联系。

翻译自: https://towardsdatascience.com/yolov5-compared-to-faster-rcnn-who-wins-a771cd6c9fb4

http://www.taodudu.cc/news/show-1874001.html

相关文章:

- 句子匹配 无监督_在无监督的情况下创建可解释的句子表示形式

- 科技创新 可持续发展 论坛_可持续发展时间

- Pareidolia — AI的艺术教学

- 个性化推荐系统_推荐系统,个性化预测和优点

- 自己对行业未来发展的认知_我们正在建立的认知未来

- 汤国安mooc实验数据_用漂亮的汤建立自己的数据集

- python开发助理s_如何使用Python构建自己的AI个人助理

- 学习遗忘曲线_级联相关,被遗忘的学习架构

- 她玩游戏好都不准我玩游戏了_我们可以玩游戏吗?

- ai人工智能有哪些_进入AI有多么简单

- 深度学习分类pytorch_立即学习AI:02 —使用PyTorch进行分类问题简介

- 机器学习和ai哪个好_AI可以使您成为更好的运动员吗? 使用机器学习分析网球发球和罚球...

- ocr tesseract_OCR引擎之战— Tesseract与Google Vision

- 游戏行业数据类丛书_理论丛书:高维数据101

- tesseract box_使用Qt Box Editor在自定义数据集上训练Tesseract

- 人脸检测用什么模型_人脸检测模型:使用哪个以及为什么使用?

- 不洗袜子的高文博_那个孩子在夏天中旬用高袜子大笑?

- word2vec字向量_Anything2Vec:将Reddit映射到向量空间

- ai人工智能伪原创_AI伪科学与科学种族主义

- ai人工智能操控什么意思_为什么要建立AI分散式自治组织(AI DAO)

- 机器学习cnn如何改变权值_五个机器学习悖论将改变您对数据的思考方式

- DeepStyle(第2部分):时尚GAN

- 肉体之爱的解释圣经_可解释的AI的解释

- 机器学习 神经网络 神经元_神经网络如何学习?

- 人工智能ai应用高管指南_理解人工智能指南

- 机器学习 决策树 监督_监督机器学习-决策树分类器简介

- ai人工智能数据处理分析_建立数据平台以实现分析和AI驱动的创新

- 极限学习机和支持向量机_极限学习机的发展

- 人工智能时代的危机_AI信任危机:如何前进

- 不平衡数据集_我们的不平衡数据集

YOLOv5与Faster RCNN相比。 谁赢?相关推荐

- YOLOv5 对决 Faster RCNN,谁赢谁输?(转载)

摘自:https://mp.weixin.qq.com/s/fKHcKHhCmymFf0fBKbej_g 因为我i看无人机的目标检测也是用的YOLO YOLOv5 对决 Faster RCNN,谁赢谁 ...

- Grid R-CNN解读:商汤最新目标检测算法,定位精度超越Faster R-CNN

作者 | 周强 来源 | 我爱计算机视觉 Grid R-CNN是商汤科技最新发表于arXiv的一篇目标检测的论文,对Faster R-CNN架构的目标坐标回归部分进行了替换,取得了更加精确的定位精度, ...

- 基于DAMO-YOLO的RepGFPN多尺度特征融合的YOLOv5、YOLOv7、Faster RCNN、FCOS、CenterNet等目标检测器改进

DAMO-YOLO的RepGFPN多尺度特征融合颈部网络与目标检测器的融合策略 1.DAMO-YOLO 点击此处直达论文地址 DAMO-YOLO是一个兼顾速度与精度的目标检测框架,其效果超越了目前的一 ...

- 《Faster R-CNN: Towards Real-Time Object Detection with Region Proposal Networks》论文翻译

原文:https://arxiv.org/abs/1506.01497 Faster R-CNN: Towards Real-Time ObjectDetection with Region Prop ...

- 里程碑式成果Faster RCNN复现难?我们试了一下 | 附完整代码

作者 | 已退逼乎 来源 | 知乎 [导读]2019年以来,除各AI 大厂私有网络范围外,MaskRCNN,CascadeRCNN 成为了支撑很多业务得以开展的基础,而以 Faster RCNN 为基 ...

- 经验 | 详解 Faster R-CNN目标检测的实现过程

计算机视觉联盟 报道 转载于 :机器之心 Faster R-CNN 实现代码:https://github.com/tryolabs/luminoth/tree/master/luminoth/mo ...

- 物体检测之从RCNN到Faster RCNN

RCNN 问题与创新 架构 训练 测试 Fast RCNN 问题与创新 架构 训练 测试 Faster RCNN 问题与创新 架构 训练 测试 总结 本文将简要介绍物体检测的two stage的相关算 ...

- Pytorch搭建Faster R-CNN目标检测平台

学习前言 什么是FasterRCNN目标检测算法 源码下载 Faster-RCNN实现思路 一.预测部分 1.主干网络介绍 2.获得Proposal建议框 3.Proposal建议框的解码 4.对Pr ...

- Faster R-CNN论文笔记——FR

转载自:http://blog.csdn.net/qq_17448289/article/details/52871461 在介绍Faster R-CNN之前,先来介绍一些前验知识,为Faster R ...

- 【目标检测】Faster RCNN算法详解

转载自:http://blog.csdn.net/shenxiaolu1984/article/details/51152614 Ren, Shaoqing, et al. "Faster ...

最新文章

- 12、OpenCV实现图像的空间滤波——图像平滑

- Openstack组件部署 — Nova_Install and configure a compute node

- MySQL运行状态show status详解

- 写在树莓派专栏的开篇

- C语言交换两个数字的三种做法

- 史上最萌最认真的机器学习/深度学习/模式识别入门指导手册(一)

- springboot 历史版本文档_这个男人练了整整二年的SpringBoot看他如何教你学学学!...

- 6. 隐藏 index.php

- win10多合一原版系统_如何制作Win10多合一系统安装盘

- 模电_第六章_负反馈电路

- 手机联系人分组名字都没了_这个你连名字都没听过的城市,深藏着江西美食的功与名...

- Tomcat正常启动却访问不了·解决方法

- ldac_aptx和aptx hd功能介绍及区别介绍

- AngularJS + RequireJS

- 了不起的盖茨比读后感---Java程序员学Python学习笔记(二)

- 维基百科,20岁生日快乐

- 蓝桥杯javaB三羊献瑞

- python笔记06: 函数

- php开心农场游戏源码,解密开源版开心农场游戏小程序分享

- 管理书单 | 10本经典的管理学书籍推荐

热门文章

- ArcEngine中放大、缩小、移动等功能实现的方法

- [Python]将Excel文件中的数据导入MySQL

- System.SetString - 获取字符串

- conda创建环境速度慢解决办法

- 各种语言和各种前沿技术的简介和科普

- Kinect2.0 vs2013的配置

- Atitit 索引法 html文件转txt纯文本索引 适用于 evernote索引,导入imap邮箱,方便检索 /sumdoclist/src/aPkg/html2txtIndexFile.jav

- Atitit aop的一些资料 目录 2. AOP(面向切面) 1 2.1. 切面(Aspect):其实就是共有功能的实现。如日志切面、权限切面、事务切面等 2 2.2. 通知(Advice

- Atitit.跨语言标准化 web cgi api v2 saa CGI (通用网关接口) 编辑 CGI 是Web 服务器运行时外部程序的规范,按CGI 编写的程序可以扩展服务器功能。CG

- Atitit 学习的本质 团队管理与培训的本质 attilax总结 v2