常规卷积,DW卷积和PW卷积的区别

常规卷积,DW卷积和PW卷积的区别

转载于卷积神经网络中的Separable Convolution

卷积神经网络在图像处理中的地位已然毋庸置疑。卷积运算具备强大的特征提取能力、相比全连接又消耗更少的参数,应用在图像这样的二维结构数据中有着先天优势。然而受限于目前移动端设备硬件条件,显著降低神经网络的运算量依旧是网络结构优化的目标之一。本文所述的Separable Convolution就是降低卷积运算参数量的一种典型方法。

常规卷积运算

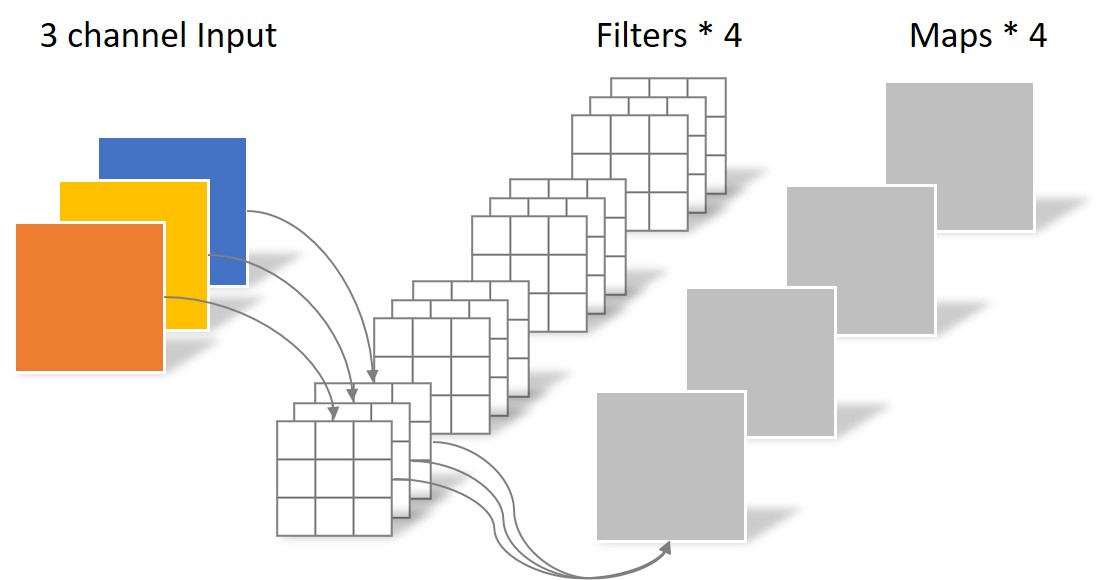

假设输入层为一个大小为64×64像素、三通道彩色图片。经过一个包含4个Filter的卷积层,最终输出4个Feature Map,且尺寸与输入层相同。整个过程可以用下图来概括。

此时,卷积层共4个Filter,每个Filter包含了3个Kernel,每个Kernel的大小为3×3。因此卷积层的参数数量可以用如下公式来计算:

N_std = 4 × 3 × 3 × 3 = 108

Separable Convolution

Separable Convolution在Google的Xception[1]以及MobileNet[2]论文中均有描述。它的核心思想是将一个完整的卷积运算分解为两步进行,分别为Depthwise Convolution与Pointwise Convolution。

Depthwise Convolution

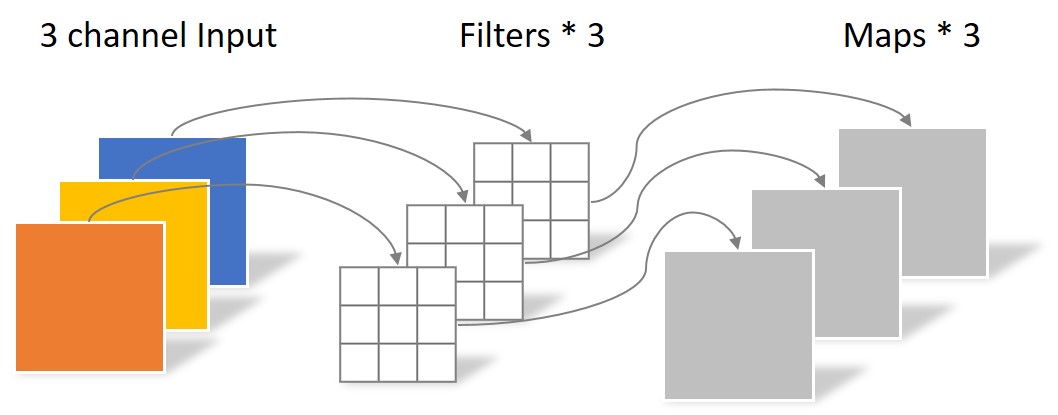

同样是上述例子,一个大小为64×64像素、三通道彩色图片首先经过第一次卷积运算,不同之处在于此次的卷积完全是在二维平面内进行,且Filter的数量与上一层的Depth相同。所以一个三通道的图像经过运算后生成了3个Feature map,如下图所示。

其中一个Filter只包含一个大小为3×3的Kernel,卷积部分的参数个数计算如下:

N_depthwise = 3 × 3 × 3 = 27

Depthwise Convolution完成后的Feature map数量与输入层的depth相同,但是这种运算对输入层的每个channel独立进行卷积运算后就结束了,没有有效的利用不同map在相同空间位置上的信息。因此需要增加另外一步操作来将这些map进行组合生成新的Feature map,即接下来的Pointwise Convolution。

Pointwise Convolution

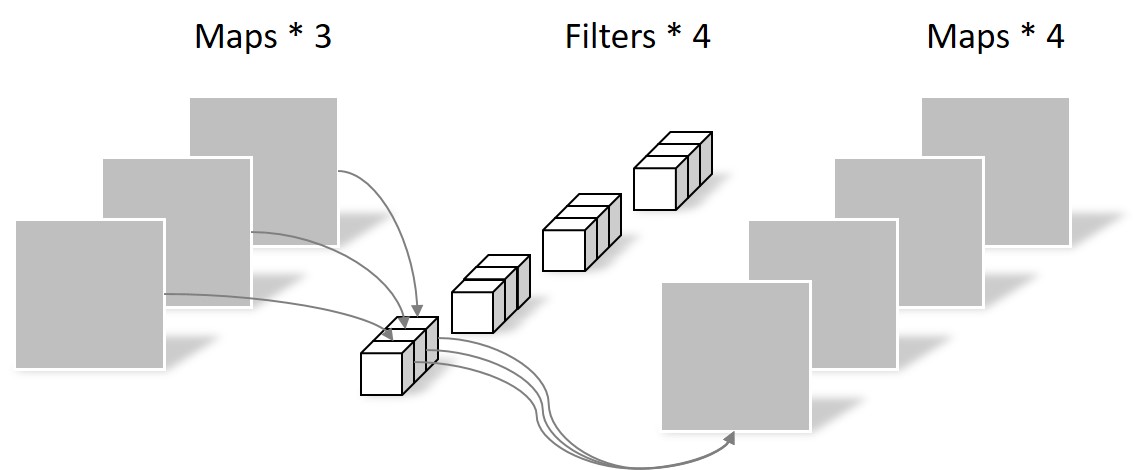

Pointwise Convolution的运算与常规卷积运算非常相似,不同之处在于卷积核的尺寸为 1×1×M,M为上一层的depth。所以这里的卷积运算会将上一步的map在深度方向上进行加权组合,生成新的Feature map。有几个Filter就有几个Feature map。如下图所示。

由于采用的是1×1卷积的方式,此步中卷积涉及到的参数个数可以计算为:

N_pointwise = 1 × 1 × 3 × 4 = 12

经过Pointwise Convolution之后,同样输出了4张Feature map,与常规卷积的输出维度相同。

参数对比

回顾一下,常规卷积的参数个数为:

N_std = 4 × 3 × 3 × 3 = 108

Separable Convolution的参数由两部分相加得到:

N_depthwise = 3 × 3 × 3 = 27

N_pointwise = 1 × 1 × 3 × 4 = 12

N_separable = N_depthwise + N_pointwise = 39

相同的输入,同样是得到4张Feature map,Separable Convolution的参数个数是常规卷积的约1/3。因此,在参数量相同的前提下,采用Separable Convolution的神经网络层数可以做的更深。

Xception: Deep Learning with Depthwise Separable Convolutions, François Chollet ↩︎

MobileNets: Efficient Convolutional Neural Networks for Mobile Vision Applications ↩︎

常规卷积,DW卷积和PW卷积的区别相关推荐

- 3d卷积和2d卷积1d卷积运算-CNN卷积核与通道讲解

全网最全的卷积运算过程:https://blog.csdn.net/Lucinda6/article/details/115575534?spm=1001.2101.3001.6661.1&u ...

- 一文教你搞懂2D卷积和3D卷积

前言 本人最近在搞毕设时发现自己一直会搞混2D卷积和3D卷积,于是在网上查阅了大量资料,终于明白了其中的原理.希望刷到这篇博客的小伙伴能够停下来静心阅读10分钟,相信你读完之后一定会有所收获. ...

- DW卷积、PW卷积、转置卷积、膨胀卷积(空洞卷积)、可变形卷积一次看个够

Depthwise Separable Convolution也就是深度可分离卷积,应该见过吧,它其实是由depthwise卷积和pointwise卷积组合而成,同样可以用来提取图像特征,但是它的计算 ...

- 在卷积层的运用_Conv 卷积层

onv 卷积层 一.why CNN for image ? 1.Some Patterns are much smaller than the whole image. 一些模式比起整张图片来说更小, ...

- 卷积神经网络(一)- 卷积神经网络

本次学习笔记主要记录学习深度学习时的各种记录,包括吴恩达老师视频学习.花书.作者能力有限,如有错误等,望联系修改,非常感谢! 卷积神经网络(一)- 卷积神经网络 一.计算机视觉(Computer vi ...

- 普通卷积、Depthwise(DW)卷积、Pointwise(PW)卷积、Atrous卷积

转发 https://blog.csdn.net/T_J_S/article/details/94629637 https://www.zhihu.com/question/49630217 普通卷积 ...

- 卷积神经网络的改进 —— 分组卷积、DW 与 PW

1.普通卷积 对于一张5×5像素.三通道彩色输入图片(shape为5×5×3).经过3×3卷积核的卷积层(假设输出通道数为4,则卷积核shape为3×3×3×4),最终输出4个Feature Map, ...

- 分组卷积/转置卷积/空洞卷积/反卷积/可变形卷积/深度可分离卷积/DW卷积/Ghost卷积/

文章目录 1. 常规卷积 2. 分组卷积 3. 转置卷积 4. 空洞卷积 5. 可变形卷积 6. 深度可分离卷积(Separable Convolution) 6.1 Depthwise Convol ...

- 常用的卷积神经网络-1-卷积和通道

文章目录 CNN 1. CNN基本结构 2. 卷积和通道 2.1 分组卷积(Group Convolution) 2.2 Convolution VS Group Convolution 2.3 Gr ...

最新文章

- hadoop在Browse Directory中文件下载不了

- Caffe代码导读(5):对数据集进行Testing

- vim命令模式和底线_人生苦短!老鸟带你用Vim偷懒!

- linux实现内存共享,Linux共享内存实现

- Java教程:Java字符串替换实例

- java菜单栏支持多种语言,多语工具包multilanguage(java版)

- Kafka 安装部署、集群启动、命令行操作 与 可视化工具 Kafka Tool

- HDU 5050 Divided Land(进制转换)

- 【log4cpp_学习】2_log4cpp配置文件的使用

- H5如何获取内网IP和公网IP

- xtend怎么使用_Xtend 2.3 Beta到来–为另一种JVM语言腾出空间

- 华为防火墙应用层过滤--URL

- linux chrome ui字体,谷歌Chrome 69浏览器标签栏字体模糊的解决方法

- 宏基因组定量、功能注释和高级分析代码

- PS图层混合模式MATLAB实现

- Nvidia Agx Xavier平台MIPI CSI-DHPY驱动调试

- Good Bye 2022: 2023 is NEAR C. Koxia and Number Theory

- SUSCTF 2022圆满落幕,SU战队夺冠

- 浅谈一个完整网站配色方案设计大法2实例篇

- Window server 2008 R2 无法安装tools 解决办法