深度学习入门(三十)卷积神经网络——NiN

深度学习入门(三十)卷积神经网络——NiN

- 前言

- 卷积神经网络——NiN

- 课件

- 网络中的网络NiN

- 全连接层的问题

- NiN块

- NiN架构

- NiN Networks

- 总结

- 教材

- 1 NiN块

- 2 NiN模型

- 3 训练模型

- 4 小结

- 参考文献

前言

核心内容来自博客链接1博客连接2希望大家多多支持作者

本文记录用,防止遗忘

卷积神经网络——NiN

课件

网络中的网络NiN

全连接层的问题

卷积层需要较少的参数ci×co×k2c_i\times c_o\times k^2ci×co×k2

但卷积层后的第一个全连接层的参数

LeNet 16x5x5x120=48k

AlexNet 256x5x5x4096=26M.

VGG 512x7x7x4096= 102M

NiN块

一个卷积层后跟两个全连接层

- 步幅1,无填充,输出形状跟卷积层输出—样

- 起到全连接层的作用

-

NiN架构

无全连接层

交替使用NiN块和步幅为2的最大池化层

- 逐步减小高宽和增大通道数

最后使用全局平均池化层得到输出

- 其输入通道数是类别数

NiN Networks

总结

1、NiN块使用卷积层加两个1x1卷积层,后者对每个像素增加了非线性性

2、NiN使用全局平均池化层来替代VGG和AlexNet中的全连接层

3、不容易过拟合,更少的参数个数教材

LeNet、AlexNet和VGG都有一个共同的设计模式:通过一系列的卷积层与汇聚层来提取空间结构特征;然后通过全连接层对特征的表征进行处理。 AlexNet和VGG对LeNet的改进主要在于如何扩大和加深这两个模块。 或者,可以想象在这个过程的早期使用全连接层。然而,如果使用了全连接层,可能会完全放弃表征的空间结构。 网络中的网络(NiN)提供了一个非常简单的解决方案:在每个像素的通道上分别使用多层感知机。

1 NiN块

回想一下,卷积层的输入和输出由四维张量组成,张量的每个轴分别对应样本、通道、高度和宽度。 另外,全连接层的输入和输出通常是分别对应于样本和特征的二维张量。 NiN的想法是在每个像素位置(针对每个高度和宽度)应用一个全连接层。 如果我们将权重连接到每个空间位置,我们可以将其视为1×11\times 11×1卷积层,或作为在每个像素位置上独立作用的全连接层。 从另一个角度看,即将空间维度中的每个像素视为单个样本,将通道维度视为不同特征(feature)。

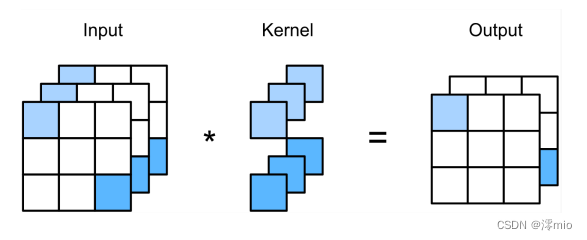

下图说明了VGG和NiN及它们的块之间主要架构差异。 NiN块以一个普通卷积层开始,后面是两个1×11 \times 11×1的卷积层。这两个1×11 \times 11×1卷积层充当带有ReLU激活函数的逐像素全连接层。 第一层的卷积窗口形状通常由用户设置。 随后的卷积窗口形状固定为1×11 \times 11×1。

import torch from torch import nn from d2l import torch as d2ldef nin_block(in_channels, out_channels, kernel_size, strides, padding):return nn.Sequential(nn.Conv2d(in_channels, out_channels, kernel_size, strides, padding),nn.ReLU(),nn.Conv2d(out_channels, out_channels, kernel_size=1), nn.ReLU(),nn.Conv2d(out_channels, out_channels, kernel_size=1), nn.ReLU())2 NiN模型

最初的NiN网络是在AlexNet后不久提出的,显然从中得到了一些启示。 NiN使用窗口形状为11×1111\times 1111×11、5×55\times 55×5和3×33\times 33×3的卷积层,输出通道数量与AlexNet中的相同。 每个NiN块后有一个最大汇聚层,汇聚窗口形状为3×33\times 33×3,步幅为2。

NiN和AlexNet之间的一个显著区别是NiN完全取消了全连接层。 相反,NiN使用一个NiN块,其输出通道数等于标签类别的数量。最后放一个全局平均汇聚层(global average pooling layer),生成一个对数几率 (logits)。NiN设计的一个优点是,它显著减少了模型所需参数的数量。然而,在实践中,这种设计有时会增加训练模型的时间。

net = nn.Sequential(nin_block(1, 96, kernel_size=11, strides=4, padding=0),nn.MaxPool2d(3, stride=2),nin_block(96, 256, kernel_size=5, strides=1, padding=2),nn.MaxPool2d(3, stride=2),nin_block(256, 384, kernel_size=3, strides=1, padding=1),nn.MaxPool2d(3, stride=2),nn.Dropout(0.5),# 标签类别数是10nin_block(384, 10, kernel_size=3, strides=1, padding=1),nn.AdaptiveAvgPool2d((1, 1)),# 将四维的输出转成二维的输出,其形状为(批量大小,10)nn.Flatten())我们创建一个数据样本来查看每个块的输出形状。

X = torch.rand(size=(1, 1, 224, 224)) for layer in net:X = layer(X)print(layer.__class__.__name__,'output shape:\t', X.shape)输出:

Sequential output shape: torch.Size([1, 96, 54, 54]) MaxPool2d output shape: torch.Size([1, 96, 26, 26]) Sequential output shape: torch.Size([1, 256, 26, 26]) MaxPool2d output shape: torch.Size([1, 256, 12, 12]) Sequential output shape: torch.Size([1, 384, 12, 12]) MaxPool2d output shape: torch.Size([1, 384, 5, 5]) Dropout output shape: torch.Size([1, 384, 5, 5]) Sequential output shape: torch.Size([1, 10, 5, 5]) AdaptiveAvgPool2d output shape: torch.Size([1, 10, 1, 1]) Flatten output shape: torch.Size([1, 10])3 训练模型

和以前一样,我们使用Fashion-MNIST来训练模型。训练NiN与训练AlexNet、VGG时相似。

lr, num_epochs, batch_size = 0.1, 10, 128 train_iter, test_iter = d2l.load_data_fashion_mnist(batch_size, resize=224) d2l.train_ch6(net, train_iter, test_iter, num_epochs, lr, d2l.try_gpu())输出:

loss 0.363, train acc 0.865, test acc 0.879 3212.2 examples/sec on cuda:0

4 小结

1、NiN使用由一个卷积层和多个1×11\times 11×1卷积层组成的块。该块可以在卷积神经网络中使用,以允许更多的每像素非线性。

2、NiN去除了容易造成过拟合的全连接层,将它们替换为全局平均汇聚层(即在所有位置上进行求和)。该汇聚层通道数量为所需的输出数量(例如,Fashion-MNIST的输出为10)。

3、移除全连接层可减少过拟合,同时显著减少NiN的参数。

4、NiN的设计影响了许多后续卷积神经网络的设计。

参考文献

[1] Lin, M., Chen, Q., & Yan, S. (2013). Network in network. arXiv preprint arXiv:1312.4400.

深度学习入门(三十)卷积神经网络——NiN相关推荐

- 3天入门python深度学习第三天卷积神经网络讲解

大纲

- 深度学习第三天-卷积神经网络(CNN):乳腺癌识别

>- 参考文章地址: >- 本文为[

- 深度学习时间序列预测:卷积神经网络(CNN)算法构建单变量时间序列预测模型预测空气质量(PM2.5)+代码实战

深度学习时间序列预测:卷积神经网络(CNN)算法构建单变量时间序列预测模型预测空气质量(PM2.5)+代码实战 神经网络(neual networks)是人工智能研究领域的一部分,当前最流行的神经网络 ...

- 深度学习笔记其五:卷积神经网络和PYTORCH

深度学习笔记其五:卷积神经网络和PYTORCH 1. 从全连接层到卷积 1.1 不变性 1.2 多层感知机的限制 1.2.1 平移不变性 1.2.2 局部性 1.3 卷积 1.4 "沃尔多在 ...

- 学习笔记:深度学习(3)——卷积神经网络(CNN)理论篇

学习时间:2022.04.10~2022.04.12 文章目录 3. 卷积神经网络CNN 3.1 卷积神经网络的概念 3.1.1 什么是CNN? 3.1.2 为什么要用CNN? 3.1.3 人类的视觉 ...

- 花书+吴恩达深度学习(十三)卷积神经网络 CNN 之运算过程(前向传播、反向传播)

目录 0. 前言 1. 单层卷积网络 2. 各参数维度 3. CNN 前向传播反向传播 如果这篇文章对你有一点小小的帮助,请给个关注,点个赞喔~我会非常开心的~ 花书+吴恩达深度学习(十)卷积神经网络 ...

- 花书+吴恩达深度学习(十一)卷积神经网络 CNN 之池化层

目录 0. 前言 1. 最大池化(max pooling) 2. 平移不变形 3. 其他池化函数 4. 卷积和池化作为一种无限强的先验 如果这篇文章对你有一点小小的帮助,请给个关注,点个赞喔~我会非常 ...

- 系统学习深度学习(三十八)--深度确定性策略梯度(DDPG)

转自:https://www.cnblogs.com/pinard/p/10345762.html 1. 从随机策略到确定性策略 从DDPG这个名字看,它是由D(Deep)+D(Determinist ...

- 深度学习实战3-文本卷积神经网络(TextCNN)新闻文本分类

文章目录 一.前期工作 1. 设置GPU 2. 导入预处理词库类 二.导入预处理词库类 三.参数设定 四.创建模型 五.训练模型函数 六.测试模型函数 七.训练模型与预测 今天给大家带来一个简单的中文 ...

- 【深度学习】Tensorflow搭建卷积神经网络实现情绪识别

[深度学习]Tensorflow搭建卷积神经网络实现情绪识别 文章目录 1 Tensorflow的基本使用方法1.1 计算图1.2 Feed1.3 Fetch1.4 其他解释 2 训练一个Tensor ...

最新文章

- 初学ArcGIS API for JavaScript

- 2000年华中科技大学计算机研究生机试真题 对称矩阵

- flatpickr功能强大的日期时间选择器插件

- 手机QQ浏览器如何同时下载多个文件

- java用于保存登录对象怎么写,利用对象流模仿登陆注册功能——Java对象流应用...

- ICPC程序设计题解书籍系列之六:吴永辉:《算法设计编程实验》

- Oracle 迁移至 MySQL 后 需要修改的SQL语句 小总结

- c语言putchar_C语言写一个小程序,胖胖的爱心桃

- 教室录播系统方案_学校教室录播系统解决方案

- JAVA代码实现抖音转载视频无水印视频,亲测通过

- 【税务基础知识】--很实用的常识

- 修复YYC松鼠短视频系统搜索功能无法使用问题

- 逆転裁判5android,逆转裁判5安卓-phoenix wright: ace attorney dual destinies官方app2021免费...

- 李佳琦转行成直播一哥,他做对了哪些事?

- 二代旅游CMS网站管理系统使用手册(二)--目的地管理

- linux怎么查看系统环境变量路径,Linux系统中的环境变量该如何设置与查看

- 程序员和工程师有什么不一样?

- 李开复写给中国大学生的七封信(6/7)

- SE2431L-R高性能 完全集成的RF前端模块 ZigBee 低功耗 蓝牙1.0

- (网络视频监控)面试题12