CNN经典模型:VGGNet

2014年,牛津大学计算机视觉组(Visual Geometry Group)和Google DeepMind公司的研究员一起研发出了新的深度卷积神经网络:VGGNet,并取得了ILSVRC2014比赛分类项目的第二名(第一名是GoogLeNet)和定位项目的第一名。VggNet一共有六种不同的网络结构,但是每种结构都有含有5组卷积,每组卷积都使用3x3的卷积核,每组卷积后进行一个2x2最大池化,接下来是三个全连接层。

VGGNet探索了卷积神经网络的深度与其性能之间的关系,成功地构筑了16~19层深的卷积神经网络,证明了增加网络的深度能够在一定程度上影响网络最终的性能,使错误率大幅下降,同时拓展性又很强,迁移到其它图片数据上的泛化性也非常好。到目前为止,VGG仍然被用来提取图像特征。VGGNet训练后的模型参数在其官方网站上开源了,可用来在特定的图像分类任务上进行再训练(相当于提供了非常好的初始化权重),因此被用在了很多地方。 VGGNet可以看成是加深版本的AlexNet,都是由卷积层、全连接层两大部分构成。

VGG-16 官方代码和ILSVRC模型(Caffe) https://gist.github.com/ksimonyan/211839e770f7b538e2d8

VGG-19 官方代码和ILSVRC模型(Caffe) https://gist.github.com/ksimonyan/3785162f95cd2d5fee77

Tensorflow版 VGG-16/VGG-19 https://github.com/machrisaa/tensorflow-vgg

一、VGG的特点

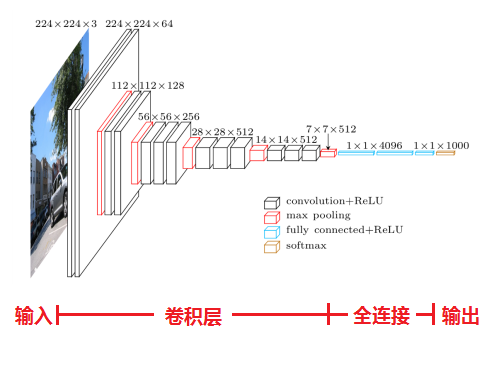

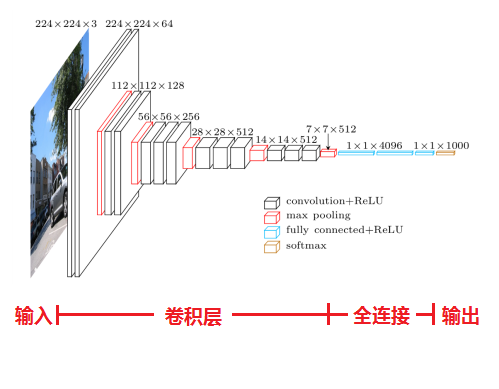

VGG由5层卷积层、3层全连接层、softmax输出层构成,层与层之间使用max-pooling分开,所有隐层的激活单元都采用ReLU函数。VGG的结构图:

1、小卷积核和多卷积子层

VGG使用多个较小卷积核(3x3)的卷积层代替一个卷积核较大的卷积层,一方面可以减少参数,另一方面相当于进行了更多的非线性映射,可以增加网络的拟合/表达能力。小卷积核是VGG的一个重要特点,虽然VGG是在模仿AlexNet的网络结构,但没有采用AlexNet中比较大的卷积核尺寸(如7x7),而是通过降低卷积核的大小(3x3),增加卷积子层数来达到同样的性能(VGG:从1到4卷积子层,AlexNet:1子层)。

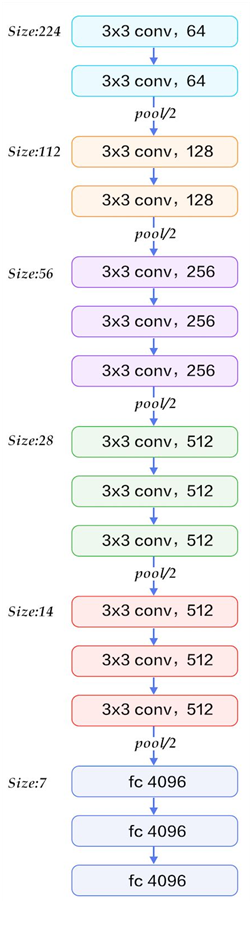

VGGNet拥有5段卷积,每一段内有2~3个卷积层,同时每段尾部会连接一个最大池化层用来缩小图片尺寸。每段内的卷积核数量一样,越靠后的段的卷积核数量越多:64-128-256-512-512。其中经常出现多个完全一样的3*3的卷积层堆叠在一起的情况,这其实是非常有用的设计。

VGG的作者认为两个3x3的卷积堆叠获得的感受野大小,相当一个5x5的卷积;而3个3x3卷积的堆叠获取到的感受野相当于一个7x7的卷积。这样可以增加非线性映射,也能很好地减少参数(例如7x7的参数为49个,而3个3x3的参数为27)三个卷积层的叠加,经过了更多次的非线性变换,对特征的学习能力更强.

2、小池化核

相比AlexNet的3x3的池化核,VGG全部采用2x2的池化核。

3、通道数多

VGG网络第一层的通道数为64,后面每层都进行了翻倍,最多到512个通道,通道数的增加,使得更多的信息可以被提取出来。

4、层数更深、特征图更宽

由于卷积核专注于扩大通道数、池化专注于缩小宽和高,使得模型架构上更深更宽的同时,控制了计算量的增加规模。

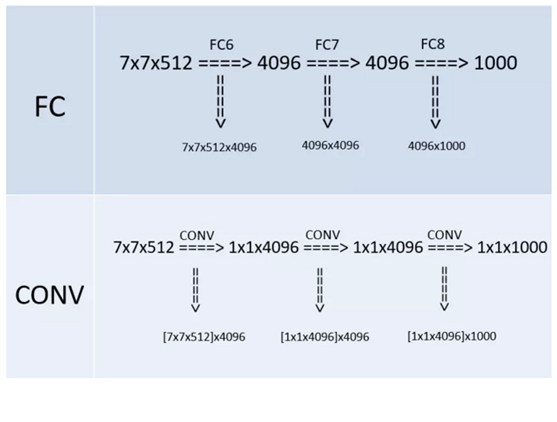

5、全连接转卷积(测试阶段)

这也是VGG的一个特点,在网络测试阶段将训练阶段的三个全连接替换为三个卷积,使得测试得到的全卷积网络因为没有全连接的限制,因而可以接收任意宽或高为的输入,这在测试阶段很重要。如本节第一个图所示,输入图像是224x224x3,如果后面三个层都是全连接,那么在测试阶段就只能将测试的图像全部都要缩放大小到224x224x3,才能符合后面全连接层的输入数量要求,这样就不便于测试工作的开展。

而“全连接转卷积”,替换过程如下:

例如7x7x512的layer要跟4096个神经元的layer做全连接,则替换为对7x7x512的layer做通道数为4096、卷积核为1x1的卷积。

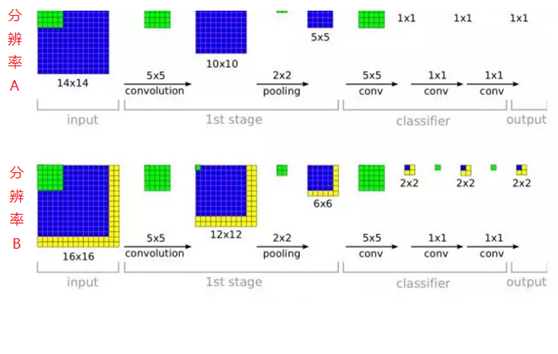

这个“全连接转卷积”的思路是VGG作者参考了OverFeat的工作思路,例如下图是OverFeat将全连接换成卷积后,则可以来处理任意分辨率(在整张图)上计算卷积,这就是无需对原图做重新缩放处理的优势。

二、VGG的网络结构

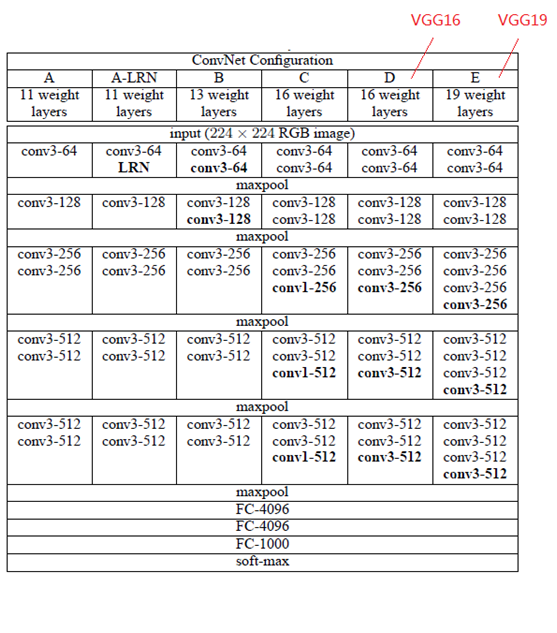

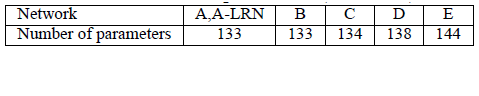

分别使用了A、A-LRN、B、C、D、E这6种网络结构进行测试,这6种网络结构相似,都是由5层卷积层、3层全连接层组成,其中区别在于每个卷积层的子层数量不同,从A至E依次增加(子层数量从1到4),总的网络深度从11层到19层(添加的层以粗体显示),表格中的卷积层参数表示为“conv〈感受野大小〉-通道数〉”,例如con3-128,表示使用3x3的卷积核,通道数为128。为了简洁起见,在表格中不显示ReLU激活功能。其中,网络结构D就是著名的VGG16,网络结构E就是著名的VGG19。

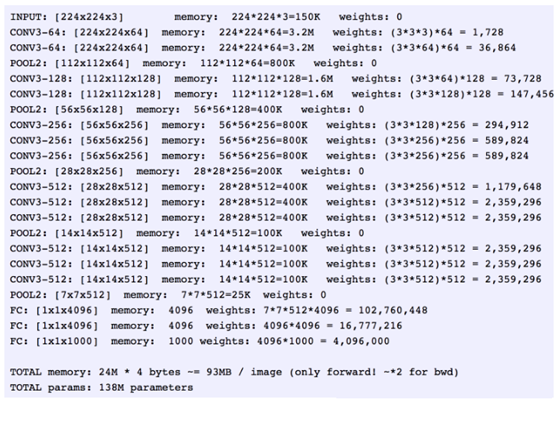

以网络结构D(VGG16)为例,介绍其处理过程如下,请对比上面的表格和下方这张图,留意图中的数字变化,有助于理解VGG16的处理过程:

1、输入224x224x3的图片,经64个3x3的卷积核作两次卷积+ReLU,卷积后的尺寸变为224x224x64

2、作max pooling(最大化池化),池化单元尺寸为2x2(效果为图像尺寸减半),池化后的尺寸变为112x112x64

3、经128个3x3的卷积核作两次卷积+ReLU,尺寸变为112x112x128

4、作2x2的max pooling池化,尺寸变为56x56x128

5、经256个3x3的卷积核作三次卷积+ReLU,尺寸变为56x56x256

6、作2x2的max pooling池化,尺寸变为28x28x256

7、经512个3x3的卷积核作三次卷积+ReLU,尺寸变为28x28x512

8、作2x2的max pooling池化,尺寸变为14x14x512

9、经512个3x3的卷积核作三次卷积+ReLU,尺寸变为14x14x512

10、作2x2的max pooling池化,尺寸变为7x7x512

11、与两层1x1x4096,一层1x1x1000进行全连接+ReLU(共三层)

12、通过softmax输出1000个预测结果

以上就是VGG16(网络结构D)各层的处理过程,A、A-LRN、B、C、E其它网络结构的处理过程也是类似,执行过程如下(以VGG16为例):

从上面的过程可以看出VGG网络结构很简洁的,都是由小卷积核、小池化核、ReLU组合而成。VGG16的简化图如下:

A、A-LRN、B、C、D、E这6种网络结构的深度虽然从11层增加至19层,但参数量变化不大,这是由于基本上都是采用了小卷积核(3x3,只有9个参数),这6种结构的参数数量(百万级)并未发生太大变化,因为网络中,参数主要集中在全连接层。

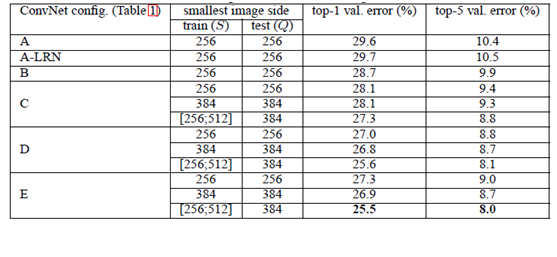

经作者对A、A-LRN、B、C、D、E这6种网络结构进行单尺度的评估,错误率结果如下:

从上表可以看出:

1、LRN层无性能增益(A-LRN)

VGG作者通过网络A-LRN发现,AlexNet曾经用到的LRN层(local response normalization,局部响应归一化)并没有带来性能的提升,因此在其它组的网络中均没再出现LRN层。

2、随着深度增加,分类性能逐渐提高(A、B、C、D、E)

从11层的A到19层的E,网络深度增加对top1和top5的错误率下降很明显。

3、多个小卷积核比单个大卷积核性能好(B)

VGG作者做了实验,用B和自己一个不在实验组里的较浅网络比较,较浅网络用conv5x5来代替B的两个conv3x3,结果显示多个小卷积核比单个大卷积核效果要好。

小结:

1、通过增加深度能有效地提升性能;

2、最佳模型:VGG16,从头到尾只有3x3卷积与2x2池化,简洁优美;

3、测试时,用卷积代替全连接,可适应各种尺寸的图片

关于VGGNet的经典论文《Very Deep Convolutional Networks for Large-Scale Image Recognition》(基于甚深层卷积网络的大规模图像识别),在该论文中对VGG的思想、测试情况进行了详细介绍,建议阅读这篇论文加深了解。论文地址:https://arxiv.org/abs/1409.1556

CNN经典模型:VGGNet相关推荐

- CNN经典模型——VGGNet

VGGNet出自论文<Very Deep Convolutional Networks For Large-Scale Image Recognition>. VGG模型是2014 ...

- CNN经典模型:GoogLeNet(从Inception v1到v4的演进)

GoogLeNet和VGG是2014年ImageNet挑战赛(ILSVRC14)的双雄,GoogLeNet获得第一名.VGG获得第二名,这两类模型结构的共同特点是层次更深了.VGG继承了LeNet以及 ...

- 卷积神经网络(CNN)经典模型分析(一)

CNN经典模型分析

- 动手学深度学习(二十二)——GoogLeNet:CNN经典模型(五)

文章目录 1. 含并行连结的网络(GoogLeNet) 1.1 Inception块 1.2 GoogLeNet模型 2. 动手实现简化的GoogLeNet模型 2.1 实现Inception块 2. ...

- CNN经典模型发展进程

CNN模型合集-Mengcius专栏 [CNN常见模型0--储备知识]深度神经网络(DNN)模型,前向传播算法和反向传播算法(BP) [CNN常见模型0]卷积神经网络(CNN)模型结构 [CNN常见模 ...

- 深度学习方法(五):卷积神经网络CNN经典模型整理Lenet,Alexnet,Googlenet,VGG,Deep Residual Learning

欢迎转载,转载请注明:本文出自Bin的专栏blog.csdn.net/xbinworld. 技术交流QQ群:433250724,欢迎对算法.技术感兴趣的同学加入. 关于卷积神经网络CNN,网络和文献 ...

- 系统学习深度学习(二十二)--CNN经典模型总结

转自:http://www.open-open.com/lib/view/open1473213789568.html 参考:http://blog.csdn.net/qq_17754181/arti ...

- CNN经典模型整理Lenet,Alexnet,Googlenet,VGG,Deep Residual Learning,squeezenet

关于卷积神经网络CNN,网络和文献中有非常多的资料,我在工作/研究中也用了好一段时间各种常见的model了,就想着简单整理一下,以备查阅之需.如果读者是初接触CNN,建议可以先看一看"Dee ...

- CNN经典模型:深度残差网络(DRN)ResNet

一说起"深度学习",自然就联想到它非常显著的特点"深.深.深"(重要的事说三遍),通过很深层次的网络实现准确率非常高的图像识别.语音识别等能力.因此,我们自然很 ...

最新文章

- protobuf-2.6.1生成java文件

- bzoj 1827: [Usaco2010 Mar]gather 奶牛大集会【树形dp】

- git pull问题“error: Your local changes to the following files would be overwritten by merge”解决方案

- CMDB经验分享之 – 剖析CMDB的设计过程

- 第一篇 - 手把手教你理清EOS各种开发环境搭建来龙去脉

- MySQL规格列表(硬件优化上限)

- 树莓派linux共享目录,树莓派局域网文件共享

- mysql不同字符集_如何在mysql中设置不同的字符集

- 带你细品Cookie、Session和Token的区别

- 数据库基础教程(一)

- 分子系统学-多序列比对和系统进化分析教程

- 【服务器】揭秘淘宝286亿海量图片存储与处理架构

- 利用Md2all的自定义CSS,给Markdown一个漂亮的排版

- Python轻松实现地图可视化(附详细源码)

- Linux编译dd源码

- 关闭jupyter notebook报错

- 《Chrome谷歌插件Top10》开发最好用的谷歌插件

- 原创 基于MC3362D的十米波段语音收发机电路图

- Themida是否支持PowerBuilder应用程序的保护?—— Themida常见问答集锦

- 7.Linux文件管理命令---grep:查找字符串