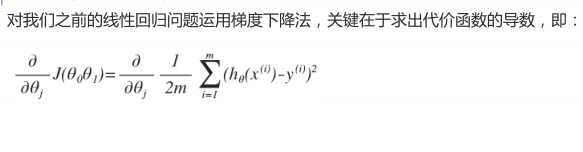

Andrew Ng(coursera)单变量线性回归(LINEAR REGRESSION WITH ONE VARIABLE)

2019独角兽企业重金招聘Python工程师标准>>>

1模型表达(MODEL REPRESENTATION)

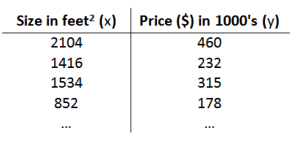

以之前的房屋交易问题为例,假使我们回归问题的训练集(Training Set)如下表所示:

我们将要用来描述这个回归问题的标记如下:

m 代表训练集中实例的数量

x 代表特征/输入变量

y 代表目标变量/输出变量

(x,y) 代表训练集中的实例

(x (i) ,y (i) ) 代表第 i 个观察实例

h 代表学习算法的解决方案或函数也称为假设(hypothesis)

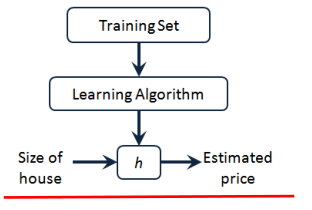

因而,要解决房价预测问题,我们实际上是要将训练集“喂”给我们的学习算法,进而学习得

一个假设 h,然后将我们要预测的房屋的尺寸作为输入变量输入给 h,预测出该房屋的交易价

格作为输出变量输出为结果。

12

那么,对于我们的房价预测问题,我们该如何表达 h?

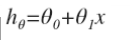

一种可能的表达方式为:

因为只含有一个特征/输入变量,因此这样的问题叫作单变量线性回归问题。

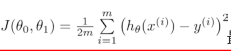

2 代价函数(COST FUNCTION)

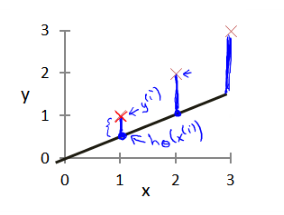

我们现在要做的便是为我们的模型选择合适的参数(parameters)θ 0 和θ 1, 在房价问题这个

例子中便是直线的斜率和在 y 轴上的截距。

我们选择的参数决定了我们得到的直线相对于我们的训练集的准确程度,模型所预测的值与训

练集中实际值之间的差距(下图中蓝线所指)就是建模误差(modeling error)。

我们的目标便是选择出可以使得建模误差的平方和能够最小的模型参数。

即使得代价函数  最小。

最小。

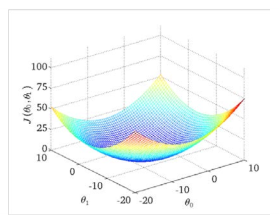

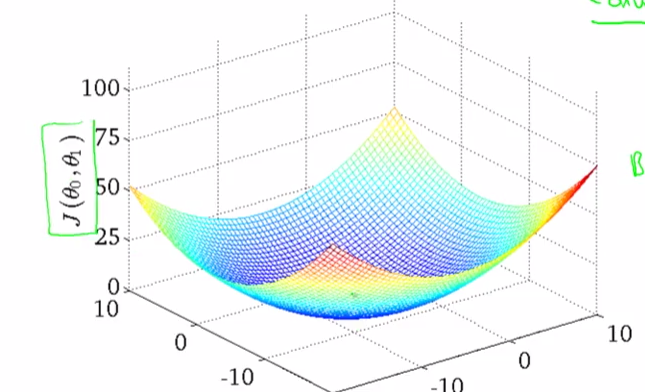

我们绘制一个等高线图,三个坐标分别为θ 0 和θ 1 和 J(θ 0, θ 1 ):

则可以看出在三维空间中存在一个使得 J(θ 0, θ 1 )最小的点。

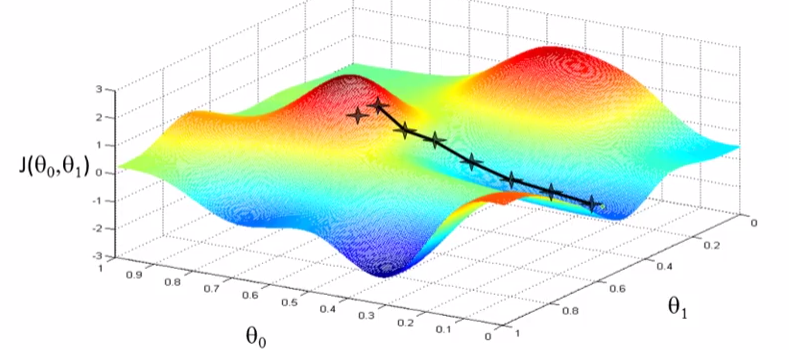

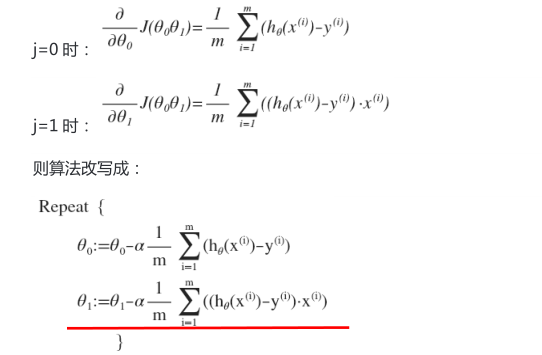

梯度下降是一个用来求函数最小值的算法,我们将使用梯度下降算法来求出代价函数 J(θ 0, θ 1 )

的最小值。

梯度下降背后的思想是:开始时我们随机选择一个参数的组合(θ 0, θ 1,..., θn),计算代价函数,

然后我们寻找下一个能让代价函数值下降最多的参数组合。可以想象成从山上某点往山下走的过程 在起点相处环顾四周选择认为能最快下山的路(最陡),到达一个新的起点,如此重复直到最低点。

在起点相处环顾四周选择认为能最快下山的路(最陡),到达一个新的起点,如此重复直到最低点。

我们持续这么做直到到到一个局部最小值(local minimum),因为我们并没有尝试完所有的参数组合,所以不能确定我们得到的局部最小值是否便是全局最小值(global minimum),选择不同的初始参数组合,可能会

找到不同的局部最小值。

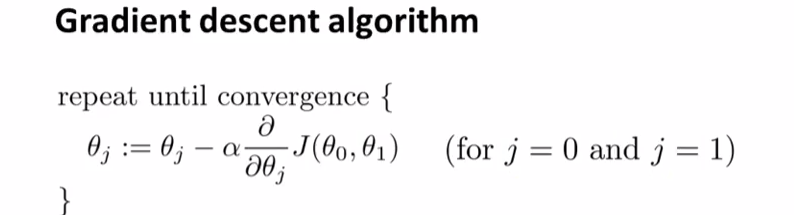

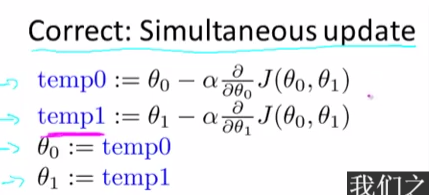

梯度下降算法的定义:

其中 :=为赋值号, 是一个数字称为学习速率,表示下山例子中的一步下山走的路长短

是一个数字称为学习速率,表示下山例子中的一步下山走的路长短

在此基础上不断更新 直到收敛。

直到收敛。

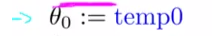

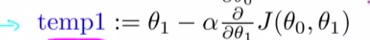

此为一次更新θ 0和θ 1。需要同步更新,不能先

此为一次更新θ 0和θ 1。需要同步更新,不能先 再

再 。

。

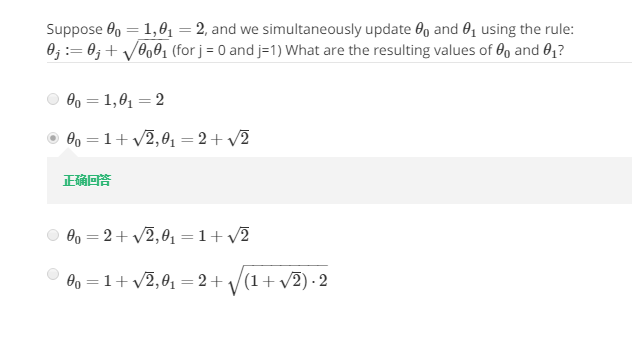

例题:

通常的代价函数的图形都是形如 的碗型,只有一个极小值,因此对代价函数使用梯度下降通常都能得到这个最小值点。

的碗型,只有一个极小值,因此对代价函数使用梯度下降通常都能得到这个最小值点。

以上的梯度下降有时候也称为批量梯度下降,指的是在每一步梯度下降中我们都用到了所有的训练样本。

当然有时候的梯度下降并不是考虑所有的训练样本,而是只选取其中的一个子集

转载于:https://my.oschina.net/zlb1992/blog/755608

Andrew Ng(coursera)单变量线性回归(LINEAR REGRESSION WITH ONE VARIABLE)相关推荐

- Coursera公开课笔记: 斯坦福大学机器学习第二课“单变量线性回归(Linear regression with one variable)”

Coursera公开课笔记: 斯坦福大学机器学习第二课"单变量线性回归(Linear regression with one variable)" 发表于 2012年05月6号 由 ...

- Ng第二课:单变量线性回归(Linear Regression with One Variable)

二.单变量线性回归(Linear Regression with One Variable) 2.1 模型表示 2.2 代价函数 2.3 代价函数的直观理解 2.4 梯度下降 2.5 梯度下 ...

- 【机器学习】Andrew Ng——02单变量线性回归

单变量线性回归 房屋价格问题 首先我们来看卖房问题,如果有朋友想要出售房屋,如何根据已有数据来预测房屋的销售价格.下图所展示的是在第一章概述中提及的有监督学习的回归问题,对于每个样本的输入,都有正 ...

- Stanford机器学习---第二讲. 多变量线性回归 Linear Regression with multiple variable

本栏目(Machine learning)包括单参数的线性回归.多参数的线性回归.Octave Tutorial.Logistic Regression.Regularization.神经网络.机器学 ...

- 单变量与多变量线性回归(Linear Regression with One Variable)

2.1 线性回归算法模型表示 让我们通过一个例子来开始:这个例子是预测住房价格的,我们要使用一个数据集,数据集包含俄勒冈州波特兰市的住房价格.在这里,我要根据不同房屋尺寸所售出的价格,画出我的数据集. ...

- 机器学习代码实战——线性回归(单变量)(Linear Regression)

文章目录 1.实验目的 2.导入必要模块并读取数据 3.画当前数据分布散点图 4.提取数据和标签 5.训练+预测 1.实验目的 使用线性回归模型预测2020年加拿大公民的人均收入. 数据链接 密码:z ...

- 斯坦福大学机器学习第二课 “单变量线性回归”

斯坦福大学机器学习第二课"单变量线性回归(Linear regression with one variable)" 发表于 2012年05月6号 由 52nlp 斯坦福大学机器学 ...

- CS229学习笔记(1)引言、单变量线性回归

一.引言 1. 机器学习的定义 Tom Mitchell定义的机器学习是,一个程序被认为能从经验E中学习,解决任务T,达到性能度量值P,当且仅当,有了经验E后,经过P评判,程序在处理T时的性能有所提升 ...

- 斯坦福大学吴恩达机器学习教程中文笔记——week1——引言,单变量线性回归,线性代数回顾

第1周 文章目录 第1周 @[toc] 引言(Introduction) 1.1 欢迎 1.2 机器学习是什么? 1.3 监督学习 1.4 无监督学习 二.单变量线性回归(Linear Regress ...

- Stanford机器学习---第一讲. Linear Regression with one variable

本栏目(Machine learning)包括单参数的线性回归.多参数的线性回归.Octave Tutorial.Logistic Regression.Regularization.神经网络.机器学 ...

最新文章

- 曾被无视多年,却成就19世纪最伟大的一场革命,影响了整个世界!

- 用计算机处理信息可以分为四个过程,大学计算机基础期末考试样题3

- 内存的静态分配和动态分配的区别【转】 静态分配内存与动态分配内存的区别

- Python高级语法-正则表达式

- ad域需要自建dns服务器吗,创建AD DS域服务(图文详解)

- 分布式应用中的一致性协议

- SpringAs3的一些配置参数

- https无法访问 宝塔_解决宝塔面板开启自带免费Let's Encrypt SSL证书后网站无法访问...

- 语音识别算法研究及实现.doc

- 什么是开放源代码,以及为什么不使用开放源代码?

- 微信小程序 会议室课堂考勤签到助手 源码

- java解惑之最后的笑声

- android设计模式面试,从外包公司到今日头条offer,吐血整理

- 经济学人翻译练习——肯•帕克斯顿的再次竞选是对德克萨斯共和党价值观的考验

- java 跳过法定节假日和双休

- 涨知识了!阿里规定超过三张表禁止join,为啥?

- 以梦为马,扬帆起航,双非人的2021,万字逐梦旅

- 计算机文化教育对学生思维品质的影响,信息技术教育让素质教育绽放“光芒”...

- python输入abcd输出对应的1234_python语法部分

- 新世纪福音战士剧场版(EVA破)蓝光BD高清下载