t-sne算法用于处理词嵌入中的高维降维问题

t-SNE完整笔记

2017年02月05日 机器学习 机器学习 字数:26531

t-SNE(t-distributed stochastic neighbor embedding)是用于降维的一种机器学习算法,是由 Laurens van der Maaten 和 Geoffrey Hinton在08年提出来。此外,t-SNE 是一种非线性降维算法,非常适用于高维数据降维到2维或者3维,进行可视化。

t-SNE是由SNE(Stochastic Neighbor Embedding, SNE; Hinton and Roweis, 2002)发展而来。我们先介绍SNE的基本原理,之后再扩展到t-SNE。最后再看一下t-SNE的实现以及一些优化。

目录

- 1.SNE

- 1.1基本原理

- 1.2 SNE原理推导

- 2.t-SNE

- 2.1 Symmetric SNE

- 2.2 Crowding问题

- 2.3 t-SNE

- 2.4 算法过程

- 2.5 不足

- 3.变种

- 4.参考文档

- 5. 代码

1.SNE

1.1基本原理

SNE是通过仿射(affinitie)变换将数据点映射到概率分布上,主要包括两个步骤:

- SNE构建一个高维对象之间的概率分布,使得相似的对象有更高的概率被选择,而不相似的对象有较低的概率被选择。

- SNE在低维空间里在构建这些点的概率分布,使得这两个概率分布之间尽可能的相似。

我们看到t-SNE模型是非监督的降维,他跟kmeans等不同,他不能通过训练得到一些东西之后再用于其它数据(比如kmeans可以通过训练得到k个点,再用于其它数据集,而t-SNE只能单独的对数据做操作,也就是说他只有fit_transform,而没有fit操作)

1.2 SNE原理推导

SNE是先将欧几里得距离转换为条件概率来表达点与点之间的相似度。具体来说,给定一个N个高维的数据 x1,...,xNx1,...,xN(注意N不是维度), t-SNE首先是计算概率pijpij,正比于xixi和xjxj之间的相似度(这种概率是我们自主构建的),即:

这里的有一个参数是σiσi,对于不同的点xixi取值不一样,后续会讨论如何设置。此外设置px∣x=0px∣x=0,因为我们关注的是两两之间的相似度。

那对于低维度下的yiyi,我们可以指定高斯分布为方差为12√12,因此它们之间的相似度如下:

同样,设定qi∣i=0qi∣i=0.

如果降维的效果比较好,局部特征保留完整,那么 pi∣j=qi∣jpi∣j=qi∣j, 因此我们优化两个分布之间的距离-KL散度(Kullback-Leibler divergences),那么目标函数(cost function)如下:

这里的PiPi表示了给定点xixi下,其他所有数据点的条件概率分布。需要注意的是KL散度具有不对称性,在低维映射中不同的距离对应的惩罚权重是不同的,具体来说:距离较远的两个点来表达距离较近的两个点会产生更大的cost,相反,用较近的两个点来表达较远的两个点产生的cost相对较小(注意:类似于回归容易受异常值影响,但效果相反)。即用较小的 qj∣i=0.2qj∣i=0.2 来建模较大的 pj∣i=0.8pj∣i=0.8, cost=plog(pq)plog(pq)=1.11,同样用较大的qj∣i=0.8qj∣i=0.8来建模较大的pj∣i=0.2pj∣i=0.2, cost=-0.277, 因此,SNE会倾向于保留数据中的局部特征。

思考:了解了基本思路之后,你会怎么选择σσ,固定初始化?

下面我们开始正式的推导SNE。首先不同的点具有不同的σiσi,PiPi的熵(entropy)会随着σiσi的增加而增加。SNE使用困惑度(perplexity)的概念,用二分搜索的方式来寻找一个最佳的σσ。其中困惑度指:

这里的H(Pi)H(Pi)是PiPi的熵,即:

困惑度可以解释为一个点附近的有效近邻点个数。SNE对困惑度的调整比较有鲁棒性,通常选择5-50之间,给定之后,使用二分搜索的方式寻找合适的σσ

那么核心问题是如何求解梯度了,目标函数等价于∑∑−plog(q)∑∑−plog(q)这个式子与softmax非常的类似,我们知道softmax的目标函数是∑−ylogp∑−ylogp,对应的梯度是y−py−p(注:这里的softmax中y表示label,p表示预估值)。 同样我们可以推导SNE的目标函数中的i在j下的条件概率情况的梯度是2(pi∣j−qi∣j)(yi−yj)2(pi∣j−qi∣j)(yi−yj), 同样j在i下的条件概率的梯度是2(pj∣i−qj∣i)(yi−yj)2(pj∣i−qj∣i)(yi−yj), 最后得到完整的梯度公式如下:

在初始化中,可以用较小的σσ下的高斯分布来进行初始化。为了加速优化过程和避免陷入局部最优解,梯度中需要使用一个相对较大的动量(momentum)。即参数更新中除了当前的梯度,还要引入之前的梯度累加的指数衰减项,如下:

这里的Y(t)Y(t)表示迭代t次的解,ηη表示学习速率,α(t)α(t)表示迭代t次的动量。

此外,在初始优化的阶段,每次迭代中可以引入一些高斯噪声,之后像模拟退火一样逐渐减小该噪声,可以用来避免陷入局部最优解。因此,SNE在选择高斯噪声,以及学习速率,什么时候开始衰减,动量选择等等超参数上,需要跑多次优化才可以。

思考:SNE有哪些不足? 面对SNE的不足,你会做什么改进?

2.t-SNE

尽管SNE提供了很好的可视化方法,但是他很难优化,而且存在”crowding problem”(拥挤问题)。后续中,Hinton等人又提出了t-SNE的方法。与SNE不同,主要如下:

- 使用对称版的SNE,简化梯度公式

- 低维空间下,使用t分布替代高斯分布表达两点之间的相似度

t-SNE在低维空间下使用更重长尾分布的t分布来避免crowding问题和优化问题。在这里,首先介绍一下对称版的SNE,之后介绍crowding问题,之后再介绍t-SNE。

2.1 Symmetric SNE

优化pi∣jpi∣j和qi∣jqi∣j的KL散度的一种替换思路是,使用联合概率分布来替换条件概率分布,即P是高维空间里各个点的联合概率分布,Q是低维空间下的,目标函数为:

这里的piipii,qiiqii为0,我们将这种SNE称之为symmetric SNE(对称SNE),因为他假设了对于任意i,pij=pji,qij=qjipij=pji,qij=qji,因此概率分布可以改写为:

这种表达方式,使得整体简洁了很多。但是会引入异常值的问题。比如xixi是异常值,那么∣∣xi−xj∣∣2∣∣xi−xj∣∣2会很大,对应的所有的j, pijpij都会很小(之前是仅在xixi下很小),导致低维映射下的yiyi对cost影响很小。

思考: 对于异常值,你会做什么改进?pipi表示什么?

为了解决这个问题,我们将联合概率分布定义修正为: pij=pi∣j+pj∣i2pij=pi∣j+pj∣i2, 这保证了∑jpij>12n∑jpij>12n, 使得每个点对于cost都会有一定的贡献。对称SNE的最大优点是梯度计算变得简单了,如下:

实验中,发现对称SNE能够产生和SNE一样好的结果,有时甚至略好一点。

2.2 Crowding问题

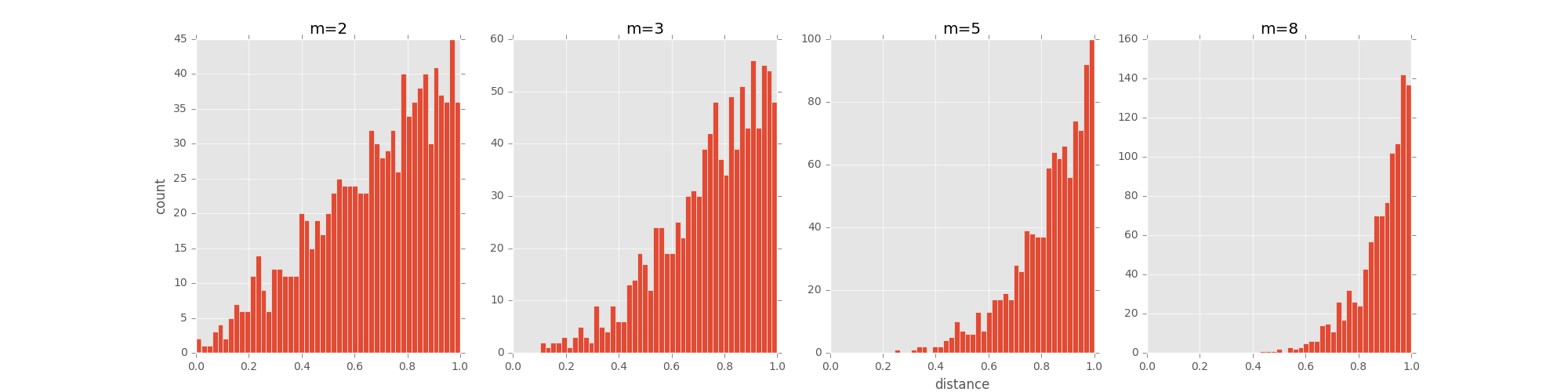

拥挤问题就是说各个簇聚集在一起,无法区分。比如有一种情况,高维度数据在降维到10维下,可以有很好的表达,但是降维到两维后无法得到可信映射,比如降维如10维中有11个点之间两两等距离的,在二维下就无法得到可信的映射结果(最多3个点)。 进一步的说明,假设一个以数据点xixi为中心,半径为r的m维球(三维空间就是球),其体积是按rmrm增长的,假设数据点是在m维球中均匀分布的,我们来看看其他数据点与xixi的距离随维度增大而产生的变化。

从上图可以看到,随着维度的增大,大部分数据点都聚集在m维球的表面附近,与点xixi的距离分布极不均衡。如果直接将这种距离关系保留到低维,就会出现拥挤问题。

怎么解决crowding问题呢?

Cook et al.(2007) 提出一种slight repulsion的方式,在基线概率分布(uniform background)中引入一个较小的混合因子ρρ,这样qijqij就永远不会小于2ρn(n−1)2ρn(n−1) (因为一共了n(n-1)个pairs),这样在高维空间中比较远的两个点之间的qijqij总是会比pijpij大一点。这种称之为UNI-SNE,效果通常比标准的SNE要好。优化UNI-SNE的方法是先让ρρ为0,使用标准的SNE优化,之后用模拟退火的方法的时候,再慢慢增加ρρ. 直接优化UNI-SNE是不行的(即一开始ρρ不为0),因为距离较远的两个点基本是一样的qijqij(等于基线分布), 即使pijpij很大,一些距离变化很难在qijqij中产生作用。也就是说优化中刚开始距离较远的两个聚类点,后续就无法再把他们拉近了。

2.3 t-SNE

对称SNE实际上在高维度下 另外一种减轻”拥挤问题”的方法:在高维空间下,在高维空间下我们使用高斯分布将距离转换为概率分布,在低维空间下,我们使用更加偏重长尾分布的方式来将距离转换为概率分布,使得高维度下中低等的距离在映射后能够有一个较大的距离。

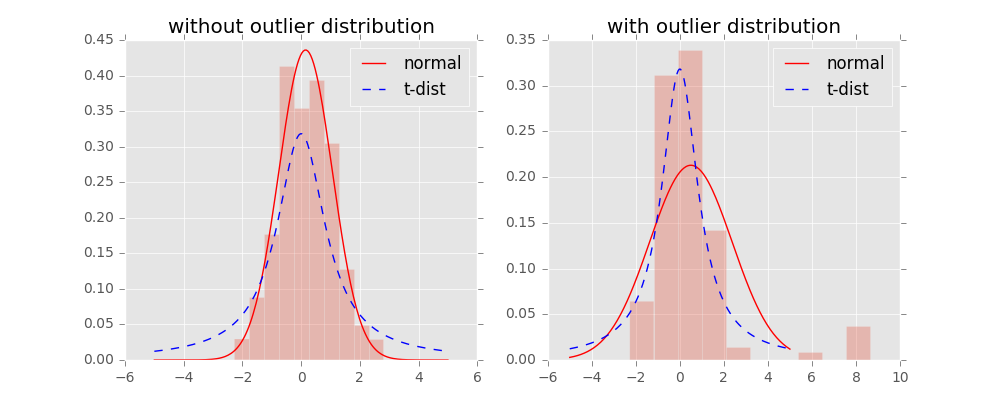

我们对比一下高斯分布和t分布(如上图,code见probability/distribution.md), t分布受异常值影响更小,拟合结果更为合理,较好的捕获了数据的整体特征。

使用了t分布之后的q变化,如下:

此外,t分布是无限多个高斯分布的叠加,计算上不是指数的,会方便很多。优化的梯度如下:

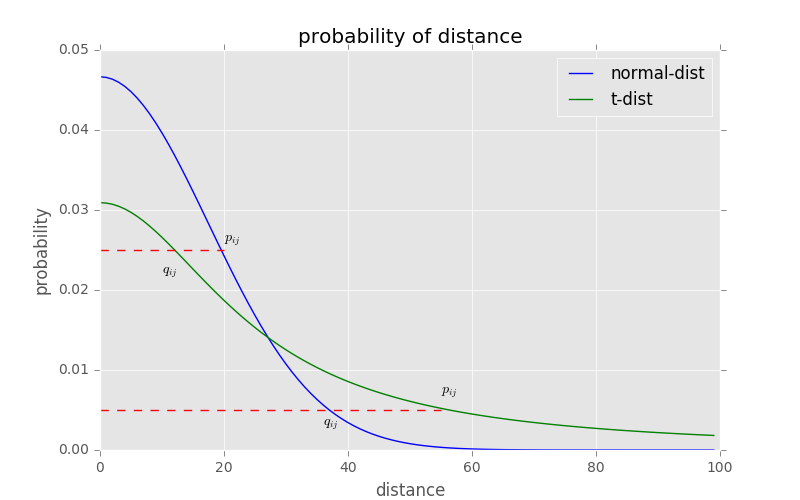

t-sne的有效性,也可以从上图中看到:横轴表示距离,纵轴表示相似度, 可以看到,对于较大相似度的点,t分布在低维空间中的距离需要稍小一点;而对于低相似度的点,t分布在低维空间中的距离需要更远。这恰好满足了我们的需求,即同一簇内的点(距离较近)聚合的更紧密,不同簇之间的点(距离较远)更加疏远。

总结一下,t-SNE的梯度更新有两大优势:

- 对于不相似的点,用一个较小的距离会产生较大的梯度来让这些点排斥开来。

- 这种排斥又不会无限大(梯度中分母),避免不相似的点距离太远。

2.4 算法过程

算法详细过程如下:

- Data: X=x1,...,xnX=x1,...,xn

- 计算cost function的参数:困惑度Perp

- 优化参数: 设置迭代次数T, 学习速率ηη, 动量α(t)α(t)

- 目标结果是低维数据表示 YT=y1,...,ynYT=y1,...,yn

- 开始优化

- 计算在给定Perp下的条件概率pj∣ipj∣i(参见上面公式)

- 令 pij=pj∣i+pi∣j2npij=pj∣i+pi∣j2n

- 用 N(0,10−4I)N(0,10−4I) 随机初始化 Y

- 迭代,从 t = 1 到 T, 做如下操作:

- 计算低维度下的 qijqij(参见上面的公式)

- 计算梯度(参见上面的公式)

- 更新 Yt=Yt−1+ηdCdY+α(t)(Yt−1−Yt−2)Yt=Yt−1+ηdCdY+α(t)(Yt−1−Yt−2)

- 结束

- 结束

优化过程中可以尝试的两个trick:

- 提前压缩(early compression):开始初始化的时候,各个点要离得近一点。这样小的距离,方便各个聚类中心的移动。可以通过引入L2正则项(距离的平方和)来实现。

- 提前夸大(early exaggeration):在开始优化阶段,pijpij乘以一个大于1的数进行扩大,来避免因为qijqij太小导致优化太慢的问题。比如前50次迭代,pijpij乘以4

优化的过程动态图如下:

2.5 不足

主要不足有四个:

- 主要用于可视化,很难用于其他目的。比如测试集合降维,因为他没有显式的预估部分,不能在测试集合直接降维;比如降维到10维,因为t分布偏重长尾,1个自由度的t分布很难保存好局部特征,可能需要设置成更高的自由度。

- t-SNE倾向于保存局部特征,对于本征维数(intrinsic dimensionality)本身就很高的数据集,是不可能完整的映射到2-3维的空间

- t-SNE没有唯一最优解,且没有预估部分。如果想要做预估,可以考虑降维之后,再构建一个回归方程之类的模型去做。但是要注意,t-sne中距离本身是没有意义,都是概率分布问题。

- 训练太慢。有很多基于树的算法在t-sne上做一些改进

3.变种

后续有机会补充。

- multiple maps of t-SNE

- parametric t-SNE

- Visualizing Large-scale and High-dimensional Data

4.参考文档

- Maaten, L., & Hinton, G. (2008). Visualizing data using t-SNE. Journal of Machine Learning Research.

5. 代码

文中的插图绘制:

# coding:utf-8import numpy as np

from numpy.linalg import norm

from matplotlib import pyplot as plt

plt.style.use('ggplot')def sne_crowding():npoints = 1000 # 抽取1000个m维球内均匀分布的点plt.figure(figsize=(20, 5))for i, m in enumerate((2, 3, 5, 8)):# 这里模拟m维球中的均匀分布用到了拒绝采样,# 即先生成m维立方中的均匀分布,再剔除m维球外部的点accepts = []while len(accepts) < 1000:points = np.random.rand(500, m)accepts.extend([d for d in norm(points, axis=1)if d <= 1.0]) # 拒绝采样accepts = accepts[:npoints]ax = plt.subplot(1, 4, i+1)if i == 0:ax.set_ylabel('count')if i == 2:ax.set_xlabel('distance')ax.hist(accepts, bins=np.linspace(0., 1., 50))ax.set_title('m=%s' %m)plt.savefig("./images/sne_crowding.png")x = np.linspace(0, 4, 100)ta = 1 / (1 + np.square(x))tb = np.sum(ta) - 1qa = np.exp(-np.square(x))qb = np.sum(qa) - 1def sne_norm_t_dist_cost():plt.figure(figsize=(8, 5))plt.plot(qa/qb, c="b", label="normal-dist")plt.plot(ta/tb, c="g", label="t-dist")plt.plot((0, 20), (0.025, 0.025), 'r--')plt.text(10, 0.022, r'$q_{ij}$')plt.text(20, 0.026, r'$p_{ij}$')plt.plot((0, 55), (0.005, 0.005), 'r--')plt.text(36, 0.003, r'$q_{ij}$')plt.text(55, 0.007, r'$p_{ij}$')plt.title("probability of distance")plt.xlabel("distance")plt.ylabel("probability")plt.legend()plt.savefig("./images/sne_norm_t_dist_cost.png")if __name__ == '__main__':sne_crowding()sne_norm_t_dist_cost()附录一下t-sne的完整代码实现:

# coding utf-8

'''

代码参考了作者Laurens van der Maaten的开放出的t-sne代码, 并没有用类进行实现,主要是优化了计算的实现

'''

import numpy as npdef cal_pairwise_dist(x):'''计算pairwise 距离, x是matrix(a-b)^2 = a^w + b^2 - 2*a*b'''sum_x = np.sum(np.square(x), 1)dist = np.add(np.add(-2 * np.dot(x, x.T), sum_x).T, sum_x)return distdef cal_perplexity(dist, idx=0, beta=1.0):'''计算perplexity, D是距离向量,idx指dist中自己与自己距离的位置,beta是高斯分布参数这里的perp仅计算了熵,方便计算'''prob = np.exp(-dist * beta)# 设置自身prob为0prob[idx] = 0sum_prob = np.sum(prob)perp = np.log(sum_prob) + beta * np.sum(dist * prob) / sum_probprob /= sum_probreturn perp, probdef seach_prob(x, tol=1e-5, perplexity=30.0):'''二分搜索寻找beta,并计算pairwise的prob'''# 初始化参数print("Computing pairwise distances...")(n, d) = x.shapedist = cal_pairwise_dist(x)pair_prob = np.zeros((n, n))beta = np.ones((n, 1))# 取log,方便后续计算base_perp = np.log(perplexity)for i in range(n):if i % 500 == 0:print("Computing pair_prob for point%s of%s ..." %(i,n))betamin = -np.infbetamax = np.infperp, this_prob = cal_perplexity(dist[i], i, beta[i])# 二分搜索,寻找最佳sigma下的probperp_diff = perp - base_perptries = 0while np.abs(perp_diff) > tol and tries < 50:if perp_diff > 0:betamin = beta[i].copy()if betamax == np.inf or betamax == -np.inf:beta[i] = beta[i] * 2else:beta[i] = (beta[i] + betamax) / 2else:betamax = beta[i].copy()if betamin == np.inf or betamin == -np.inf:beta[i] = beta[i] / 2else:beta[i] = (beta[i] + betamin) / 2# 更新perb,prob值perp, this_prob = cal_perplexity(dist[i], i, beta[i])perp_diff = perp - base_perptries = tries + 1# 记录prob值pair_prob[i,] = this_probprint("Mean value of sigma: ", np.mean(np.sqrt(1 / beta)))return pair_probdef pca(x, no_dims = 50):''' PCA算法使用PCA先进行预降维'''print("Preprocessing the data using PCA...")(n, d) = x.shapex = x - np.tile(np.mean(x, 0), (n, 1))l, M = np.linalg.eig(np.dot(x.T, x))y = np.dot(x, M[:,0:no_dims])return ydef tsne(x, no_dims=2, initial_dims=50, perplexity=30.0, max_iter=1000):"""Runs t-SNE on the dataset in the NxD array xto reduce its dimensionality to no_dims dimensions.The syntaxis of the function is Y = tsne.tsne(x, no_dims, perplexity),where x is an NxD NumPy array."""# Check inputsif isinstance(no_dims, float):print("Error: array x should have type float.")return -1if round(no_dims) != no_dims:print("Error: number of dimensions should be an integer.")return -1# 初始化参数和变量x = pca(x, initial_dims).real(n, d) = x.shapeinitial_momentum = 0.5final_momentum = 0.8eta = 500min_gain = 0.01y = np.random.randn(n, no_dims)dy = np.zeros((n, no_dims))iy = np.zeros((n, no_dims))gains = np.ones((n, no_dims))# 对称化P = seach_prob(x, 1e-5, perplexity)P = P + np.transpose(P)P = P / np.sum(P)# early exaggerationP = P * 4P = np.maximum(P, 1e-12)# Run iterationsfor iter in range(max_iter):# Compute pairwise affinitiessum_y = np.sum(np.square(y), 1)num = 1 / (1 + np.add(np.add(-2 * np.dot(y, y.T), sum_y).T, sum_y))num[range(n), range(n)] = 0Q = num / np.sum(num)Q = np.maximum(Q, 1e-12)# Compute gradientPQ = P - Qfor i in range(n):dy[i,:] = np.sum(np.tile(PQ[:,i] * num[:,i], (no_dims, 1)).T * (y[i,:] - y), 0)# Perform the updateif iter < 20:momentum = initial_momentumelse:momentum = final_momentumgains = (gains + 0.2) * ((dy > 0) != (iy > 0)) + (gains * 0.8) * ((dy > 0) == (iy > 0))gains[gains < min_gain] = min_gainiy = momentum * iy - eta * (gains * dy)y = y + iyy = y - np.tile(np.mean(y, 0), (n, 1))# Compute current value of cost functionif (iter + 1) % 100 == 0:if iter > 100:C = np.sum(P * np.log(P / Q))else:C = np.sum( P/4 * np.log( P/4 / Q))print("Iteration ", (iter + 1), ": error is ", C)# Stop lying about P-valuesif iter == 100:P = P / 4print("finished training!")return yif __name__ == "__main__":# Run Y = tsne.tsne(X, no_dims, perplexity) to perform t-SNE on your dataset.X = np.loadtxt("mnist2500_X.txt")labels = np.loadtxt("mnist2500_labels.txt")Y = tsne(X, 2, 50, 20.0)from matplotlib import pyplot as pltplt.scatter(Y[:,0], Y[:,1], 20, labels)plt.show()Copyright ©2017 chrispher — 转载文章请注明作者和出处! Powered by with Jekyll

t-sne算法用于处理词嵌入中的高维降维问题相关推荐

- 【自然语言处理】【词嵌入】dLCE:将词汇对比集成到近义反义的词嵌入中

Integrating distributional lexical contrast into word embeddings for antonym synonym 文章目录 Integratin ...

- c语言哈密顿路径算法,用于检查给定图中是否存在哈密顿循环或路径的C ++程序...

哈密顿循环是哈密顿路径,因此从哈密顿路径的最后一个顶点到第一个顶点有一条边(在图中).它在无向图中是一条路径,该路径恰好访问该图的每个顶点一次. 功能和目的:Begin 1.function isSa ...

- 在 Keras 模型中使用预训练的词嵌入

原文地址在这里. 什么是词嵌入? "词嵌入"是一系列旨在将语义映射到几何空间的自然语言处理技术.这是通过将数字向量与字典中的每个单词相关联来完成的,这样任何两个向量之间的距离(例如 ...

- 吴恩达老师深度学习视频课笔记:自然语言处理与词嵌入

Word representation:词嵌入(word embedding),是语言表示的一种方式,可以让算法自动理解一些类似的词比如男人.女人,国王.王后等.通过词嵌入的概念,即使你的模型标记的训 ...

- 2.10 词嵌入除偏-深度学习第五课《序列模型》-Stanford吴恩达教授

词嵌入除偏 (Debiasing Word Embeddings) 现在机器学习和人工智能算法正渐渐地被信任用以辅助或是制定极其重要的决策,因此我们想尽可能地确保它们不受非预期形式偏见影响,比如说性别 ...

- 深度学习笔记 第五门课 序列模型 第二周 自然语言处理与词嵌入

本文是吴恩达老师的深度学习课程[1]笔记部分. 作者:黄海广[2] 主要编写人员:黄海广.林兴木(第四所有底稿,第五课第一二周,第三周前三节).祝彦森:(第三课所有底稿).贺志尧(第五课第三周底稿). ...

- 嵌入式和非嵌入式_我如何向非技术同事解释词嵌入

嵌入式和非嵌入式 数据科学 (Data Science) Word embeddings. 词嵌入. What are they? What do they look like? How are th ...

- 文档词频矩阵_论文理解:从词嵌入到文档距离

论文作者简介 本论文第一作者Matt J. Kusner是牛津大学的副教授,致力于设计适应现实世界问题需求的新机器学习模型(例如,fair algorithms, discrete generativ ...

- python词嵌入_【自然语言处理】收藏!使用Python的4种句嵌入技术

人类理解语言细微差别的能力是非常强大的--我们敏锐的大脑可以在一句话里轻易地感受到幽默.讽刺.负面情绪等,但发挥这个"超能力"的前提是,我们必须知道话语所使用的语言. 例如,如果有 ...

最新文章

- 面霸:Redis 为什么这么快?

- sparkSession常见参数设置

- DbHelper重用性方案 优化工具类 jdbc

- ECCV 2020 论文大盘点-3D人体姿态估计篇

- configure/make的shared object参数

- 20200519每日一句

- idea插件开发可能出现的问题

- rax Picture组件

- 算法基础篇-05-排序-LowB三人组(冒泡/选择/插入排序)

- 嵌入式linux开发,flex库移植

- 使用Vivado软件进行硬件调试

- 推荐 130 个令你眼前一亮的网站,总有一个用得着

- 探索式测试之隐喻(种植)

- ORA-02396:超出最大空闲时间,请重新连接

- 没有如愿的人生,只有幸福的生活

- 4399笔试面试——感受

- 无线智能通信配电台区智能化应用

- 被严重忽略的一款《经济学人》官方产品

- Mysql 创建管理数据库内容上的打字练习

- htmlcss小白标签篇

热门文章

- android系统recovery模式,Android系统Recovery模式中文详细说明

- JavaScript百炼成仙1.16 数组方法

- TensorFlow的几点小知识

- 基于EasyDarwin云视频平台的幼儿园视频直播(手机直播/微信直播)解决方案

- 【嵌入式07】寄存器映射原理详解,GPIO端口的初始化设置步骤

- 低于90分的成绩 java_查询平均成绩低于60分的学生学号、姓名及成绩。

- bugku crypto-python_jail

- 大数据之数仓基石Hive3.1.2实战

- windows server 2012 R2 安装桌面体验,安装ActiveSync时提示缺少Windows组件

- 如何判断一个整型数字是不是对称数字

Symmetric SNE那节的联合概率分布公式有一点错误,分母符号的下标出现了一些问题。

恩, 看到了. 谢谢提醒. 后面修复下.

讲的很好..相知道你在哪学的..

@lfydegithub 看论文自学的

楼主q_{j|i}的表达式里面应该是y_i吧

有剃度公式具体推导过程吗