如何评价微软在数据中心使用FPGA代替传统CPU的做法?

https://www.zhihu.com/question/24174597

如何评价微软在数据中心使用FPGA代替传统CPU的做法?

微软数据中心里的服务器仍然由传统的英特尔 CPU 主宰,但根据外媒最新消息称,微软现在正计划采用现场可编程阵列或现场可编程门阵列(FPGA)来代替原有的处理器架构,让微软可以采用自主软件专门修改并为自己服务。据悉,这些 FPGA 制定电路目前已经出现在市场上,微软正在与一家名为 Altera 的公司商洽采购事宜。

据了解,这个计划的整体想法出自于微软研究院的 Doug Burger,他把该项目称为 Project Catapult。起初,Doug Burger 只是获得一项 1600 台服务器中试系统进行验证测试,现在这项计划已经正式获得批准。预计明年初将会完成部署,这意味着从现在起的几个月内,用户如果采用必应进行搜索,那么他们所获得的结果有可能会来自于全新的服务器。

据悉,本次芯片架构变更的真正优势将会体现在如下几个方面:

·FPGA 相比于 CPU 在处理 Bing 的自定义算法时快出 40 倍。

·整个系统将会比 Bing 现有的系统快出两倍。

·微软因此可以将目前已经投入使用的服务器数量减少一半。

芯片架构换血!微软数据中心系统速度将提升_Microsoft 服务器相关_cnBeta.COM

这一条新闻的可信度如何?

在数据中心中使用FPGA代替通用CPU真的能够实现报导中的效果吗?

在技术上的实现细节是怎么样的?难度在哪里?

40 个回答

李博杰中国科技大学微软亚洲研究院 博士在读 FPGA / 数据…

李博杰中国科技大学微软亚洲研究院 博士在读 FPGA / 数据…

问题「用 FPGA 代替 CPU」中,这个「代替」的说法不准确。我们并不是不用 CPU 了,而是用 FPGA 加速适合它的计算任务,其他任务仍然在 CPU 上完成,让 FPGA 和 CPU 协同工作。

本回答将涵盖三个问题:

- 为什么使用 FPGA,相比 CPU、GPU、ASIC(专用芯片)有什么特点?

- 微软的 FPGA 部署在哪里?FPGA 之间、FPGA 与 CPU 之间是如何通信的?

- 未来 FPGA 在云计算平台中应充当怎样的角色?仅仅是像 GPU 一样的计算加速卡吗?

一、为什么使用 FPGA?

众所周知,通用处理器(CPU)的摩尔定律已入暮年,而机器学习和 Web 服务的规模却在指数级增长。人们使用定制硬件来加速常见的计算任务,然而日新月异的行业又要求这些定制的硬件可被重新编程来执行新类型的计算任务。FPGA (Field Programmable Gate Array) 正是一种硬件可重构的体系结构,常年来被用作专用芯片(ASIC)的小批量替代品,然而近年来在微软、百度等公司的数据中心大规模部署,以同时提供强大的计算能力和足够的灵活性。

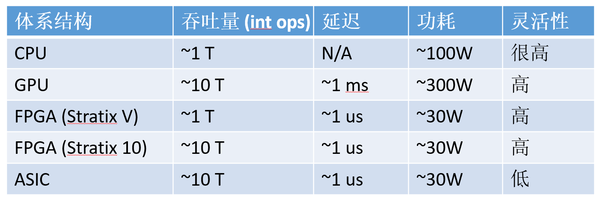

不同体系结构性能和灵活性的比较。

不同体系结构性能和灵活性的比较。

FPGA 为什么快?「都是同行衬托得好」。CPU、GPU 都属于冯·诺依曼结构,指令译码执行、共享内存。FPGA 之所以比 CPU 甚至 GPU 能效高,本质上是无指令、无需共享内存的体系结构带来的福利。

冯氏结构中,由于执行单元(如 CPU 核)可能执行任意指令,就需要有指令存储器、译码器、各种指令的运算器、分支跳转处理逻辑。由于指令流的控制逻辑复杂,不可能有太多条独立的指令流,因此 GPU 使用 SIMD(单指令流多数据流)来让多个执行单元以同样的步调处理不同的数据,CPU 也支持 SIMD 指令。而 FPGA 每个逻辑单元的功能在重编程(烧写)时就已经确定,不需要指令。

冯氏结构中使用内存有两种作用。一是保存状态,二是在执行单元间通信。由于内存是共享的,就需要做访问仲裁;为了利用访问局部性,每个执行单元有一个私有的缓存,这就要维持执行部件间缓存的一致性。对于保存状态的需求,FPGA 中的寄存器和片上内存(BRAM)是属于各自的控制逻辑的,无需不必要的仲裁和缓存。对于通信的需求,FPGA 每个逻辑单元与周围逻辑单元的连接在重编程(烧写)时就已经确定,并不需要通过共享内存来通信。

说了这么多三千英尺高度的话,FPGA 实际的表现如何呢?我们分别来看计算密集型任务和通信密集型任务。

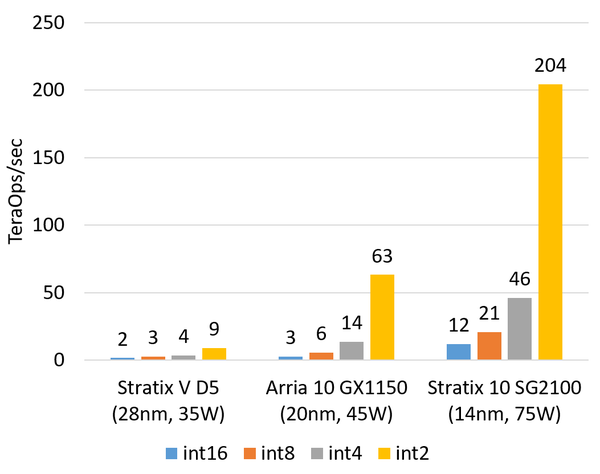

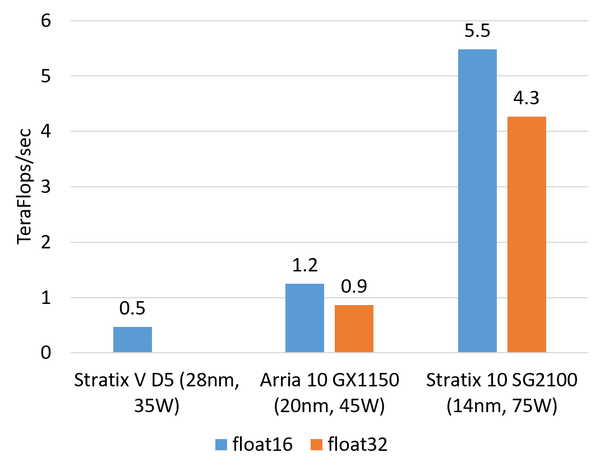

计算密集型任务的例子包括矩阵运算、图像处理、机器学习、压缩、非对称加密、Bing 搜索的排序等。这类任务一般是 CPU 把任务卸载(offload)给 FPGA 去执行。对这类任务,目前我们正在用的 Altera(似乎应该叫 Intel 了,我还是习惯叫 Altera……)Stratix V FPGA 的整数乘法运算性能与 20 核的 CPU 基本相当,浮点乘法运算性能与 8 核的 CPU 基本相当,而比 GPU 低一个数量级。我们即将用上的下一代 FPGA,Stratix 10,将配备更多的乘法器和硬件浮点运算部件,从而理论上可达到与现在的顶级 GPU 计算卡旗鼓相当的计算能力。

FPGA 的整数乘法运算能力(估计值,不使用 DSP,根据逻辑资源占用量估计)

FPGA 的整数乘法运算能力(估计值,不使用 DSP,根据逻辑资源占用量估计)

FPGA 的浮点乘法运算能力(估计值,float16 用软核,float 32 用硬核)

FPGA 的浮点乘法运算能力(估计值,float16 用软核,float 32 用硬核)

在数据中心,FPGA 相比 GPU 的核心优势在于延迟。像 Bing 搜索排序这样的任务,要尽可能快地返回搜索结果,就需要尽可能降低每一步的延迟。如果使用 GPU 来加速,要想充分利用 GPU 的计算能力,batch size 就不能太小,延迟将高达毫秒量级。使用 FPGA 来加速的话,只需要微秒级的 PCIe 延迟(我们现在的 FPGA 是作为一块 PCIe 加速卡)。未来 Intel 推出通过 QPI 连接的 Xeon + FPGA 之后,CPU 和 FPGA 之间的延迟更可以降到 100 纳秒以下,跟访问主存没什么区别了。

FPGA 为什么比 GPU 的延迟低这么多?这本质上是体系结构的区别。FPGA 同时拥有流水线并行和数据并行,而 GPU 几乎只有数据并行(流水线深度受限)。例如处理一个数据包有 10 个步骤,FPGA 可以搭建一个 10 级流水线,流水线的不同级在处理不同的数据包,每个数据包流经 10 级之后处理完成。每处理完成一个数据包,就能马上输出。而 GPU 的数据并行方法是做 10 个计算单元,每个计算单元也在处理不同的数据包,然而所有的计算单元必须按照统一的步调,做相同的事情(SIMD,Single Instruction Multiple Data)。这就要求 10 个数据包必须一起输入、一起输出,输入输出的延迟增加了。当任务是逐个而非成批到达的时候,流水线并行比数据并行可实现更低的延迟。因此对流式计算的任务,FPGA 比 GPU 天生有延迟方面的优势。

计算密集型任务,CPU、GPU、FPGA、ASIC 的数量级比较(以 16 位整数乘法为例,数字仅为数量级的估计)

计算密集型任务,CPU、GPU、FPGA、ASIC 的数量级比较(以 16 位整数乘法为例,数字仅为数量级的估计)

ASIC 专用芯片在吞吐量、延迟和功耗三方面都无可指摘,但微软并没有采用,出于两个原因:

- 数据中心的计算任务是灵活多变的,而 ASIC 研发成本高、周期长。好不容易大规模部署了一批某种神经网络的加速卡,结果另一种神经网络更火了,钱就白费了。FPGA 只需要几百毫秒就可以更新逻辑功能。FPGA 的灵活性可以保护投资,事实上,微软现在的 FPGA 玩法与最初的设想大不相同。

- 数据中心是租给不同的租户使用的,如果有的机器上有神经网络加速卡,有的机器上有 Bing 搜索加速卡,有的机器上有网络虚拟化加速卡,任务的调度和服务器的运维会很麻烦。使用 FPGA 可以保持数据中心的同构性。

接下来看通信密集型任务。相比计算密集型任务,通信密集型任务对每个输入数据的处理不甚复杂,基本上简单算算就输出了,这时通信往往会成为瓶颈。对称加密、防火墙、网络虚拟化都是通信密集型的例子。

通信密集型任务,CPU、GPU、FPGA、ASIC 的数量级比较(以 64 字节网络数据包处理为例,数字仅为数量级的估计)

通信密集型任务,CPU、GPU、FPGA、ASIC 的数量级比较(以 64 字节网络数据包处理为例,数字仅为数量级的估计)

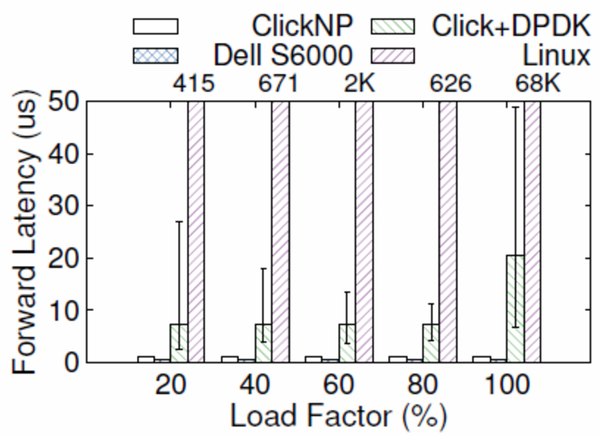

对通信密集型任务,FPGA 相比 CPU、GPU 的优势就更大了。从吞吐量上讲,FPGA 上的收发器可以直接接上 40 Gbps 甚至 100 Gbps 的网线,以线速处理任意大小的数据包;而 CPU 需要从网卡把数据包收上来才能处理,很多网卡是不能线速处理 64 字节的小数据包的。尽管可以通过插多块网卡来达到高性能,但 CPU 和主板支持的 PCIe 插槽数量往往有限,而且网卡、交换机本身也价格不菲。

从延迟上讲,网卡把数据包收到 CPU,CPU 再发给网卡,即使使用 DPDK 这样高性能的数据包处理框架,延迟也有 4~5 微秒。更严重的问题是,通用 CPU 的延迟不够稳定。例如当负载较高时,转发延迟可能升到几十微秒甚至更高(如下图所示);现代操作系统中的时钟中断和任务调度也增加了延迟的不确定性。

ClickNP(FPGA)与 Dell S6000 交换机(商用交换机芯片)、Click+DPDK(CPU)和 Linux(CPU)的转发延迟比较,error bar 表示 5% 和 95%。来源:[5]

ClickNP(FPGA)与 Dell S6000 交换机(商用交换机芯片)、Click+DPDK(CPU)和 Linux(CPU)的转发延迟比较,error bar 表示 5% 和 95%。来源:[5]

虽然 GPU 也可以高性能处理数据包,但 GPU 是没有网口的,意味着需要首先把数据包由网卡收上来,再让 GPU 去做处理。这样吞吐量受到 CPU 和/或网卡的限制。GPU 本身的延迟就更不必说了。

那么为什么不把这些网络功能做进网卡,或者使用可编程交换机呢?ASIC 的灵活性仍然是硬伤。尽管目前有越来越强大的可编程交换机芯片,比如支持 P4 语言的 Tofino,ASIC 仍然不能做复杂的有状态处理,比如某种自定义的加密算法。

综上,在数据中心里 FPGA 的主要优势是稳定又极低的延迟,适用于流式的计算密集型任务和通信密集型任务。

二、微软部署 FPGA 的实践

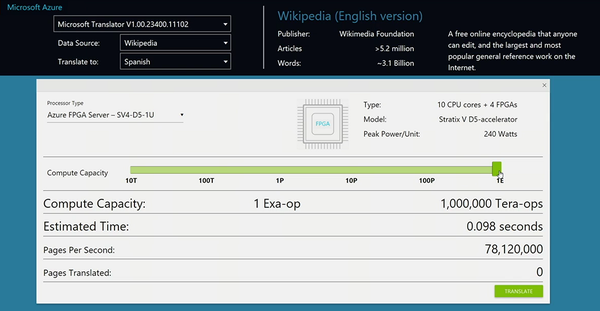

2016 年 9 月,《连线》(Wired)杂志发表了一篇《微软把未来押注在 FPGA 上》的报道 [3],讲述了 Catapult 项目的前世今生。紧接着,Catapult 项目的老大 Doug Burger 在 Ignite 2016 大会上与微软 CEO Satya Nadella 一起做了 FPGA 加速机器翻译的演示。演示的总计算能力是 103 万 T ops,也就是 1.03 Exa-op,相当于 10 万块顶级 GPU 计算卡。一块 FPGA(加上板上内存和网络接口等)的功耗大约是 30 W,仅增加了整个服务器功耗的十分之一。

Ignite 2016 上的演示:每秒 1 Exa-op (10^18) 的机器翻译运算能力

Ignite 2016 上的演示:每秒 1 Exa-op (10^18) 的机器翻译运算能力

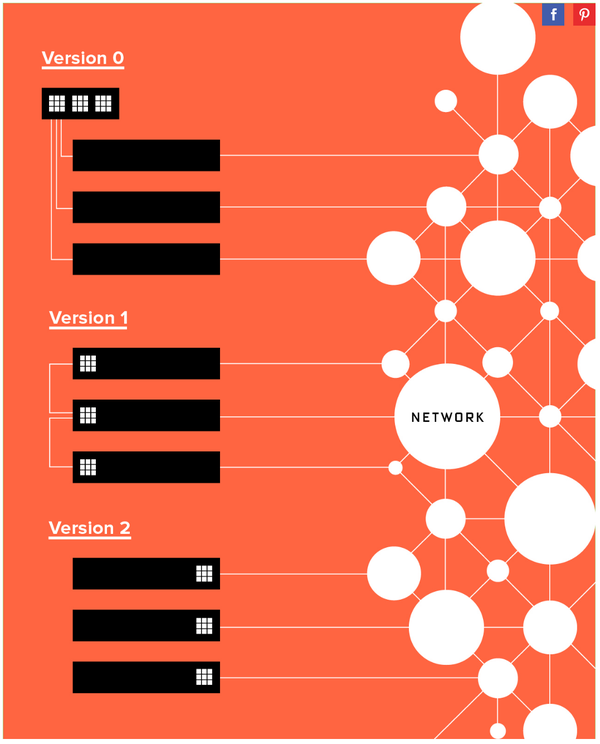

微软部署 FPGA 并不是一帆风顺的。对于把 FPGA 部署在哪里这个问题,大致经历了三个阶段:

- 专用的 FPGA 集群,里面插满了 FPGA

- 每台机器一块 FPGA,采用专用网络连接

- 每台机器一块 FPGA,放在网卡和交换机之间,共享服务器网络

微软 FPGA 部署方式的三个阶段,来源:[3]

微软 FPGA 部署方式的三个阶段,来源:[3]

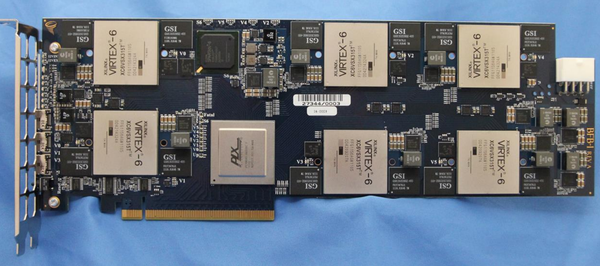

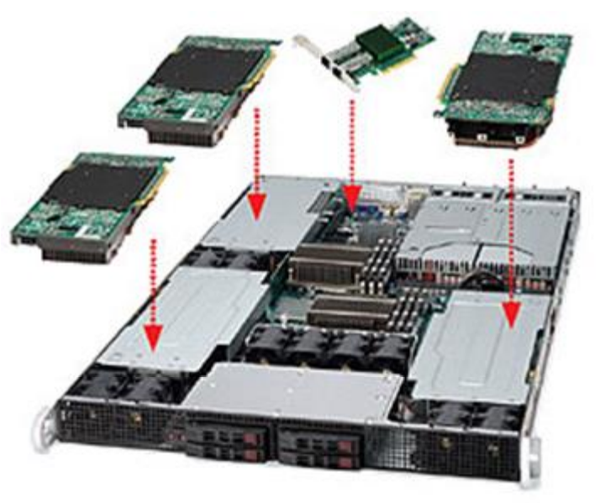

第一个阶段是专用集群,里面插满了 FPGA 加速卡,就像是一个 FPGA 组成的超级计算机。下图是最早的 BFB 实验板,一块 PCIe 卡上放了 6 块 FPGA,每台 1U 服务器上又插了 4 块 PCIe 卡。

最早的 BFB 实验板,上面放了 6 块 FPGA。来源:[1]

最早的 BFB 实验板,上面放了 6 块 FPGA。来源:[1]

可以注意到该公司的名字。在半导体行业,只要批量足够大,芯片的价格都将趋向于沙子的价格。据传闻,正是由于该公司不肯给「沙子的价格」 ,才选择了另一家公司。当然现在数据中心领域用两家公司 FPGA 的都有。只要规模足够大,对 FPGA 价格过高的担心将是不必要的。

最早的 BFB 实验板,1U 服务器上插了 4 块 FPGA 卡。来源:[1]

最早的 BFB 实验板,1U 服务器上插了 4 块 FPGA 卡。来源:[1]

像超级计算机一样的部署方式,意味着有专门的一个机柜全是上图这种装了 24 块 FPGA 的服务器(下图左)。这种方式有几个问题:

- 不同机器的 FPGA 之间无法通信,FPGA 所能处理问题的规模受限于单台服务器上 FPGA 的数量;

- 数据中心里的其他机器要把任务集中发到这个机柜,构成了 in-cast,网络延迟很难做到稳定。

- FPGA 专用机柜构成了单点故障,只要它一坏,谁都别想加速了;

- 装 FPGA 的服务器是定制的,冷却、运维都增加了麻烦。

部署 FPGA 的三种方式,从中心化到分布式。来源:[1]

部署 FPGA 的三种方式,从中心化到分布式。来源:[1]

一种不那么激进的方式是,在每个机柜一面部署一台装满 FPGA 的服务器(上图中)。这避免了上述问题 (2)(3),但 (1)(4) 仍然没有解决。

第二个阶段,为了保证数据中心中服务器的同构性(这也是不用 ASIC 的一个重要原因),在每台服务器上插一块 FPGA(上图右),FPGA 之间通过专用网络连接。这也是微软在 ISCA'14 上所发表论文采用的部署方式。

Open Compute Server 在机架中。来源:[1]

Open Compute Server 在机架中。来源:[1]

Open Compute Server 内景。红框是放 FPGA 的位置。来源:[1]

Open Compute Server 内景。红框是放 FPGA 的位置。来源:[1]

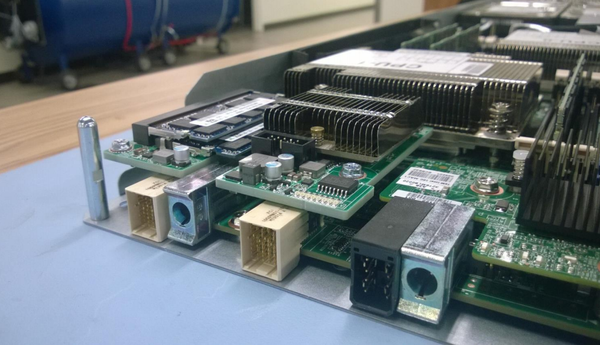

插入 FPGA 后的 Open Compute Server。来源:[1]

插入 FPGA 后的 Open Compute Server。来源:[1]

FPGA 与 Open Compute Server 之间的连接与固定。来源:[1]

FPGA 与 Open Compute Server 之间的连接与固定。来源:[1]

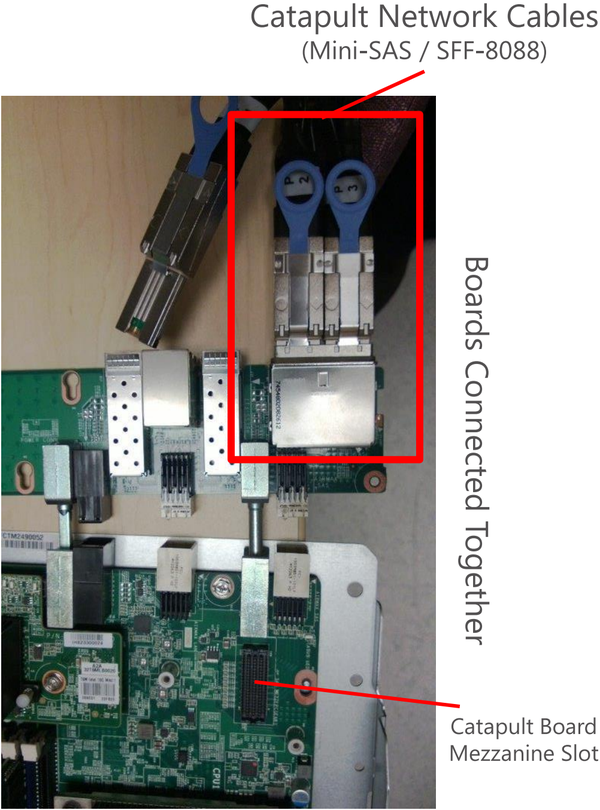

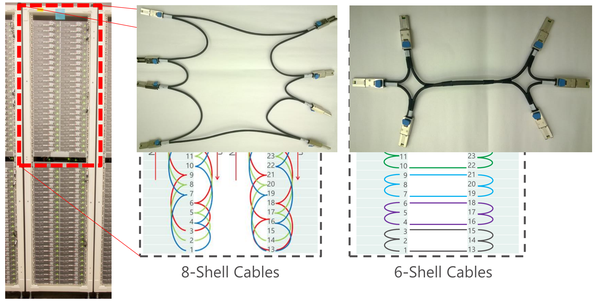

FPGA 采用 Stratix V D5,有 172K 个 ALM,2014 个 M20K 片上内存,1590 个 DSP。板上有一个 8GB DDR3-1333 内存,一个 PCIe Gen3 x8 接口,两个 10 Gbps 网络接口。一个机柜之间的 FPGA 采用专用网络连接,一组 10G 网口 8 个一组连成环,另一组 10G 网口 6 个一组连成环,不使用交换机。

机柜中 FPGA 之间的网络连接方式。来源:[1]

机柜中 FPGA 之间的网络连接方式。来源:[1]

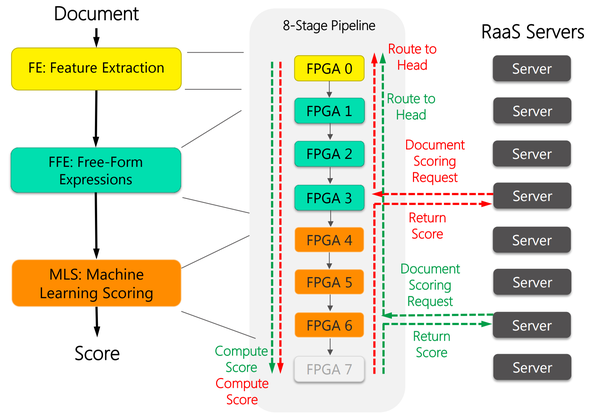

这样一个 1632 台服务器、1632 块 FPGA 的集群,把 Bing 的搜索结果排序整体性能提高到了 2 倍(换言之,节省了一半的服务器)。如下图所示,每 8 块 FPGA 穿成一条链,中间用前面提到的 10 Gbps 专用网线来通信。这 8 块 FPGA 各司其职,有的负责从文档中提取特征(黄色),有的负责计算特征表达式(绿色),有的负责计算文档的得分(红色)。

FPGA 加速 Bing 的搜索排序过程。来源:[1]

FPGA 加速 Bing 的搜索排序过程。来源:[1]

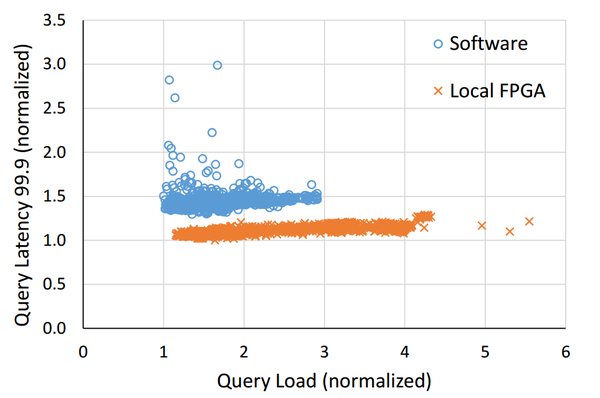

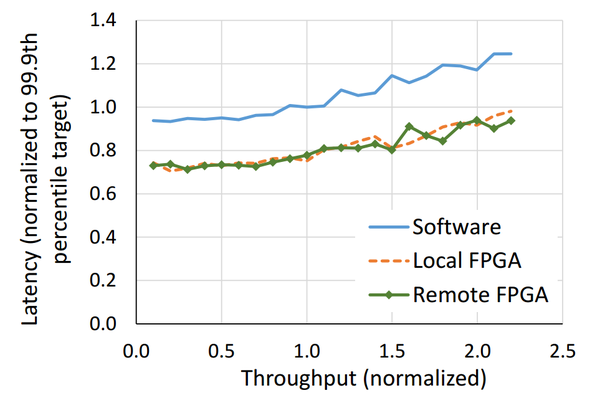

FPGA 不仅降低了 Bing 搜索的延迟,还显著提高了延迟的稳定性。来源:[4]

FPGA 不仅降低了 Bing 搜索的延迟,还显著提高了延迟的稳定性。来源:[4]

本地和远程的 FPGA 均可以降低搜索延迟,远程 FPGA 的通信延迟相比搜索延迟可忽略。来源:[4]

FPGA 在 Bing 的部署取得了成功,Catapult 项目继续在公司内扩张。微软内部拥有最多服务器的,就是云计算 Azure 部门了。Azure 部门急需解决的问题是网络和存储虚拟化带来的开销。Azure 把虚拟机卖给客户,需要给虚拟机的网络提供防火墙、负载均衡、隧道、NAT 等网络功能。由于云存储的物理存储跟计算节点是分离的,需要把数据从存储节点通过网络搬运过来,还要进行压缩和加密。

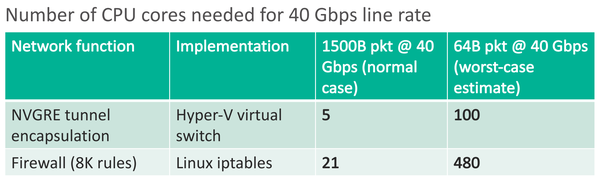

在 1 Gbps 网络和机械硬盘的时代,网络和存储虚拟化的 CPU 开销不值一提。随着网络和存储速度越来越快,网络上了 40 Gbps,一块 SSD 的吞吐量也能到 1 GB/s,CPU 渐渐变得力不从心了。例如 Hyper-V 虚拟交换机只能处理 25 Gbps 左右的流量,不能达到 40 Gbps 线速,当数据包较小时性能更差;AES-256 加密和 SHA-1 签名,每个 CPU 核只能处理 100 MB/s,只是一块 SSD 吞吐量的十分之一。

网络隧道协议、防火墙处理 40 Gbps 需要的 CPU 核数。来源:[5]

网络隧道协议、防火墙处理 40 Gbps 需要的 CPU 核数。来源:[5]

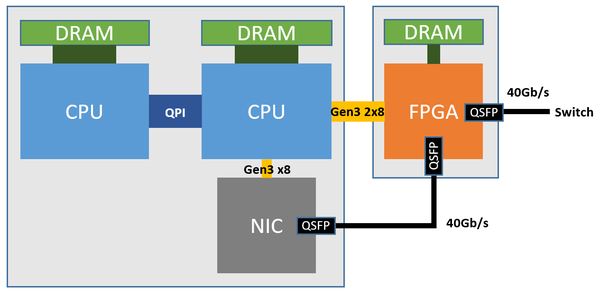

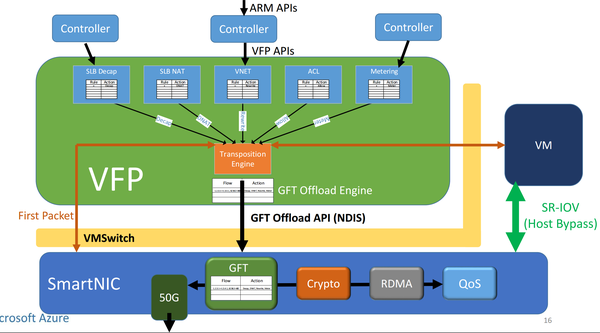

为了加速网络功能和存储虚拟化,微软把 FPGA 部署在网卡和交换机之间。如下图所示,每个 FPGA 有一个 4 GB DDR3-1333 DRAM,通过两个 PCIe Gen3 x8 接口连接到一个 CPU socket(物理上是 PCIe Gen3 x16 接口,因为 FPGA 没有 x16 的硬核,逻辑上当成两个 x8 的用)。物理网卡(NIC)就是普通的 40 Gbps 网卡,仅用于宿主机与网络之间的通信。

Azure 服务器部署 FPGA 的架构。来源:[6]

Azure 服务器部署 FPGA 的架构。来源:[6]

FPGA(SmartNIC)对每个虚拟机虚拟出一块网卡,虚拟机通过 SR-IOV 直接访问这块虚拟网卡。原本在虚拟交换机里面的数据平面功能被移到了 FPGA 里面,虚拟机收发网络数据包均不需要 CPU 参与,也不需要经过物理网卡(NIC)。这样不仅节约了可用于出售的 CPU 资源,还提高了虚拟机的网络性能(25 Gbps),把同数据中心虚拟机之间的网络延迟降低了 10 倍。

网络虚拟化的加速架构。来源:[6]

网络虚拟化的加速架构。来源:[6]

这就是微软部署 FPGA 的第三代架构,也是目前「每台服务器一块 FPGA」大规模部署所采用的架构。FPGA 复用主机网络的初心是加速网络和存储,更深远的影响则是把 FPGA 之间的网络连接扩展到了整个数据中心的规模,做成真正 cloud-scale 的「超级计算机」。第二代架构里面,FPGA 之间的网络连接局限于同一个机架以内,FPGA 之间专网互联的方式很难扩大规模,通过 CPU 来转发则开销太高。

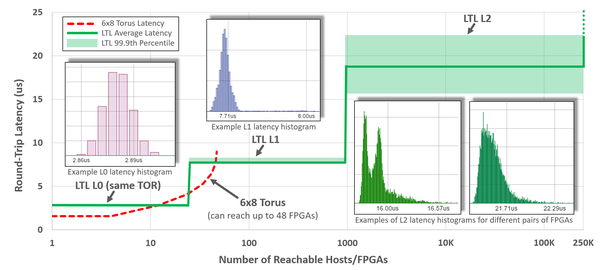

第三代架构中,FPGA 之间通过 LTL (Lightweight Transport Layer) 通信。同一机架内延迟在 3 微秒以内;8 微秒以内可达 1000 块 FPGA;20 微秒可达同一数据中心的所有 FPGA。第二代架构尽管 8 台机器以内的延迟更低,但只能通过网络访问 48 块 FPGA。为了支持大范围的 FPGA 间通信,第三代架构中的 LTL 还支持 PFC 流控协议和 DCQCN 拥塞控制协议。

纵轴:LTL 的延迟,横轴:可达的 FPGA 数量。来源:[4]

纵轴:LTL 的延迟,横轴:可达的 FPGA 数量。来源:[4]

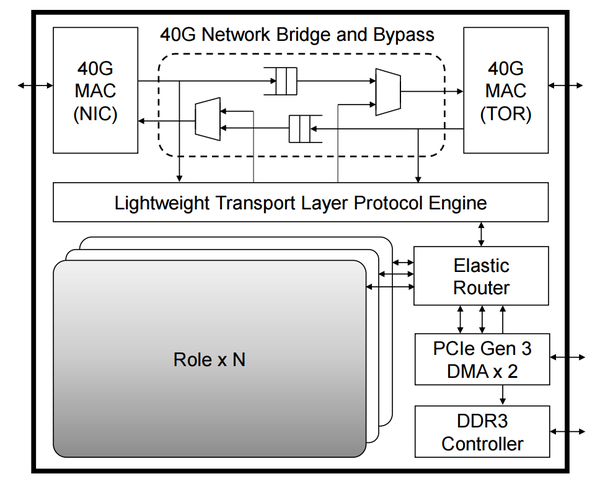

FPGA 内的逻辑模块关系,其中每个 Role 是用户逻辑(如 DNN 加速、网络功能加速、加密),外面的部分负责各个 Role 之间的通信及 Role 与外设之间的通信。来源:[4]

FPGA 内的逻辑模块关系,其中每个 Role 是用户逻辑(如 DNN 加速、网络功能加速、加密),外面的部分负责各个 Role 之间的通信及 Role 与外设之间的通信。来源:[4]

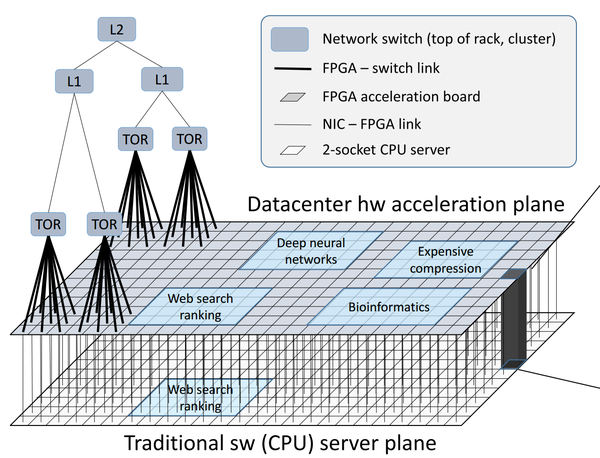

FPGA 构成的数据中心加速平面,介于网络交换层(TOR、L1、L2)和传统服务器软件(CPU 上运行的软件)之间。来源:[4]

FPGA 构成的数据中心加速平面,介于网络交换层(TOR、L1、L2)和传统服务器软件(CPU 上运行的软件)之间。来源:[4]

通过高带宽、低延迟的网络互联的 FPGA 构成了介于网络交换层和传统服务器软件之间的数据中心加速平面。除了每台提供云服务的服务器都需要的网络和存储虚拟化加速,FPGA 上的剩余资源还可以用来加速 Bing 搜索、深度神经网络(DNN)等计算任务。

对很多类型的应用,随着分布式 FPGA 加速器的规模扩大,其性能提升是超线性的。例如 CNN inference,当只用一块 FPGA 的时候,由于片上内存不足以放下整个模型,需要不断访问 DRAM 中的模型权重,性能瓶颈在 DRAM;如果 FPGA 的数量足够多,每块 FPGA 负责模型中的一层或者一层中的若干个特征,使得模型权重完全载入片上内存,就消除了 DRAM 的性能瓶颈,完全发挥出 FPGA 计算单元的性能。当然,拆得过细也会导致通信开销的增加。把任务拆分到分布式 FPGA 集群的关键在于平衡计算和通信。

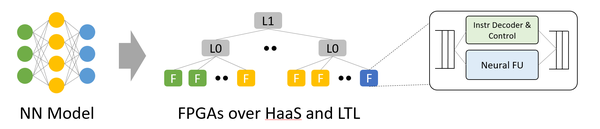

从神经网络模型到 HaaS 上的 FPGA。利用模型内的并行性,模型的不同层、不同特征映射到不同 FPGA。来源:[4]

从神经网络模型到 HaaS 上的 FPGA。利用模型内的并行性,模型的不同层、不同特征映射到不同 FPGA。来源:[4]

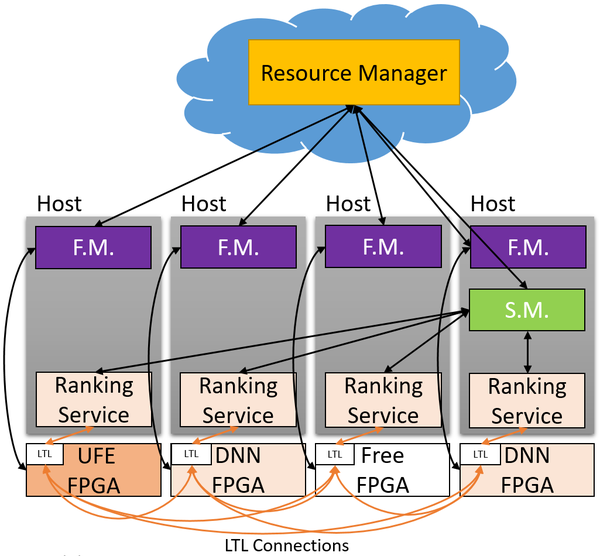

在 MICRO'16 会议上,微软提出了 Hardware as a Service (HaaS) 的概念,即把硬件作为一种可调度的云服务,使得 FPGA 服务的集中调度、管理和大规模部署成为可能。

Hardware as a Service (HaaS)。来源:[4]

Hardware as a Service (HaaS)。来源:[4]

从第一代装满 FPGA 的专用服务器集群,到第二代通过专网连接的 FPGA 加速卡集群,到目前复用数据中心网络的大规模 FPGA 云,三个思想指导我们的路线:

- 硬件和软件不是相互取代的关系,而是合作的关系;

- 必须具备灵活性,即用软件定义的能力;

- 必须具备可扩放性(scalability)。

三、FPGA 在云计算中的角色

最后谈一点我个人对 FPGA 在云计算中角色的思考。作为三年级博士生,我在微软亚洲研究院的研究试图回答两个问题:

- FPGA 在云规模的网络互连系统中应当充当怎样的角色?

- 如何高效、可扩放地对 FPGA + CPU 的异构系统进行编程?

我对 FPGA 业界主要的遗憾是,FPGA 在数据中心的主流用法,从除微软外的互联网巨头,到两大 FPGA 厂商,再到学术界,大多是把 FPGA 当作跟 GPU 一样的计算密集型任务的加速卡。然而 FPGA 真的很适合做 GPU 的事情吗?前面讲过,FPGA 和 GPU 最大的区别在于体系结构,FPGA 更适合做需要低延迟的流式处理,GPU 更适合做大批量同构数据的处理。

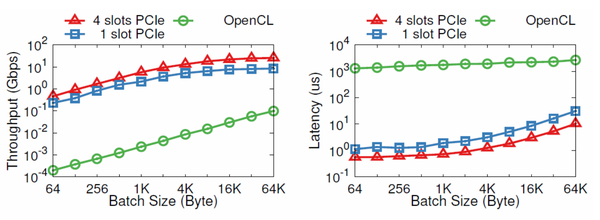

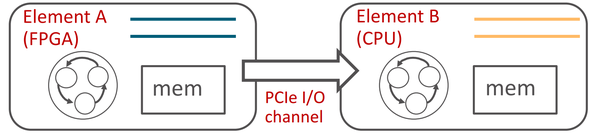

由于很多人打算把 FPGA 当作计算加速卡来用,两大 FPGA 厂商推出的高层次编程模型也是基于 OpenCL,模仿 GPU 基于共享内存的批处理模式。CPU 要交给 FPGA 做一件事,需要先放进 FPGA 板上的 DRAM,然后告诉 FPGA 开始执行,FPGA 把执行结果放回 DRAM,再通知 CPU 去取回。CPU 和 FPGA 之间本来可以通过 PCIe 高效通信,为什么要到板上的 DRAM 绕一圈?也许是工程实现的问题,我们发现通过 OpenCL 写 DRAM、启动 kernel、读 DRAM 一个来回,需要 1.8 毫秒。而通过 PCIe DMA 来通信,却只要 1~2 微秒。

PCIe I/O channel 与 OpenCL 的性能比较。纵坐标为对数坐标。来源:[5]

PCIe I/O channel 与 OpenCL 的性能比较。纵坐标为对数坐标。来源:[5]

OpenCL 里面多个 kernel 之间的通信就更夸张了,默认的方式也是通过共享内存。本文开篇就讲,FPGA 比 CPU 和 GPU 能效高,体系结构上的根本优势是无指令、无需共享内存。使用共享内存在多个 kernel 之间通信,在顺序通信(FIFO)的情况下是毫无必要的。况且 FPGA 上的 DRAM 一般比 GPU 上的 DRAM 慢很多。

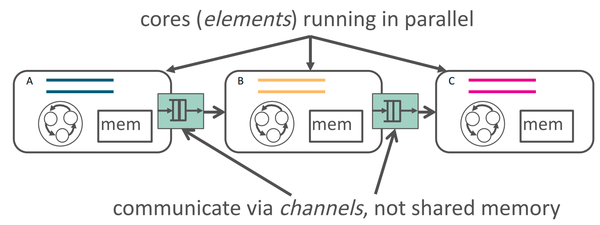

因此我们提出了 ClickNP 网络编程框架 [5],使用管道(channel)而非共享内存来在执行单元(element/kernel)间、执行单元和主机软件间进行通信。需要共享内存的应用,也可以在管道的基础上实现,毕竟 CSP(Communicating Sequential Process)和共享内存理论上是等价的嘛。ClickNP 目前还是在 OpenCL 基础上的一个框架,受到 C 语言描述硬件的局限性(当然 HLS 比 Verilog 的开发效率确实高多了)。理想的硬件描述语言,大概不会是 C 语言吧。

ClickNP 使用 channel 在 elements 间通信,来源:[5]

ClickNP 使用 channel 在 elements 间通信,来源:[5]

ClickNP 使用 channel 在 FPGA 和 CPU 间通信,来源:[5]

ClickNP 使用 channel 在 FPGA 和 CPU 间通信,来源:[5]

低延迟的流式处理,需要最多的地方就是通信。然而 CPU 由于并行性的限制和操作系统的调度,做通信效率不高,延迟也不稳定。此外,通信就必然涉及到调度和仲裁,CPU 由于单核性能的局限和核间通信的低效,调度、仲裁性能受限,硬件则很适合做这种重复工作。因此我的博士研究把 FPGA 定义为通信的「大管家」,不管是服务器跟服务器之间的通信,虚拟机跟虚拟机之间的通信,进程跟进程之间的通信,CPU 跟存储设备之间的通信,都可以用 FPGA 来加速。

成也萧何,败也萧何。缺少指令同时是 FPGA 的优势和软肋。每做一点不同的事情,就要占用一定的 FPGA 逻辑资源。如果要做的事情复杂、重复性不强,就会占用大量的逻辑资源,其中的大部分处于闲置状态。这时就不如用冯·诺依曼结构的处理器。数据中心里的很多任务有很强的局部性和重复性:一部分是虚拟化平台需要做的网络和存储,这些都属于通信;另一部分是客户计算任务里的,比如机器学习、加密解密。我们首先把 FPGA 用于它最擅长的通信,日后也许也会像 AWS 那样把 FPGA 作为计算加速卡租给客户。

不管通信还是机器学习、加密解密,算法都是很复杂的,如果试图用 FPGA 完全取代 CPU,势必会带来 FPGA 逻辑资源极大的浪费,也会提高 FPGA 程序的开发成本。更实用的做法是 FPGA 和 CPU 协同工作,局部性和重复性强的归 FPGA,复杂的归 CPU。

当我们用 FPGA 加速了 Bing 搜索、深度学习等越来越多的服务;当网络虚拟化、存储虚拟化等基础组件的数据平面被 FPGA 把持;当 FPGA 组成的「数据中心加速平面」成为网络和服务器之间的天堑……似乎有种感觉,FPGA 将掌控全局,CPU 上的计算任务反而变得碎片化,受 FPGA 的驱使。以往我们是 CPU 为主,把重复的计算任务卸载(offload)到 FPGA 上;以后会不会变成 FPGA 为主,把复杂的计算任务卸载到 CPU 上呢?随着 Xeon + FPGA 的问世,古老的 SoC 会不会在数据中心焕发新生?

「跨越内存墙,走向可编程世界」(Across the memory wall and reach a fully programmable world.)

参考文献:

[1] Large-Scale Reconfigurable Computing in a Microsoft Datacenter https://www.microsoft.com/en-us/research/wp-content/uploads/2014/06/HC26.12.520-Recon-Fabric-Pulnam-Microsoft-Catapult.pdf

[2] A Reconfigurable Fabric for Accelerating Large-Scale Datacenter Services, ISCA'14 https://www.microsoft.com/en-us/research/wp-content/uploads/2016/02/Catapult_ISCA_2014.pdf

[3] Microsoft Has a Whole New Kind of Computer Chip—and It’ll Change Everything

[4] A Cloud-Scale Acceleration Architecture, MICRO'16 https://www.microsoft.com/en-us/research/wp-content/uploads/2016/10/Cloud-Scale-Acceleration-Architecture.pdf

[5] ClickNP: Highly Flexible and High-performance Network Processing with Reconfigurable Hardware - Microsoft Research

[6] Daniel Firestone, SmartNIC: Accelerating Azure's Network with. FPGAs on OCS servers.

收藏 • 没有帮助 • 举报 • 作者保留权利

胡雨松 Signal processing, feature extraction

胡雨松 Signal processing, feature extraction

这条新闻是真的。这个项目已经做出来了,并且这篇论文将会出现在2014年的ISCA上。ISCA是计算机架构领域的顶级会议。文章题目叫 “A Reconfigurable Fabric for Accelerating Large-Scale Datacenter Services”。现在ISCA还没开,所以论文在ACM上搜不到,过几周应该能搜到了。

通常情况下,用FPGA实现的算法速度可以比CPU快100倍。所以文章里说FPGA处理Bing算法的速度比CPU快40倍也是可信的。最后整个系统级的性能是:在保持latency不变的情况下,吞吐量增加了一倍,在保持吞吐量不变的情况下,latency减小了。整个系统的功耗没有明显增加。

技术难度在于软件硬件接口的设计和整合。FPGA的开发代价是远高于CPU的,所以架构要有一定的灵活,要可以和软件系统简单可靠地接合。另一个难点是系统的可靠性。1600多块FPGA链接在一起,是很容易出现错误(errors, failing hardware, reboots, software updating)。所以如何及时探测错误,如何处理错误,如何保持整个系统的稳定性需要做很多的工作。

算法改造并不是难点。因为考虑到和现有系统的匹配,他们完完全全就是照搬的Bing的软件算法(完全没有一点改动)。

这个工作算是把FPGA应用在数据中心的一个尝试。不只是微软,Amazon,google也参与了这个工作。我相信未来FPGA一定会应用在数据中心。不过现在来看FPGA的开发难度还是太高了点。希望High level synthesize能够让FPGA的开发简化。

收藏 • 没有帮助 • 举报 • 作者保留权利

JonsonXP 可重编程架构研究,FPGA,CAD开发

JonsonXP 可重编程架构研究,FPGA,CAD开发

可信度没问题,微软一直有一支reconfigrable computing部门,发过不少好文章。去年葡萄牙的FPL2013会议(FPGA领域顶级会议)上keynote4,微软的人做了题为“Reconfigurable Hardware at the World’s Largest Software Company

”的报告。不过可能出于保密当时没有过多介绍有价值的信息。反而keynote3,来自Google的“Accelerating the datacenter”提供了一些思路。

具体架构我们目前不得而知,还等他们自己出来说明(会在9月慕尼黑的FPL2014公布?),但根据FPGA应用最近动向和新闻里的措辞,很有可能是完全不同于目前通用计算的可重编程架构。最近同样醒目的一则新闻是HP的The Machine项目,同样声称大幅改进了计算机架构。

请大家也持续关注FPGA新技术动向,及时分享讨论。

-6月18日更新-------------------------

参考上面 @胡雨松 老师的回答赶紧找来论文拜读,更新一下理解。

・ 该系统名为 Capapult。

・ 40倍?其实是单纯比较某种算法在FPGA和CPU上实现时,FPGA比CPU快40倍。论文中阐述的系统,FPGA只分担了一部分Bing的Ranking任务,加上额外性能开销,最终结果是达到了95%的性能提升。依然是个非常可观的数字。

・ 硬件架构:自制FPGA板(Stratix V D5 FPGA, 8G ECC DRAM),通过PCIe插到现有服务器, 而各个服务器的FPGA间又通过10G/b SAS线连接。总共部署了1,632台FPGA加速的服务器。

・其他:具有完善的容错系统。为了更快地和CPU交互,自行开发了带DMA的PCIe接口,支持多线程操作。FPGA内部逻辑由名为shell和role两个模块组成,shell为接口等的固定模块(占23%),role为实现用户逻辑的区域。

收藏 • 没有帮助 • 举报 • 作者保留权利

龚黎明芯片(集成电路)、中央处理器 (CPU)话题优秀回答者

龚黎明芯片(集成电路)、中央处理器 (CPU)话题优秀回答者

收藏 • 没有帮助 • 举报 • 作者保留权利

赵翔 风投从业者,气质逗比,心地善良,脸硕大…

赵翔 风投从业者,气质逗比,心地善良,脸硕大…

在数据中心中使用FPGA代替通用CPU真的能够实现报导中的效果吗?

--自2003年,Virtex-II Pro的年代,FPGA厂商就一直在考虑将FPGA置于逻辑时序控制之外的领域,从数字信号处理,网络,数据中心,FPGA在逻辑控制之外的能力已经充分得到验证。对于新闻的事实其实我并不清楚,但是从过去的情况来看,至少牛吹的没有那么多。

在技术上的实现细节是怎么样的?难度在哪里?

--举个简单的例子,一段运算在CPU层面需要做的事情是用“编程”的方式来将运算本身翻译为CPU结构可以处理的指令序列,然后一一处理。此时,提高运算能力最简单的方式就是提升CPU的频率或数量(当然,事实上的情况要复杂的多)。

而从FPGA角度来看,一段运算则可以通过模块的堆叠,级联来实现针对算法优化过的硬件结构,在面积足够的情况下,运算任务可以如同流水线一样通过硬件结构得出运算结果。

以乘加运算为例,CPU层面的工作是将乘加运算变成“x乘y,得出z,缓存z,z加a,缓存a”之类的流程。FPGA层面的工作是将合适的乘法器和加法器级联起来,设计数据接口。

所以细节上来看,新闻里描述的工作主要是分析需要处理的运算特点,设计适合运算特点的硬件结构。不清楚搜索的运算特点,但是只要是具有大量可重复运算的算法,FPGA实现起来效率都是比较高的。

这个任务真正的难度,在我看来是市场上广泛缺乏对于硬件最够了解的算法人员,也缺乏对算法足够了解的硬件设计人员。与这点相比,FPGA实现上的性能、功耗等等要求都显得容易多了。

如果多说一些的话,FPGA之所以适合做高性能计算,有几个层面的原因。第一个层面,面对部分特殊的任务,大量相对低速并行的单元比起少量高效单元而言效率更高。第二个层面,FPGA可以通过硬件结构的改变来适应算法的要求。第三个层面,这种改变是可以在运行过程中进行的。

其实我知道一点都没说清楚,这是囿于自身知识能力和表达能力限制的。如果大家希望了解更多可以私信,我介绍一些原来的同事给大家,离开他们的时候他们跟我一样是菜鸟,现在我还是菜鸟而他们已经成为业内专家了。

收藏 • 没有帮助 • 举报 • 作者保留权利

欧阳 FPGA,学生

欧阳 FPGA,学生

在数据中心中使用FPGA代替通用CPU真的能够实现报导中的效果吗?

“微软现在正计划采用现场可编程阵列或现场可编程门阵列(FPGA)来代替原有的处理器架构,让微软可以采用自主软件专门修改并为自己服务。”这句话比较笼统,系统中的CPU完全被FPGA代替?还是用FPGA来做固定算法计算,减少CPU的使用?前一种那是FPGA计算机了,系统架构就完全不一样了。不过这种可能应该比较小,这条路很长。后一种的话,就是异构计算的一种了,用FPGA做算法加速,40倍的加速是合理的。

其实这里有意思的是“采用自主软件专门修改并为自己服务”,芯片厂商都有EDK,微软为什么自己做了个开发软件?如果不是唬人的话,这里面有可能意味微软研发了一套基于FPGA适用于WINDOWS下异构计算的开发流程。

这里想要说清楚,就要提到常用的异构计算方式以及其异同了。DSP、GPGPU、FPGA应该是常见异构计算方式,还有一种是重核。

常见的三种,单说计算性能,FPGA完爆剩下两种。FPGA比GPGPU的功耗也不是一个级别的。但是其实用的最多的是GPGPU。上面有答案说,FPGA贵,我觉得不是,高端GPGPU比高端FPGA并不便宜多少,而且耗电量高。限制FPGA使用的其实是开发成本,FPGA经常用在asic的前期验证上,因为FPGA验证比流片验证低,而且前端设计是一样的。但是相对于GPGPU来说,FPGA设计周期要长的的多,而且难度要大。相对于软件来说,FPGA调试也是相当困难。所以说限制FPGA使用的不是价格,用在需要和适合地方,硬件成本不算什么。一个团队早几个月完工,工资还能省一大笔呢。

如果微软的那个“自主软件”能降低开发难度和周期,那才是真正能推动FPGA发展,还有这个项目的意义所在。

说偏了,不说了........

在技术上的实现细节是怎么样的?难度在哪里?

这个就没法说了,看这个新闻看不出来微软做了什么,也就没法谈细节和难度了。

收藏 • 没有帮助 • 举报 • 作者保留权利

林名 7年了,是不是该告别

林名 7年了,是不是该告别

不是产业级的,一次性买卖。估计altera也不是很感兴趣,只是借机提一下股价罢了。

实现细节在于自定义算法内容。如果这个算法相对稳定了 ,就可以用fpga实现,一方面加快运行速度,另一方面提高单机负载量。就是常说的硬件加速。

实现效果看算法硬件化改造的水平。

我觉得最大的难点在于算法改造以及任务调度。但我没接触分布式计算,并行计算的领域,对微软而言,这个应该也不是什么难点。这就是个工作量的问题罢了。

收藏 • 没有帮助 • 举报 • 作者保留权利

快醒了 趁年轻,冲一把。

快醒了 趁年轻,冲一把。

楼上的都是大神级别的答案,小弟就在这班门弄斧了,说下自己的看法。0.0

1.原理,客观上来讲用FPGA代替传统的CPU来进行服务器的数据处理,肯定可以让效率提高,毕竟并行的机制在那里。

2.实现问题,这个问题关键算法的实现。现在主流的服务器算法应该都是基于CPU设计的(这个我没调查过),想要把串行的算法进行逻辑转化为并行的算法,这个工作量非常大,而且周期长。应该不能在短时间内完成。

3.商业需求,引用下 @林名 大神的一段话:

这个技术上不算什么新闻吧,印象中google 什么的服务器就是用xilinx fpga搭的,以提高固定算法的执行速度。服务器端而已,数量不是很大,没有流片的必要,所以就用fpga咯。

从这里可以看出。商业需求不是很大。商家是不会做赔本的买卖呢,他才不管是否技术革新。

结论:我个人认为这个东西属于学术界,而非工业界,可以申请下专利。短期内无法实现。

收藏 • 没有帮助 • 举报 • 作者保留权利

知乎用户 我是机器鼓励师

知乎用户 我是机器鼓励师

CPU是通用的,冯诺依曼计算架构要把过程变成一条一条指令串行执行,靠很高很高的主频来提高执行速度。这样一来,功耗很高(功耗主要跟主频有关),效率有限。

FPGA可以定制你想要的功能,比如说可并行的东西全部单独做成模块,一个周期就全算出来了,这样就把功耗降下去了效率提上来了。

FPGA做服务器芯片是早几年就有的事,中国的高校都有老师接这种项目。服务器端有很多功能是成熟稳定的,把它们做成芯片,电费和散热费都减掉不少。毕竟CPU要靠堆数量堆电费来满足计算需求,FPGA定制虽然单个成本高,总体成本对比就是优势,时间越长越省钱(电费)。

前两年高端号称要做神经网络芯片,目标市场第一个就是服务器端。原因就是这样,省钱还提高效率。不过后来没消息了……

收藏 • 没有帮助 • 举报 • 作者保留权利

李创 硬件产品

李创 硬件产品

主频高又如何,FPGA现在的运算器可是能到4位数的。

如何评价微软在数据中心使用FPGA代替传统CPU的做法?相关推荐

- 微软水下数据中心“浮出水面”、GitHub代码保存在北极,数据黑科技贮藏方式大曝光!...

整理 | 郑丽媛 出品 | CSDN(ID:CSDNnews) 头图 | CSDN下载自东方IC 近日,微软将两年前沉入海底的数据中心从海床上捞了回来,研究人员对其进行了评估,得出的第一个结论就是:水 ...

- FPGA较传统CPU强在哪里?

微软数据中心里的服务器仍然由传统的英特尔 CPU 主宰,但据报道,微软现在正计划采用现场可编程阵列或现场可编程门阵列(FPGA)来代替原有的处理器架构,让微软可以采用自主软件专门修改并为自己服务. 一 ...

- 微软一个数据中心有多少服务器,微软晒Windows数据中心级机器 一共拥有多达896个物理核心和1792个逻辑核心...

描述 微软近日发表了一篇介绍Windows系统内核的博文,期间为了展示Windows的强大扩展性,放出了一张非常震撼的Windows任务管理器截图: 乍一看似乎没啥特别的,几十甚至上百个逻辑核心的系统 ...

- 微软海底服务器外壳材料,你知道么?微软把数据中心扔海底了!

2018年10月24日-27日,2018微软技术暨生态大会(Microsoft Tech Summit)在上海世博中心举行.在会上,微软全球研究院首席项目经理Ben Cutlur在会上进行了主题演讲, ...

- 如何评价微软在其数据中心大量部署FPGA?

[转] http://www.leiphone.com/news/201701/3KdGt84qyrnnykBK.html 导语:为什么使用 FPGA,相比 CPU.GPU.ASIC(专用芯片)有什么 ...

- 为什么FPGA主频比CPU慢,却可以帮其加速?

为什么FPGA主频比CPU慢,却可以帮其加速? 我们知道,FPGA的频率一般只有几百MHz,而CPU的频率却高达数GHz.那么,有不少网友心中就有一个疑问:"为什么FPGA主频比CPU慢,但 ...

- 微软服务器数据降温,降温新招!微软要把数据中心建在海里

中国IDC圈2月3日报道,微软目前开发了纳蒂克数据中心项目(Project Natick),该项目取代传统的数据中心降温方式,直接将数据中心浸入海水中以降温. 一般来说,运营数据中心花费主要是在降温方 ...

- Azure 中国四年扩容 12 倍还不够,微软放话:全球每年新建 50-100 数据中心!

作者 | 伍杏玲 出品 | AI科技大本营(ID:rgznai100) 数据已渗透到我们生活和工作的方方面面,如今全球正处于经济发展转型与变革的关键时期,数据作为数字经济的核心生产要素,无疑建设先进的 ...

- 揭秘微软全球最大数据中心

微软芝加哥数据中心最近开张了.在一期工程中,第一层最多可容纳56个集装箱,每个集装箱可存放1800至2500服务器. 假以时日,微软计划在芝加哥数据中心投资5亿美元,但这只是现存和已经计划的多个数据中 ...

- 微软如何在3年内将数据中心的用水量削减95%

Microsoft 微软数据中心冷通道内的视图 微软表示,到2024年,它将把数据中心的用水量减少95%,因为微软将改进其庞大的云基础设施的设计和运营方式. 该公司计划在更高的温度下运行其数据中心,使 ...

最新文章

- 中国“5G+工业互联网”发展报告

- 解决首次运行WebDriverAgent手机开发者未信任问题

- 记录:C#编程中的字符串

- 【Scratch】青少年蓝桥杯_每日一题_3.07_画金字塔

- UWA DAY 2018 精彩议题全曝光!

- P4619 [SDOI2018]旧试题

- 很口语blood-aholic

- 5u以太网用交换机连接电脑_干货丨如何用自己的电脑直接连接NUS打印机

- 配置使用rsyslog+loganalyzer收集防火墙及交换机日志

- (转)《精通比特币》原码分析: pow机制

- app抓包工具_安卓APP逆向入门分析——破解某APP登陆请求参数

- mysql源代码_MySQL源代码解读(一)

- 《大秦帝国》第四部,阵容太强大

- 2021年支付宝发大红包啦!人人有份,天天可领!领到直接当现金用!

- 小米杀不死的消息推送-- Android、java后端同时接入小米推送

- Qt利用openGL绘制三棱锥

- iPhone手机查找朋友怎么用?添加对方号码,瞬间变成追踪器

- 现代操作系统(1.引论)

- 全百科搜索采集器 可采集百度搜索网址/贴吧/哔哩哔哩/微博信息

- Js ==(相等) 和 === (全等)

热门文章

- ”左行右立“折寿探秘

- 网站卡死服务器2008,winserver2008r2频繁卡死?

- sklearn.neighbors.KNeighborsClassifier()函数解析(最清晰的解释)

- 微软的teredo服务器,深度完美W10系统通过teredo连接IPv6的方法

- Android 架构组件之 Room

- 0基础快速入门CSS技术栈(1)—图解详细阐述初识CSS(附详细案例源码解析过程)

- emcc生成wasm,wast,bc文件的方法

- 极客也可以很亲民,酷炫设计、多变造型的华为智能眼镜即将发布

- 以编程会安全,以安全辅未来——2017看雪安全开发者峰会 强势来袭!

- excel中图片链接利用宏VB转换为图片展示