hadoop2.2完全分布式最新高可靠安装文档

1.如何配置各个节点之间无密码互通?

2.启动hadoop,看不到进程的原因是什么?

3.配置hadoop的步骤是什么?

4.有哪些配置文件需要修改?

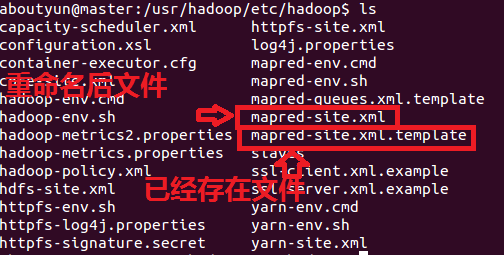

5.如果没有配置文件,该如何找到该配置文件?

6.环境变量配置了,但是不生效的原因是什么?

7.如何查看hadoop2监控页面

- sudo chown -R aboutyun:aboutyun mv.sh

复制代码

解释一下上面命令的含义:

sudo是linux系统管理指令,是允许系统管理员让普通用户执行一些或者全部的root命令的一个工具,如halt,reboot,su等等。这样不仅减少了root用户的登录 和管理时间,同样也提高了安全性。sudo不是对shell的一个代替,它是面向每个命令的。

2.chown-》change own的意思。即改变所属文件。对于他不了解的同学,可以查看:让你真正了解chmod和chown命令的用法

- tar zxvf hadoop-2.2.0_x64.tar.gz

复制代码

这里是解压到当前路径。

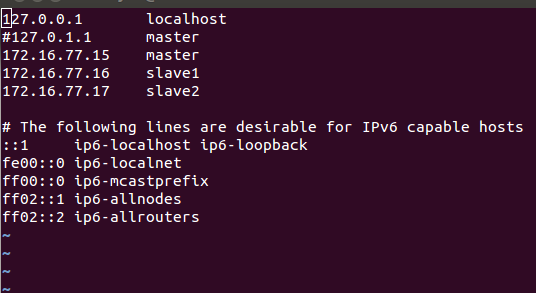

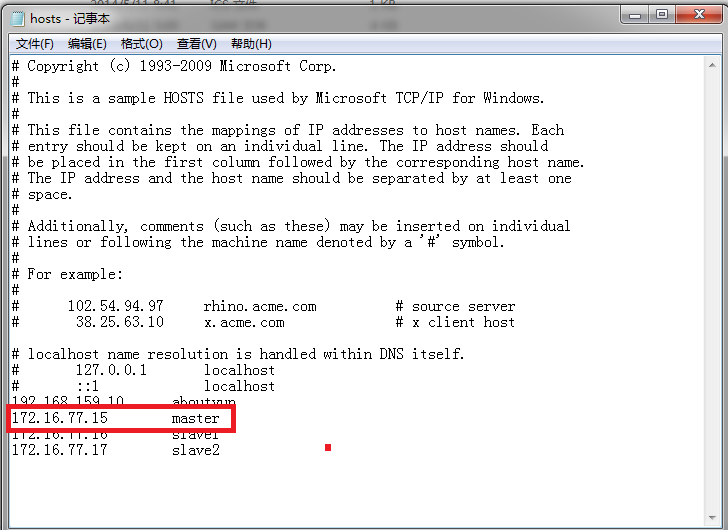

- vi /etc/hosts

复制代码

然后对你里面的内容修改:

- vi /etc/hostname

复制代码

修改为master即可

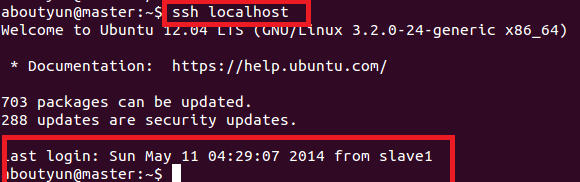

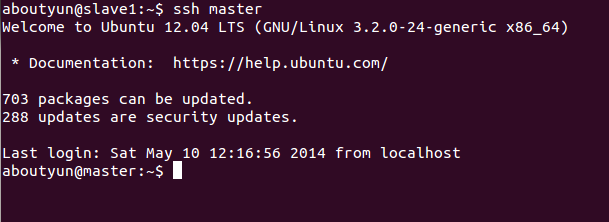

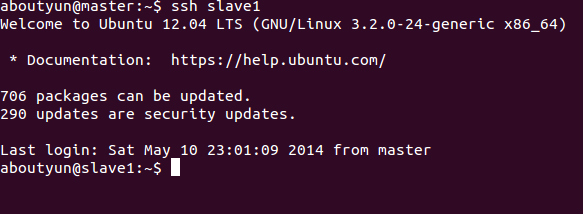

- ssh localhost

复制代码

就可以无密码登录了。

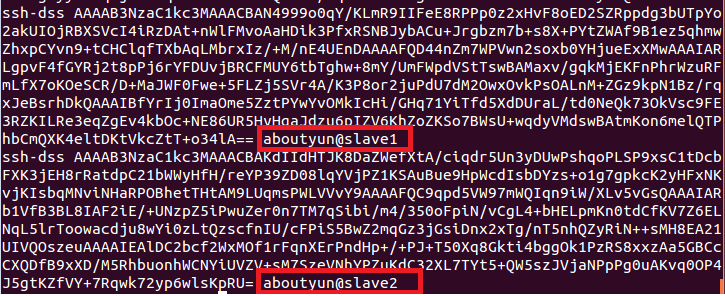

就是把工钥放到里面,然后本台机器就可以ssh无密码登录了。如果想彼此无密码登录,那么就需要把彼此的工钥(*.pub)放到authorized_keys里面

这里提供一个简单的方法:

通过下面命令

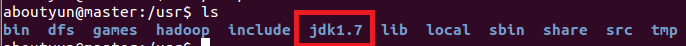

1.export PATH=$PATH:/usr/java/jdk1.7.0_51/bin

通过cat命令,可以查看

2.为了保证生效执行下面命令

- source /etc/environment

复制代码

二、CLASSTH配置

上面只是配置了PATH,还需在配置CLASSTH

export CLASSPATH=.:/usr/java/jdk1.7.0_51/jre/lib

执行配置完毕

如果不起作用,采用通过下面配置:

java.sh配置

因为重启之后,很有会被还原,下面还需要配置java.sh

这里可以通过

cd /etc/profile.d

vi java.sh

把下面两行放到java.sh

export PATH=$PATH:/usr/java/jdk1.7.0_51/bin

export CLASSPATH=.:/usr/java/jdk1.7.0_51/jre/lib

保存。这样就配置完毕了。

- source java.sh

复制代码

一、需要注意的问题

- <property>

- <name>hadoop.tmp.dir</name>

- <value>file:/home/aboutyun/tmp</value>

- <description>Abase forother temporary directories.</description>

- </property>

复制代码

说一下上面参数的含义,这里是hadoop的临时文件目录,file的含义是使用本地目录。也就是使用的是Linux的目录,一定确保下面目录

- /home/aboutyun/tmp

复制代码

的权限所属为你创建的用户。并且这里面我也要会变通,aboutyun,为我创建的用户名,如果你创建了zhangsan或则lisi,那么这个目录就会变为

- /home/zhangsan/tmp

复制代码

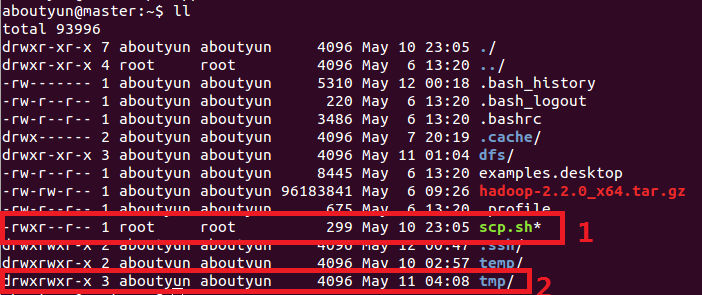

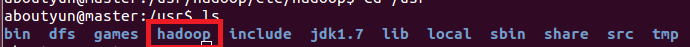

这里不熟悉,是因为对Linux的不熟悉的原因。这里在来张图:

hdfs-site.xml

上面讲完,我们开始配置

- tar zxvf hadoop-2.2.0_x64.tar.gz

复制代码

- mv hadoop-2.2.0 hadoop

复制代码

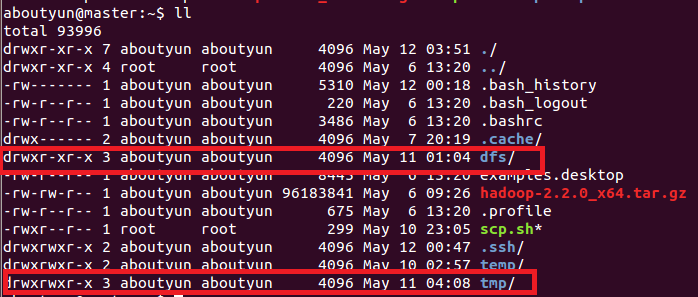

解压到/usr路径下

这里文件权限:创建完毕,你会看到红线部分,注意所属用户及用户组。如果不再新建的用户组下面,可以使用下面命令来修改: 让你真正了解chmod和chown命令的用法

- <configuration>

- <property>

- <name>fs.defaultFS</name>

- <value>hdfs://master:8020</value>

- </property>

- <property>

- <name>io.file.buffer.size</name>

- <value>131072</value>

- </property>

- <property>

- <name>hadoop.tmp.dir</name>

- <value>file:/home/aboutyun/tmp</value>

- <description>Abase for other temporary directories.</description>

- </property>

- <property>

- <name>hadoop.proxyuser.aboutyun.hosts</name>

- <value>*</value>

- </property>

- <property>

- <name>hadoop.proxyuser.aboutyun.groups</name>

- <value>*</value>

- </property>

- </configuration>

复制代码

- <configuration>

- <property>

- <name>dfs.namenode.secondary.http-address</name>

- <value>master:9001</value>

- </property>

- <property>

- <name>dfs.namenode.name.dir</name>

- <value>file:/home/aboutyun/dfs/name</value>

- </property>

- <property>

- <name>dfs.datanode.data.dir</name>

- <value>file:/home/aboutyun/dfs/data</value>

- </property>

- <property>

- <name>dfs.replication</name>

- <value>3</value>

- </property>

- <property>

- <name>dfs.webhdfs.enabled</name>

- <value>true</value>

- </property>

- </configuration>

复制代码

- <configuration>

- <property> <name>mapreduce.framework.name</name>

- <value>yarn</value>

- </property>

- <property>

- <name>mapreduce.jobhistory.address</name>

- <value>master:10020</value>

- </property>

- <property>

- <name>mapreduce.jobhistory.webapp.address</name>

- <value>master:19888</value>

- </property>

- </configuration>

复制代码

- <configuration>

- <property>

- <name>yarn.nodemanager.aux-services</name>

- <value>mapreduce_shuffle</value>

- </property>

- <property>

- <name>yarn.nodemanager.aux-services.mapreduce.shuffle.class</name>

- <value>org.apache.hadoop.mapred.ShuffleHandler</value>

- </property>

- <property>

- <name>yarn.resourcemanager.address</name>

- <value>master:8032</value>

- </property>

- <property>

- <name>yarn.resourcemanager.scheduler.address</name>

- <value>master:8030</value>

- </property>

- <property>

- <name>yarn.resourcemanager.resource-tracker.address</name>

- <value>master:8031</value>

- </property>

- <property>

- <name>yarn.resourcemanager.admin.address</name>

- <value>master:8033</value>

- </property>

- <property>

- <name>yarn.resourcemanager.webapp.address</name>

- <value>master:8088</value>

- </property>

- </configuration>

复制代码

- sudo scp -r /usr/hadoop aboutyun@slave1:~/

复制代码

这里记得先复制到home/aboutyun下面,然后在转移到/usr下面。

一、节点之间传递数据:

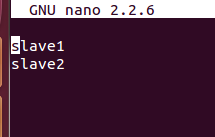

第一步:vi scp.sh

第二步:把下面内容放到里面(记得修改下面红字部分,改成自己的)

#!/bin/bash#slave1

scp /usr/hadoop/etc/hadoop/core-site.xml aboutyun@slave1:~/

scp /usr/hadoop/etc/hadoop/hdfs-site.xml aboutyun@slave1:~/

#slave2

scp /usr/hadoop/etc/hadoop/core-site.xml aboutyun@slave2:~/

scp /usr/hadoop/etc/hadoop/hdfs-site.xml aboutyun@slave2:~/

第三步:保存scp.sh

第四步:bash scp.sh执行

二、移动文件夹:

可以自己写了。

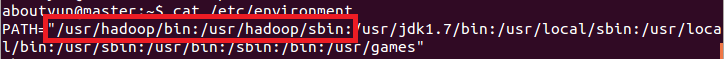

- vi /etc/environment

复制代码

第二步:添加如下内容:记得如果你的路径改变了,你也许需要做相应的改变。

- hdfs namenode –format

复制代码

或则使用下面命令:

- hadoop namenode format

复制代码

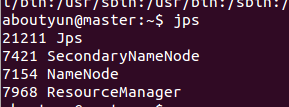

- start-dfs.sh

复制代码

namenode

secondarynamenode

- start-yarn.sh

复制代码

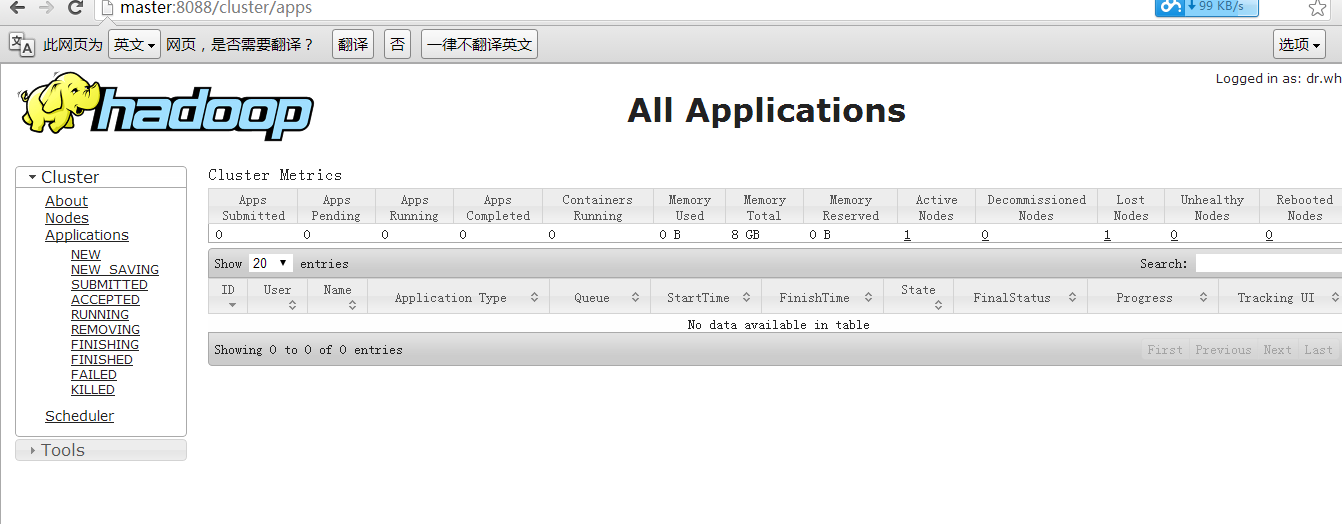

我们看到如下效果:

slave1有如下进程

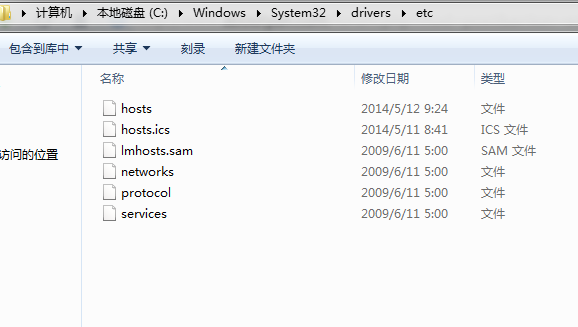

然后我们输入:(这里有的同学没有配置hosts,所以输出master访问不到,如果访问不到输入ip地址即可)

- http://master:8088/

复制代码

如何修改hosts:

win7 进入下面路径:

- C:\Windows\System32\drivers\etc

复制代码

找打hosts

然后打开,进行如下配置即可看到

看到下图:看到下图:

到此全部完毕。

使用hadoop集群,更详细内容,可以查看

hadoop2.X使用手册1:通过web端口查看主节点、slave1节点及集群运行状态

hadoop2.X使用手册2:如何运行自带wordcount

hadoop2.2运行mapreduce(wordcount)问题总结

本文链接

http://www.aboutyun.com/thread-7684-1-1.html

下一篇:

hbase 0.96整合到hadoop2.2三个节点全分布式安装高可靠文档

hadoop2.2完全分布式最新高可靠安装文档相关推荐

- hadoop2.6.5安装文档及解决root用户无法ssh localhost的问题

hadoop2.6.5官方安装文档 解决root用户无法ssh localhost的问题:

- openstack_Stein版安装文档

openstack Stein 版本安装文档 2019年8月28日 陈即彪 文章目录 1. openstack介绍 1.1. 云计算模式 2. OpenStack 中有哪些项目? 2.1. Opens ...

- ELK安装文档及相关优化

前言:随着硬件成本的不断低廉,我们可以存储更多数据内容,也会对各数据加以利用,其中一项很重要的数据内容便是日志文件,无论是访问日志还是系统日志或是应用日志,都显得十分重要,而怎么加以利用一直是一个难题 ...

- Docker软件安装文档

软件安装文档 文章目录 软件安装文档 虚拟机安装 系统死锁问题 JDK11安装 Docker安装 Docker-Compose安装 MySQL安装 MySQL8安装 Docker-Compose安装M ...

- mysql数据库21_Mysql5.7.21安装文档

Mysql5.7.21安装文档 发布时间:2020-06-27 13:59:56 来源:51CTO 阅读:946 作者:PengChonggui --1.创建用户组mysql,创建用户mysql并将其 ...

- Subversion(SVN)安装文档

Subversion(SVN)安装文档 SVN中文网址(操作手册) http://www.iusesvn.com/ 软件版本(当前版本): subversion-1.6.17.tar.gz su ...

- GitLab安装文档

GitLab安装文档 GitLab 是一个用于仓库管理系统的开源项目,使用Git作为代码管理工具,并在此基础上搭建起来的web服务. GitLab与GitHub的功能相似,通常企业使用GitLab在局 ...

- Oracle 11g 单实例安装文档

这里介绍在Red Hat Enterprise Linux Server release 5.7 (Tikanga)下安装ORACLE 11.2.0.1.0的过程,本文仅仅是为了写这样安装指导文档而整 ...

- KVM 标准化安装文档

KVM 标准化安装文档 转载于:https://blog.51cto.com/wangwei007/600111

- 转自 David dai linux平台 oracle 数据库 安装文档

Oracle 官方的安装文档 http://download.oracle.com/docs/cd/B28359_01/install.111/b32002/toc.htm 一. 安装相关包 1.1 ...

最新文章

- SVO 半直接视觉里程计

- 深度报告:芯片设计EDA 2.0时代,三大路径搞定六大挑战

- doc2vec介绍和实践

- 缺少 mcrypt 扩展。请检查 PHP 配置。(phpmyadmin)

- C#中的几种加密算法整理

- Python--高阶学习笔记

- 湖北沙洋中学2021年6月高考成绩查询,2021年荆门中考分数线公布填报志愿时间及录取结果什么时候出...

- 海龟画图 python太阳花_python 简单的绘图工具turtle使用详解

- 跨境电商为什么需要ERP系统?

- 物联网火爆,开发者遇到大难题了!

- 数据结构第三篇——线性表的链式存储之单链表

- 【VRP问题】基于蚁群算法求解带时间窗车辆调度问题

- 较新颖的智能优化算法

- 解决win10分辨率过高导致某些软件显示小的办法

- 【寒江雪】圆与扇形物体的碰撞检测

- Altium_Designer-原理图库如何添加低电平有效的管脚?

- 从零开始的运维之路【标题党】

- 《城市化》(顾朝林)-1

- WAF防火墙有什么用

- vultr服务器可以ping通但是ssh无法连接问题