TFS数据迁移之sync_by_blk

本文档记录了两套tfs 2.2.16系统之间的数据迁移过程。

Source环境介绍:

Tfs 主nameserver: 192.168.1.225/24 (vip 229)

Tfs 从nameserver: 192.168.1.226/24

Tfs data server 1: 192.168.1.226/24 (启动三个挂载点,每个挂载点分配20G空间)

Tfs data server 1: 192.168.1.227/24 (启动三个挂载点,每个挂载点分配20G空间)

Tfs data server 1: 192.168.1.228/23 (启动三个挂载点,每个挂载点分配20G空间)

Target环境介绍:

Tfs namserver: 192.168.1.12/24 (未配置vip)

Tfs dataserver: 192.168.1.12/24 (启动三个挂载点,每个挂载点分配20G空间)

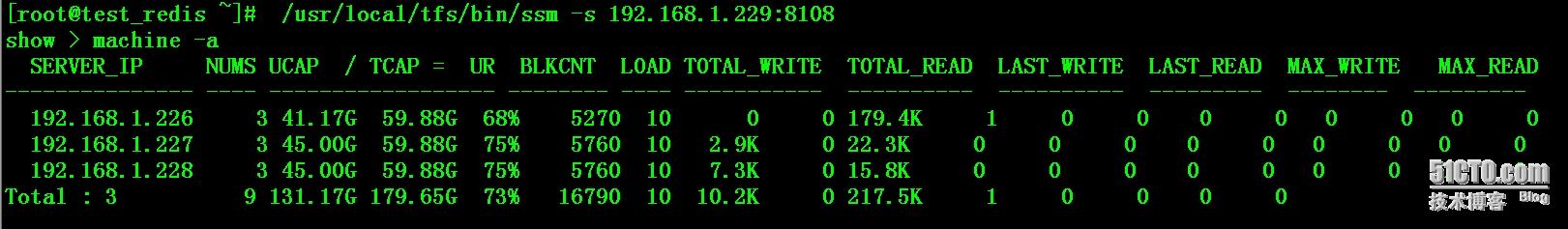

一:查看当前source服务器状态

# /usr/local/tfs/bin/ssm -s 192.168.1.229:8108 show > machine -a

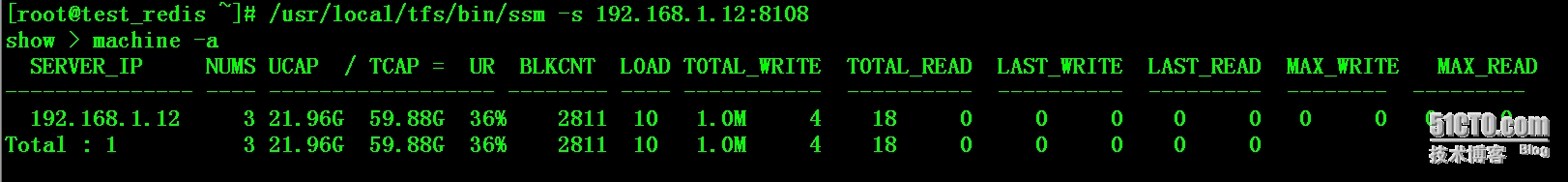

二:查看当前target服务器状态

# /usr/local/tfs/bin/ssm -s 192.168.1.12:8108 show > machine -a

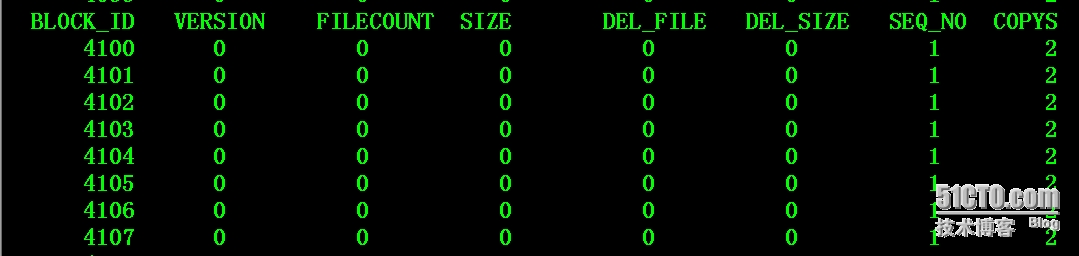

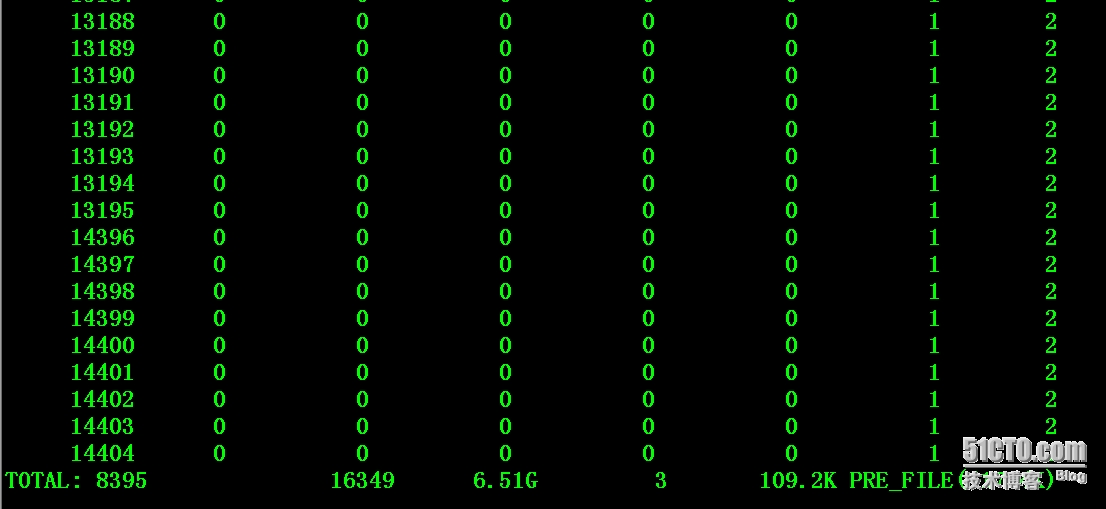

三:从source上导出当前存有数据的block的block_id号

# /usr/local/tfs/bin/ssm -s 192.168.1.229:8108 show > block > /tmp/1.txt show > exit# wc -l /tmp/1.txt 8406 /tmp/1.txt通过观察,过滤掉version, filecount, size, del_file, del_size这几个字段全部为0的那些block_id,剩下的block上都存有实际的数据。# grep -v '0 0 0 0 0' /tmp/1.txt > /tmp/2.txt

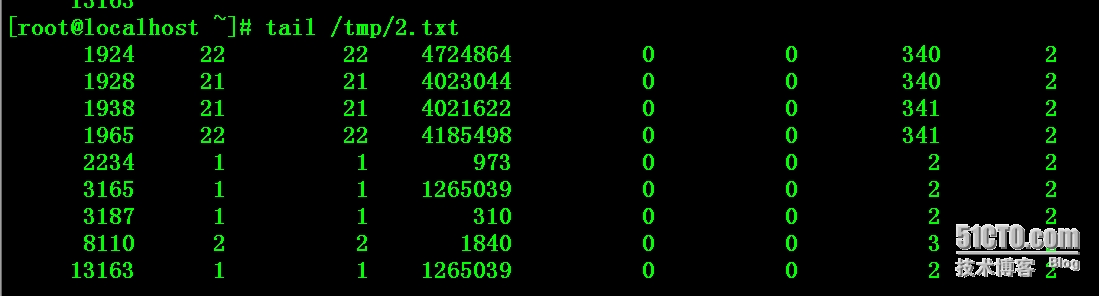

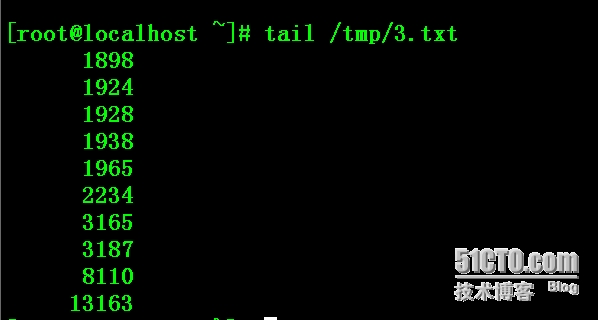

取出block_id号 # cut -c 1-10 /tmp/2.txt > /tmp/3.txt

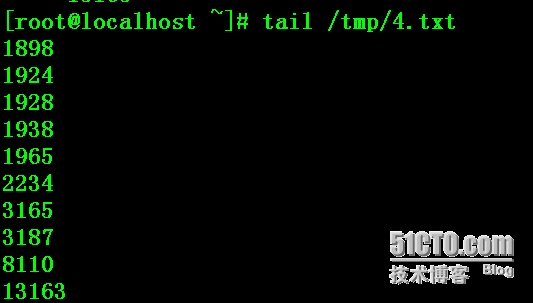

缩进空格 # for i in $(cat /tmp/3.txt);do echo $i >> /tmp/4.txt; done # wc -l /tmp/4.txt 119 /tmp/4.txt

四:使用tfs自带的sync_by_blk进行数据迁移

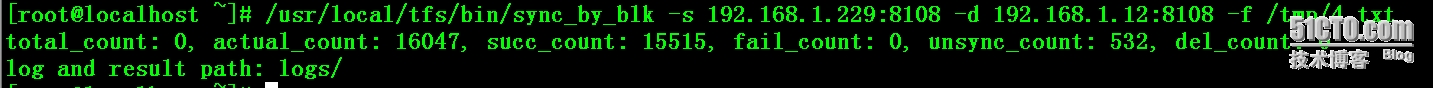

# /usr/local/tfs/bin/sync_by_blk -s 192.168.1.229:8108 -d 192.168.1.12:8108 -f /tmp/4.txt

通过观察日志发现成功同步文件15515个,失败个数为0,未同步的为532

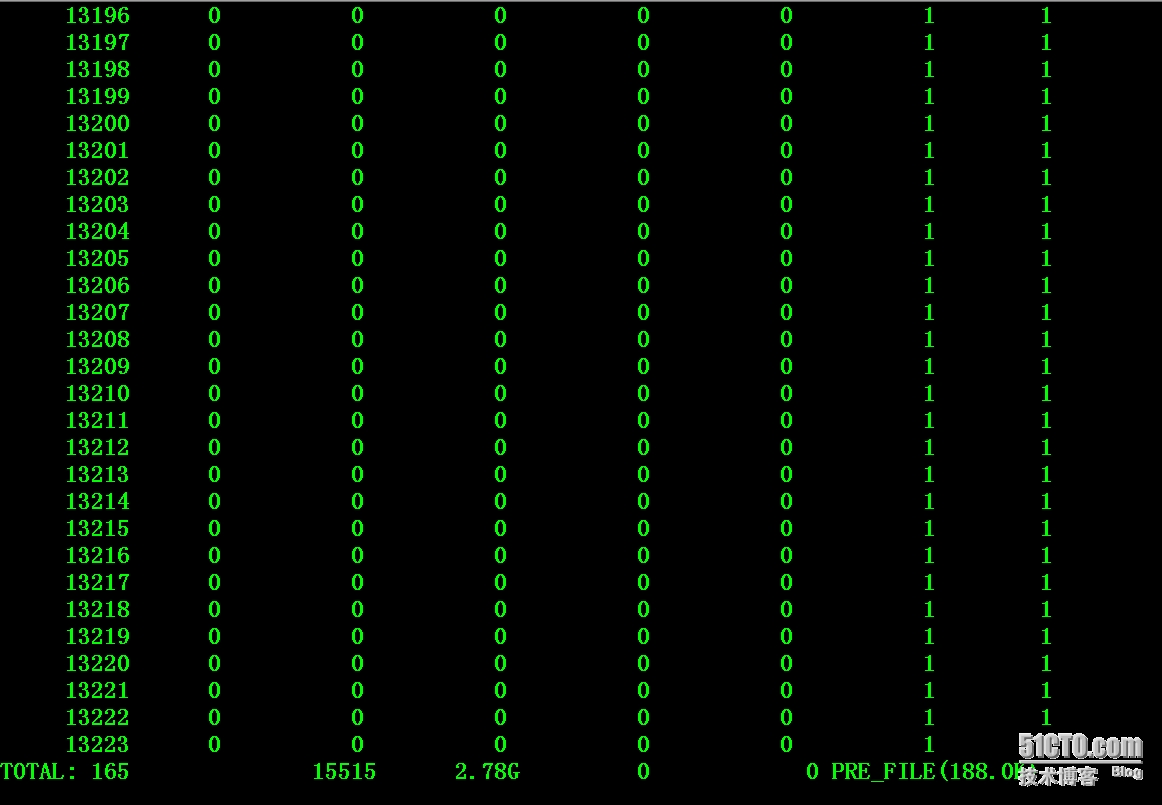

# /usr/local/tfs/bin/ssm -s 192.168.1.12:8108 show > block

五:数据比对

# /usr/local/tfs/bin/ssm -s 192.168.1.229:8108 show > block

Source上的filecount总数为16349

Target上的filecount总数为15515

16349-15515=834

感觉上少了834个文件,834减去未同步的532等于302,再减去删除掉的3个文件,还是少了299个文件。当然这个可能只是统计信息,说明不了什么问题。

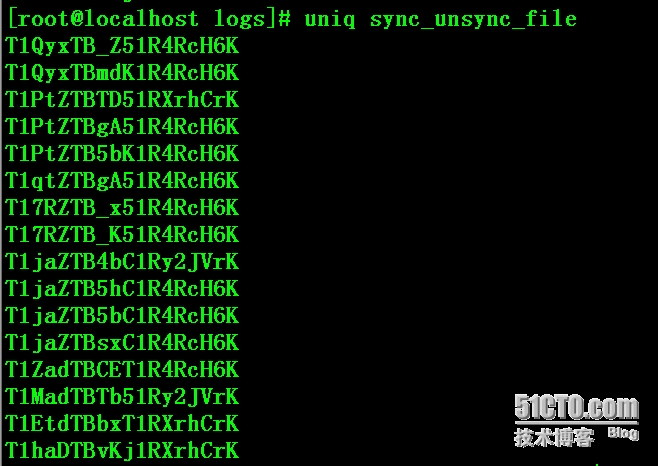

六:日志分析

# cd logs/ # wc -l sync_unsync_file 532 sync_unsync_file

通过分析日志,发现未同步的532个文件里面,文件名除重后实际上只有16个文件而已

# uniq sync_unsync_file |wc -l 16

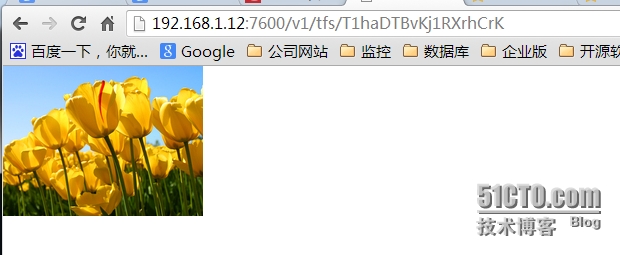

实际上采用nginx提供的模块直接访问这些文件都是可以的。

TFS数据迁移之sync_by_blk相关推荐

- svn的代码提交到git服务器_svn服务器代码仓库,数据迁移到git仓库

svn服务器代码仓库,数据迁移到git仓库 1.安装svn [root@tomcat01 ~]# yum install subversion -y 2.初始化仓库 [root@tomcat02 ~] ...

- 记一次大规模数据迁移和加密

公司的核心业务合作伙伴淘宝网,最近出现泄漏用户信息的现象,找了好久找不到根源,于是乎,淘宝那边决定对所有敏感数据进行加密,从出口和入口都走密文,于是乎,我们的工作量就来了. 我们的一个底单数据库,存储 ...

- 一种可以避免数据迁移的分库分表scale-out扩容方式

原文地址:http://jm-blog.aliapp.com/?p=590 目前绝大多数应用采取的两种分库分表规则 mod方式 dayofweek系列日期方式(所有星期1的数据在一个库/表,或所有?月 ...

- 完美数据迁移-MongoDB Stream的应用

目录 一.背景介绍 二.常见方案 1. 停机迁移 2. 业务双写 3. 增量迁移 三.Change Stream 介绍 监听的目标 变更事件 四.实现增量迁移 五.后续优化 小结 附参考文档 一.背景 ...

- Entity Framework CodeFirst数据迁移

原文:Entity Framework CodeFirst数据迁移 前言 紧接着前面一篇博文Entity Framework CodeFirst尝试. 我们知道无论是"Database Fi ...

- 我在MongoDB年终大会上获二等奖文章:由数据迁移至MongoDB导致的数据不一致问题及解决方案...

作者 | 上海小胖 来源 | Python专栏(ID:xpchuiit) 故事背景 企业现状 2019年年初,我接到了一个神秘电话,电话那头竟然准确的说出了我的昵称:上海小胖. 我想这事情不简单,就回 ...

- codis3数据迁移探索

背景 在测试codis的过程中,由于现网使用的codis的每个集群的量相对较大,为了确保在codis的升级过程中能够紧急处理突发的一些问题故熟悉一下codis有关的基本原理. codis的逻辑 cod ...

- Sqoop数据迁移原理及基本框架

目录 Sqoop简介 Sqoop架构 Sqoop导入底层工作原理 Sqoop导出底层工作原理 Sqoop简介 Sqoop旨在协助RDBMS与Hadoop之间进行高效的大数据交流.可以把关系型数据库的数 ...

- hibernate oracle 读写分离_利用FDW进行ORACLE到Postgresql的数据迁移

随着开源数据库技术的发展和去"O"工作的推进,越来越多企业生产系统选择使用Postgresql数据库.Pgsql采用多进程结构,其存储过程.函数的支持好于mysql.个人认为pgs ...

最新文章

- system.err android.os.NetworkOnmainThreadException 错误解决办法

- Essential fact about future of PhD studies

- 同时打开两个excel工作窗口

- 在IDEA中关于项目java版本问题

- 【图像处理】图像灰度级减少, 图像缩放(Reducing the Number of Gray Levels, Zooming and Shrinking)

- 多团队协作开发的大型项目Git工作流设计分享

- 硕士android毕业答辩ppt,硕士研究生毕业答辩ppt全攻略

- googleseo只做内容不做外链行不行?(e6zzseo)

- php格式文件怎么改成mp4,dat视频文件如何打开 dat格式文件怎样转换成MP4或其它视频格式...

- 零基础21天搞定Python分布式爬虫_分布式网络爬虫入门进阶视频教程

- 我能坚持700多天,但人生却不图啥?

- wifi 框架流程分析

- 简单使用一下IDEA 的HTTP Client

- 崩坏3九游服务器稳定吗,崩坏3:大佬亲身经历告诉你,玩崩坏3到底该不该压等级!...

- 【社区分享】专注移动端机器学习交流,TensorFlow Lite 中文兴趣小组招募中!

- java 判断是否信用卡_用java实现验证输入信用卡号码的正误

- 领导 - 如何培养您的团队的信心

- VMware虚拟机ping不通主机,Destination Host Unreachable

- bulldog-1靶机 write up 源码 MD5解密得到密码到后台 命令执行绕过 反弹shell string分析文件得到密码提权

- 【无标题】win11安装Oracle 12c [INS-32102] 指定的 Oracle 主目录用户已存在